Plattformspezifische Leitfäden

Android (Kotlin/Java)

Android NDK (C)

Unity (AR Foundation)

iOS

Unreal Engine

Mit der Augmented Faces API können Sie Assets auf Gesichtern rendern, ohne spezielle Hardware zu verwenden. Sie bietet Feature-Punkte, mit denen Ihre App verschiedene Bereiche eines erkannten Gesichts automatisch identifizieren kann. Ihre App kann diese Bereiche dann verwenden, um Assets so zu überlagern, dass sie den Konturen eines Gesichts entsprechen.

Anwendungsfälle

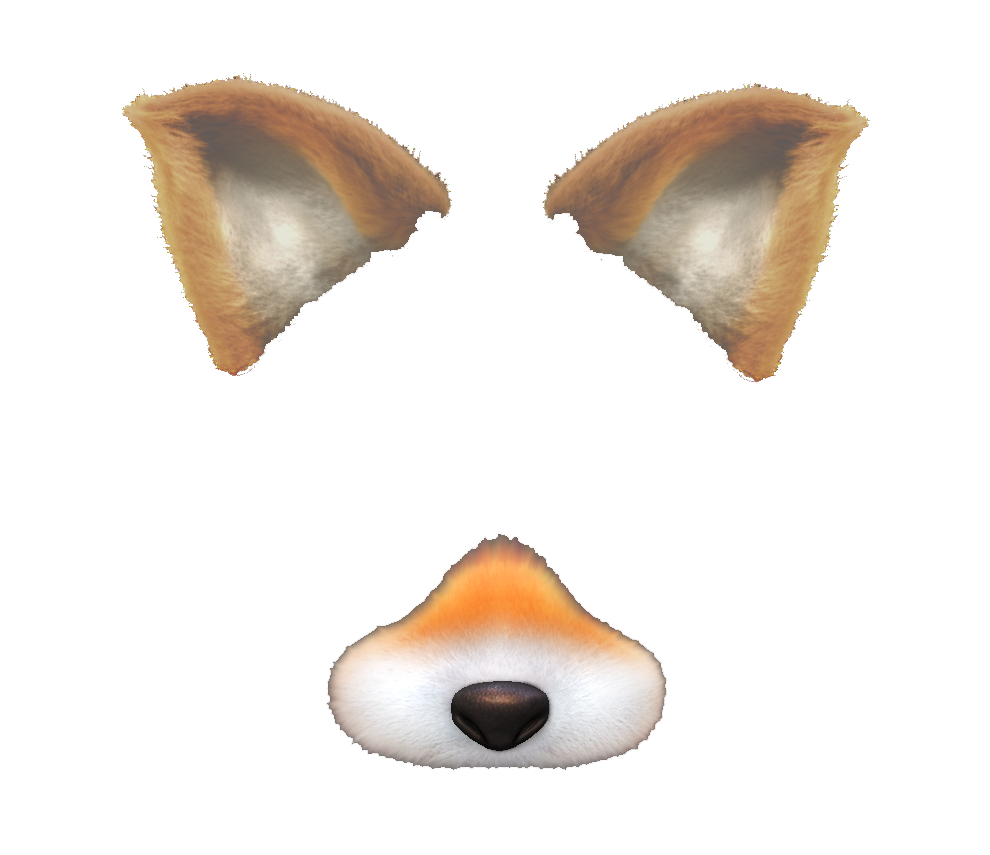

Gesichtsbasierte AR-Anwendungen bieten eine Vielzahl von Anwendungsfällen, von Beauty- und Accessoire-Anwendungen bis hin zu Gesichtsfiltern und -effekten, die Nutzer mit ihren Freunden verwenden können. Sie können beispielsweise 3D-Modelle und eine Textur verwenden, um die Merkmale eines Fuchses auf das Gesicht eines Nutzers zu legen.

Das Modell besteht aus zwei Fuchs-Ohren und einer Fuchs-Nase. Jedes ist ein separates Bone das einzeln bewegt werden kann, um der Gesichtsregion zu folgen, an der es befestigt ist.

Die Textur besteht aus Lidschatten, Sommersprossen und anderen Farben.

Während der Laufzeit erkennt die Augmented Faces API das Gesicht eines Nutzers und legt sowohl die Textur als auch die Modelle darauf.

Teile eines Augmented Face

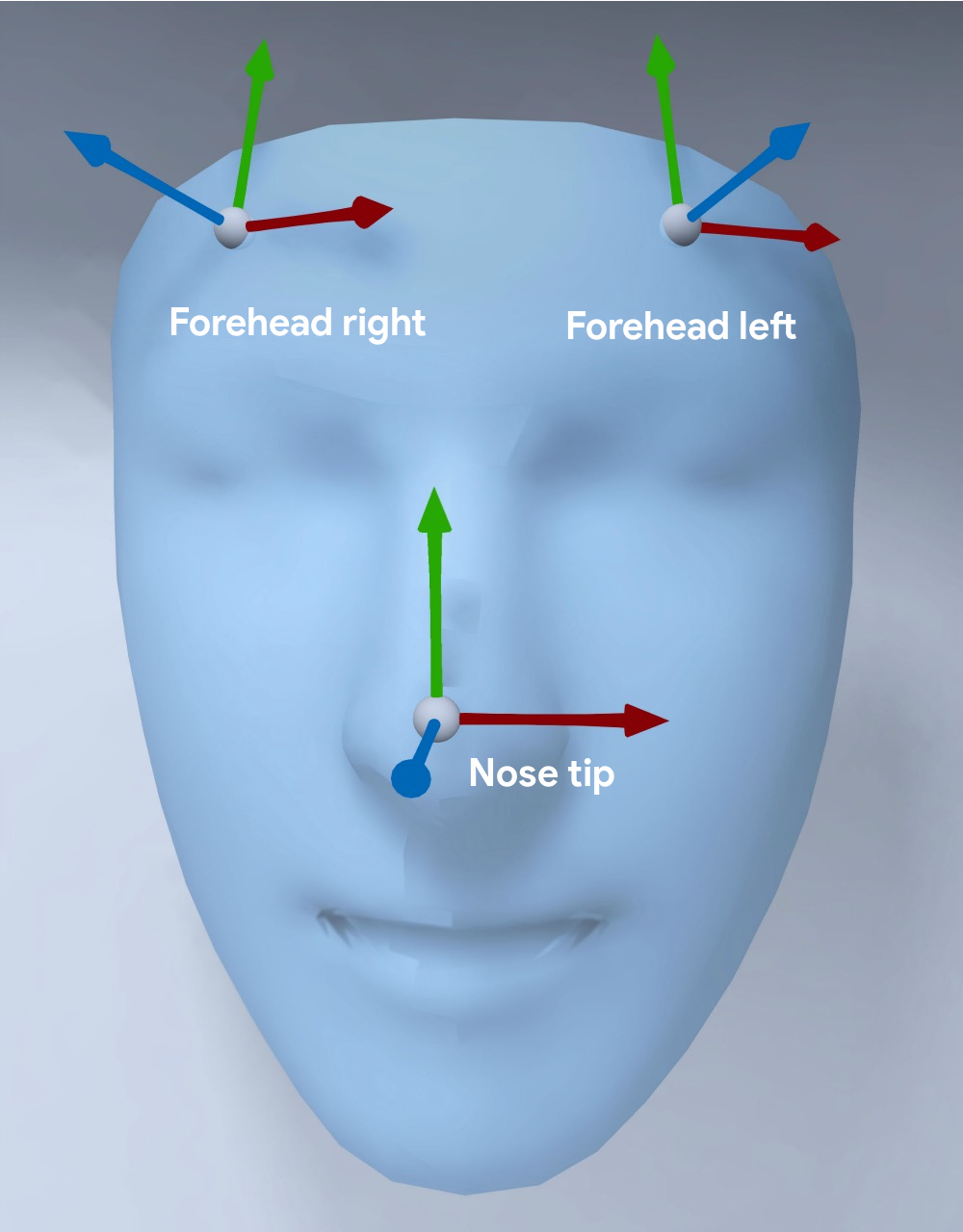

Die Augmented Faces API bietet eine Mittelpose, drei Regionenposen und ein 3D-Gesichtsnetz.

Mittelpose

Die Mittelpose befindet sich hinter der Nase und markiert die Mitte des Kopfes eines Nutzers. Verwenden Sie sie, um Assets wie einen Hut auf dem Kopf zu rendern.

Regionenposen

Die Regionenposen befinden sich auf der linken Stirn, der rechten Stirn und der Nasenspitze und markieren wichtige Teile des Gesichts eines Nutzers. Verwenden Sie sie, um Assets auf der Nase oder um die Ohren zu rendern.

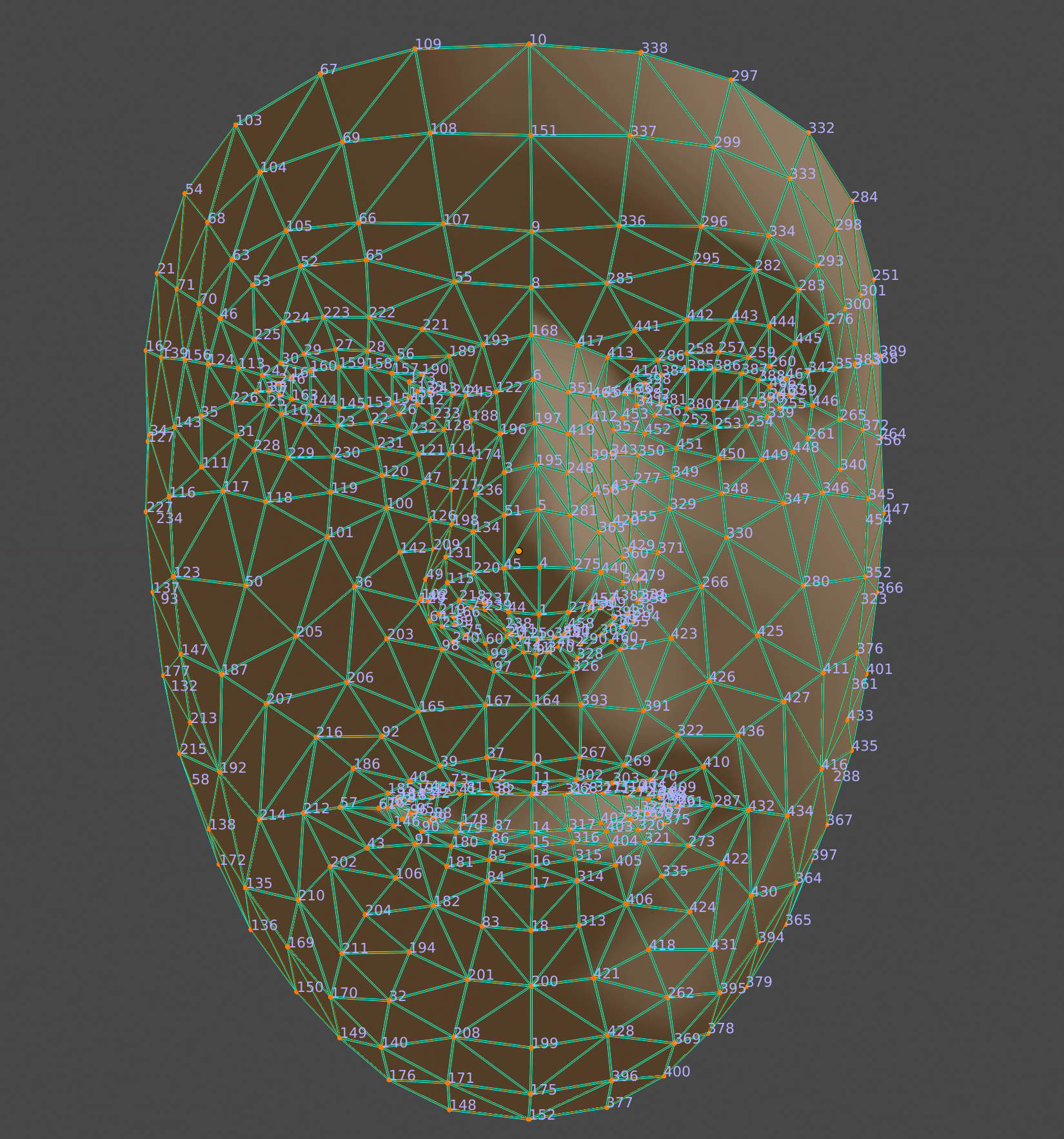

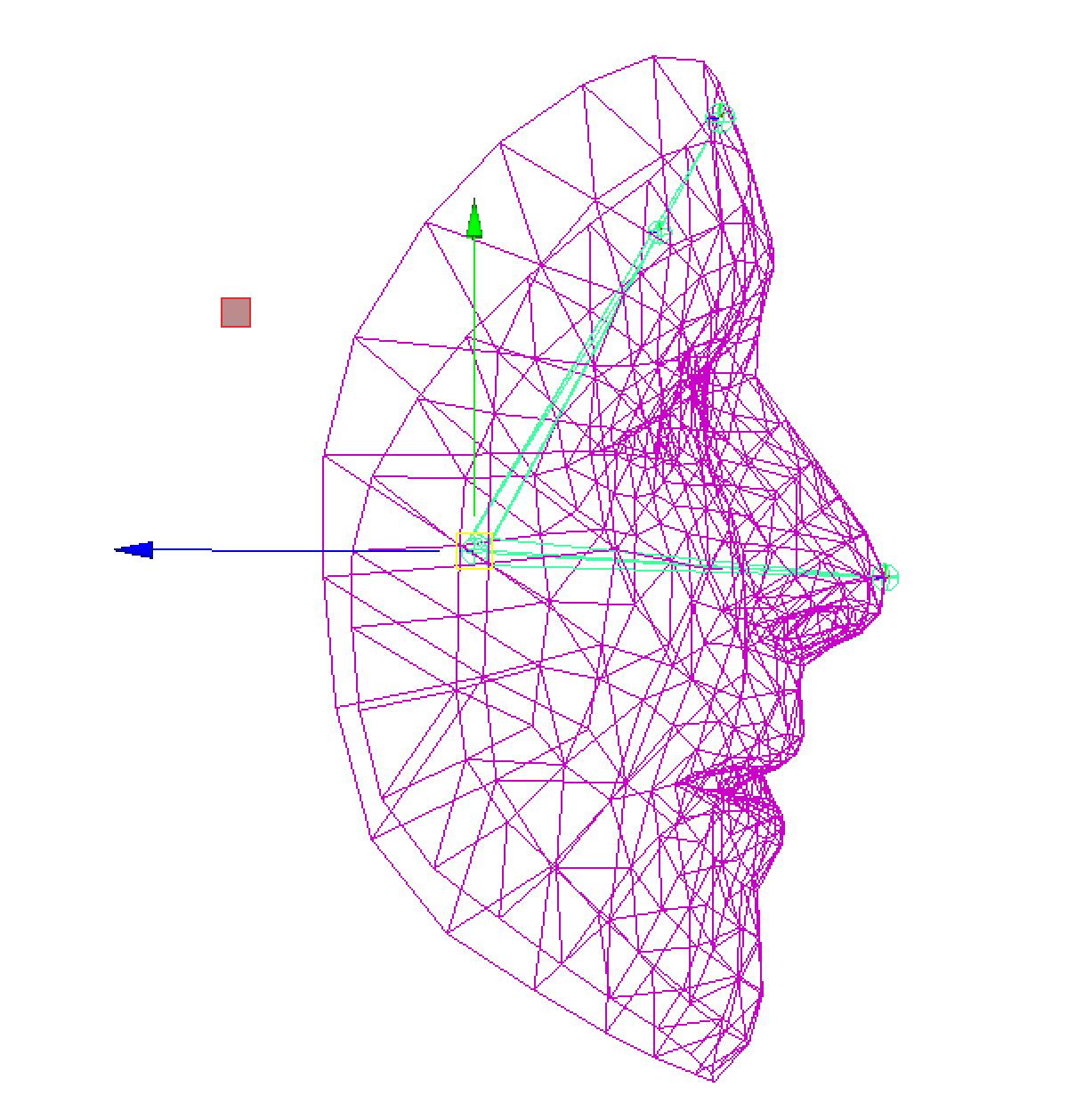

Gesichtsnetz

Mit dem dichten 3D-Gesichtsnetz mit 468 Punkten können Sie anpassbare, detaillierte Texturen erstellen, die einem Gesicht genau folgen, z. B. wenn Sie eine virtuelle Brille hinter einem bestimmten Teil der Nase platzieren. Das Netz erfasst genügend detaillierte 3D-Informationen, um dieses virtuelle Bild einfach zu rendern.