मकसद

ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने के ट्यूटोरियल में, आपको अलग-अलग ऐसे परिदृश्यों के बारे में बताया गया है जिनमें ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा का इस्तेमाल किया जा सकता है. इस ट्यूटोरियल में, हम आपको Google Cloud Platform में, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा को चलाने के लिए, अलग-अलग डिज़ाइन पैटर्न के बारे में बताएंगे.

हम Google Cloud Platform में, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा को एक बार चलाने के लिए, Cloud Run, Compute Engine या Google Kubernetes Engine का इस्तेमाल करने की खास जानकारी से शुरुआत करेंगे. इसके बाद, हम देखेंगे कि इस सुविधा को डेटा पाइपलाइन के हिस्से के तौर पर कैसे शामिल किया जा सकता है.

इस लेख को पढ़ने के बाद, आपको Google Cloud एनवायरमेंट में, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा को चलाने के अलग-अलग विकल्पों के बारे में अच्छी जानकारी मिल जाएगी.

Google Cloud Platform पर रेफ़रंस आर्किटेक्चर

इस सेक्शन में, Google Cloud Platform का इस्तेमाल करके, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा के अलग-अलग डिज़ाइन पैटर्न के बारे में ज़्यादा जानकारी दी गई है. Google Cloud Platform पर इस सुविधा को चलाने से, इसे मौजूदा प्रोसेस और डेटा पाइपलाइन के साथ इंटिग्रेट किया जा सकता है.

Google Cloud Platform पर, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा को एक बार चलाना

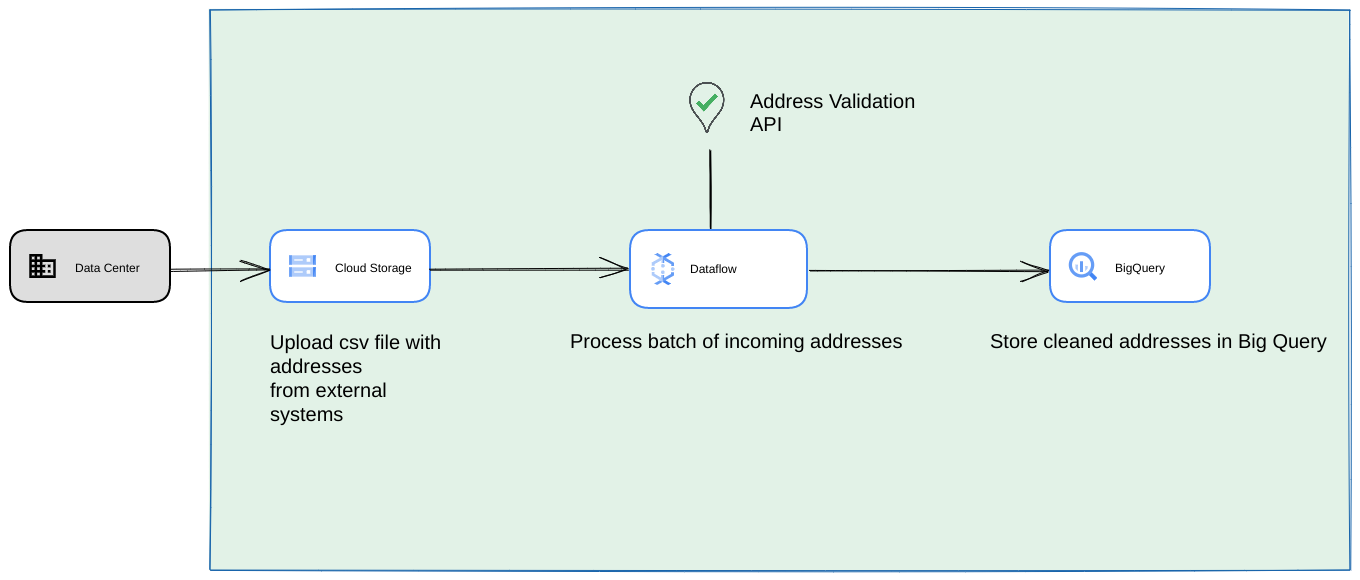

यहां, Google Cloud Platform पर इंटिग्रेशन बनाने के रेफ़रंस आर्किटेक्चर के बारे में बताया गया है. यह आर्किटेक्चर, एक बार की जाने वाली कार्रवाइयों या टेस्टिंग के लिए ज़्यादा सही है.

इस मामले में, हमारा सुझाव है कि CSV फ़ाइल को Cloud Storage बकेट में अपलोड करें. इसके बाद, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने वाली स्क्रिप्ट को Cloud Run एनवायरमेंट से चलाया जा सकता है. हालांकि, इसे Compute Engine या Google Kubernetes Engine जैसे किसी भी अन्य रनटाइम एनवायरमेंट में चलाया जा सकता है. आउटपुट CSV को Cloud Storage बकेट में भी अपलोड किया जा सकता है.

Google Cloud Platform की डेटा पाइपलाइन के तौर पर चलाना

पिछले सेक्शन में दिखाया गया डिप्लॉयमेंट पैटर्न, एक बार इस्तेमाल के लिए, ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा की तुरंत टेस्टिंग करने के लिए सही है. हालांकि, अगर आपको इसे डेटा पाइपलाइन के हिस्से के तौर पर नियमित रूप से इस्तेमाल करना है, तो इसे ज़्यादा मज़बूत बनाने के लिए, Google Cloud Platform की नेटिव सुविधाओं का बेहतर तरीके से फ़ायदा लिया जा सकता है. यहां कुछ ऐसे बदलाव दिए गए हैं जो किए जा सकते हैं:

- इस मामले में, CSV फ़ाइलों को Cloud Storage बकेट में डंप किया जा सकता है.

- प्रोसेस किए जाने वाले पतों को Dataflow का कोई जॉब चुन सकता है. इसके बाद, उन्हें BigQuery में कैश किया जा सकता है.

- The Dataflow Python लाइब्रेरी को बढ़ाया जा सकता है, ताकि इसमें ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने की सुविधा के लिए लॉजिक शामिल किया जा सके. इससे, Dataflow के जॉब से मिले पतों की पुष्टि की जा सकती है.

डेटा पाइपलाइन से स्क्रिप्ट को, बार-बार होने वाली लंबी प्रोसेस के तौर पर चलाना

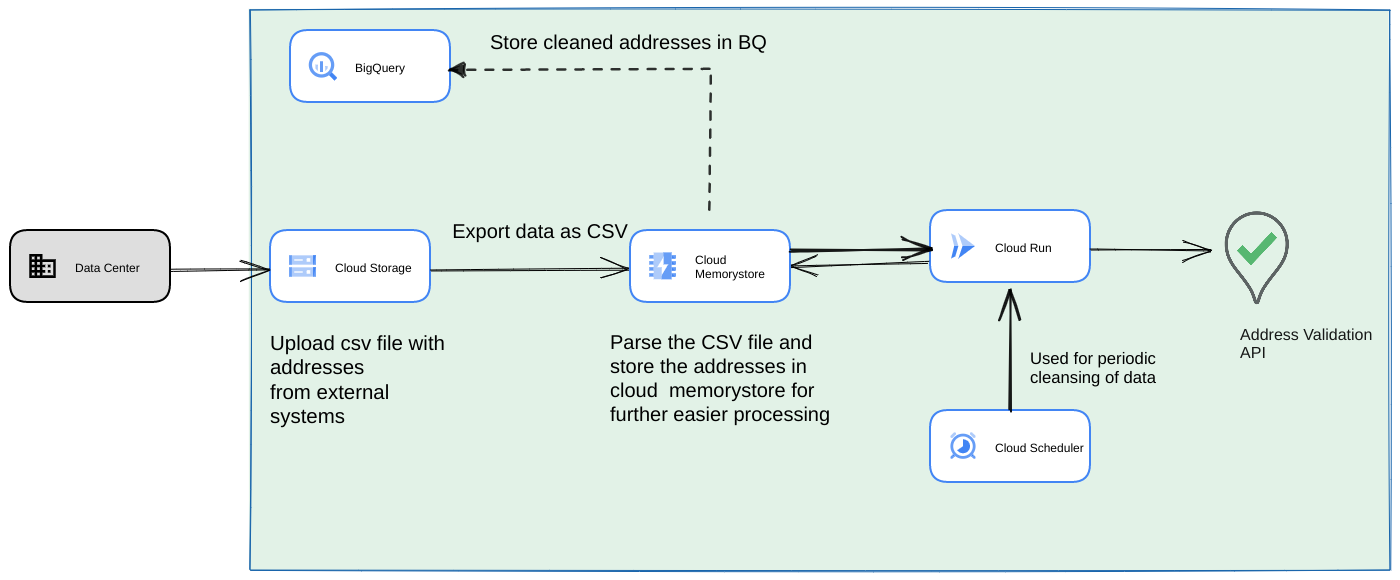

एक और आम तरीका यह है कि पतों के बैच की पुष्टि, स्ट्रीमिंग डेटा पाइपलाइन के हिस्से के तौर पर, बार-बार होने वाली प्रोसेस के तौर पर की जाए. आपके पास, पते BigQuery डेटास्टोर में भी हो सकते हैं. इस तरीके में, हम देखेंगे कि बार-बार होने वाली डेटा पाइपलाइन (जिसे हर दिन/हफ़्ते/महीने में ट्रिगर करना होगा) कैसे बनाई जाए

- शुरुआती CSV फ़ाइल को Cloud Storage बकेट में अपलोड करें.

- लंबे समय तक चलने वाली प्रोसेस के लिए, इंटरमीडिएट स्टेट को बनाए रखने के लिए, Memorystore को परसिस्टेंट डेटास्टोर के तौर पर इस्तेमाल करें.

- आखिरी पतों को BigQuery डेटास्टोर में कैश करें.

- स्क्रिप्ट को समय-समय पर चलाने के लिए, Cloud Scheduler सेट अप करें.

इस आर्किटेक्चर के ये फ़ायदे हैं:

- Cloud Scheduler का इस्तेमाल करके, पतों की पुष्टि समय-समय पर की जा सकती है. ऐसा हो सकता है कि आपको हर महीने पतों की फिर से पुष्टि करनी हो या हर महीने/तीन महीने में नए पतों की पुष्टि करनी हो. यह आर्किटेक्चर, इस इस्तेमाल के मामले में मदद करता है.

अगर ग्राहक का डेटा BigQuery में है, तो पुष्टि किए गए पतों या पुष्टि के फ़्लैग को सीधे वहां कैश किया जा सकता है. ध्यान दें: ज़्यादा वॉल्यूम वाले पतों की पुष्टि करने के लेख में, इस बारे में पूरी जानकारी दी गई है कि क्या कैश किया जा सकता है और कैसे.

Memorystore का इस्तेमाल करने से, ज़्यादा रेज़िलियंस मिलता है और ज़्यादा पतों को प्रोसेस किया जा सकता है. इस चरण से, पूरी प्रोसेसिंग पाइपलाइन में स्टेटफ़ुलनेस जुड़ जाती है. यह बहुत बड़े पतों के डेटासेट को हैंडल करने के लिए ज़रूरी है. यहां, Cloud SQL[https://cloud.google.com/sql] जैसी अन्य डेटाबेस टेक्नोलॉजी या Google Cloud Platform की ओर से ऑफ़र किए जाने वाले डेटाबेस के किसी अन्य फ़्लेवर का भी इस्तेमाल किया जा सकता है. हालांकि, हमारा मानना है कि Memorystore, स्केलिंग और आसानी से इस्तेमाल करने की ज़रूरतों को पूरी तरह से बैलेंस करता है. इसलिए, इसे पहली प्राथमिकता दी जानी चाहिए.

नतीजा

यहां बताए गए पैटर्न लागू करके, Google Cloud Platform पर, Address Validation API का इस्तेमाल अलग-अलग कामों के लिए और अलग-अलग तरीकों से किया जा सकता है.

ऊपर बताए गए इस्तेमाल के मामलों में आपकी मदद करने के लिए, हमने ओपन-सोर्स Python लाइब्रेरी लिखी है. इसे अपने कंप्यूटर पर कमांड लाइन से या Google Cloud Platform या अन्य क्लाउड सेवा देने वाली कंपनियों से शुरू किया जा सकता है.

इस लाइब्रेरी का इस्तेमाल करने के बारे में ज़्यादा जानने के लिए, यह लेख पढ़ें.

अगले चरण

पतों की पुष्टि करने की सुविधा की मदद से, चेकआउट, डिलीवरी, और कार्रवाइयों को बेहतर बनाने के बारे में जानकारी देने वाला श्वेत पत्र डाउनलोड करें. साथ ही, पतों की पुष्टि करने की सुविधा की मदद से, चेकआउट, डिलीवरी, और कार्रवाइयों को बेहतर बनाने के बारे में जानकारी देने वाला वेबिनार देखें.

आगे पढ़ने के लिए सुझाव:

- Address Validation API का दस्तावेज़

- जियोकोडिंग और पतों की पुष्टि करना

- पतों की पुष्टि करने की सुविधा का डेमो देखें

योगदानकर्ता

Google इस लेख को मैनेज करता है. इसे मूल रूप से इन लोगों ने लिखा है.

मुख्य लेखक:

हेनरिक वाल्व | सलूशन इंजीनियर

थॉमस ऐंगलारेट | सलूशन इंजीनियर

सार्थक गांगुली | सलूशन इंजीनियर