Bu bir sığır.

Şekil 19. Bir öküz.

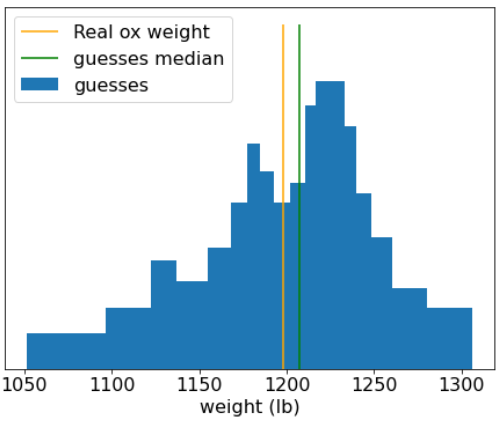

1906'da İngiltere'de ağırlık değerlendirme yarışması düzenlendi. 787 katılımcı bir öküzün ağırlığını tahmin etti. Tek tek tahminlerin medyan hatası 17 kg (%3,1 hata) idi. Ancak tahminlerin genel medyanı, öküzün gerçek ağırlığından (1198 lb) yalnızca 9 lb (4,1 kg) uzaktı.Bu da yalnızca %0,7'lik bir hata payı anlamına geliyordu.

Şekil 20. Bireysel ağırlık tahminlerinin histogramı.

Bu anekdot, kalabalığın bilgeliğini gösterir: Belirli durumlarda, toplu görüş çok iyi bir karar verir.

Kalabalığın bilgeliği matematiksel olarak merkezî limit teoremi ile modellenebilir: Gayrı resmi olarak, bir değer ile bu değerin N gürültülü tahmininin ortalaması arasındaki karesi alınmış hata, 1/N faktörüyle sıfıra yaklaşır. Ancak değişkenler bağımsız değilse varyans daha büyüktür.

Makine öğrenimindeki küme, tahminlerinin ortalaması alınan (veya bir şekilde toplanan) modellerden oluşan bir koleksiyondur. Birlikte kullanılan modeller tek tek çok kötü olmasa da yeterince farklıysa birlikte kullanılan modellerin kalitesi genellikle her bir modelin kalitesinden daha iyidir. Bir topluluk, tek bir modele kıyasla daha fazla eğitim ve çıkarım süresi gerektirir. Sonuçta, tek bir model yerine birden fazla modelde eğitim ve çıkarım yapmanız gerekir.

Bir topluluğun en iyi şekilde çalışması için modellerin bağımsız olması gerekir. Örneğin, tam olarak aynı modellerden 10 tanesinin oluşturduğu bir topluluk (yani hiç bağımsız olmayan) tek modelden daha iyi olmaz. Diğer yandan, modelleri bağımsız olmaya zorlamak onları daha kötü hale getirebilir. Etkili bir ensembling, model bağımsızlığı ile alt modellerinin kalitesi arasında denge kurmayı gerektirir.