این یک گاو است.

شکل 19. یک گاو نر.

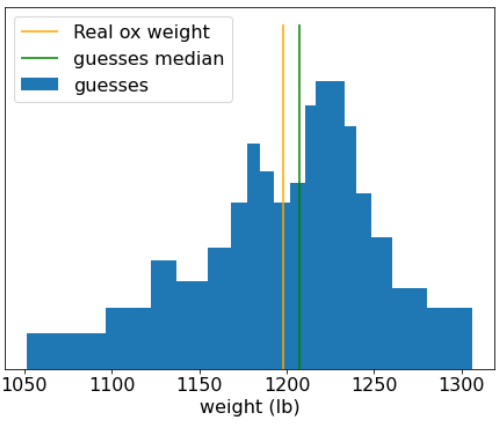

در سال 1906 مسابقه داوری وزن در انگلستان برگزار شد . 787 شرکت کننده وزن یک گاو را حدس زدند. میانگین خطای حدس های فردی 37 پوند (خطای 3.1٪) بود. با این حال، میانگین کلی حدسها تنها 9 پوند با وزن واقعی گاو (1198 پوند) فاصله داشت که خطای آن تنها 0.7٪ بود.

شکل 20. هیستوگرام حدس وزن فردی.

این حکایت حکمت جمعیت را نشان می دهد: در موقعیت های خاص، نظر جمعی قضاوت بسیار خوبی را ارائه می دهد.

از نظر ریاضی، خرد جمعیت را میتوان با قضیه حد مرکزی مدلسازی کرد: بهطور غیررسمی، مجذور خطای بین یک مقدار و میانگین N تخمینهای پر سر و صدای این مقدار با ضریب 1/N به صفر میرود. اما اگر متغیرها مستقل نباشند، واریانس بیشتر است.

در یادگیری ماشینی، یک مجموعه مجموعهای از مدلهایی است که پیشبینیهای آنها میانگین (یا به نوعی جمعآوری شده) است. اگر مدل های مجموعه به اندازه کافی متفاوت باشند بدون اینکه به صورت جداگانه بد باشند، کیفیت مجموعه به طور کلی بهتر از کیفیت هر یک از مدل های جداگانه است. یک گروه نسبت به یک مدل واحد نیاز به آموزش و زمان استنباط بیشتری دارد. به هر حال، شما باید به جای یک مدل واحد، آموزش و استنباط را روی چندین مدل انجام دهید.

به طور غیررسمی، برای اینکه یک گروه بهترین عملکرد را داشته باشد، هر مدل باید مستقل باشد. به عنوان مثال، یک گروه متشکل از 10 مدل دقیقاً یکسان (یعنی اصلاً مستقل نیستند) بهتر از مدل فردی نخواهد بود. از سوی دیگر، مجبور کردن مدل ها به مستقل بودن می تواند به معنای بدتر شدن آنها باشد. یکپارچه سازی موثر مستلزم یافتن تعادل بین استقلال مدل و کیفیت مدل های فرعی آن است.