En este glosario, se definen términos relacionados con la inteligencia artificial.

A

ablación

Técnica para evaluar la importancia de un atributo o componente quitándolo temporalmente de un modelo. Luego, vuelves a entrenar el modelo sin ese atributo o componente y, si el modelo reentrenado tiene un rendimiento significativamente peor, es probable que el atributo o componente quitado fuera importante.

Por ejemplo, supongamos que entrena un modelo de clasificación con 10 características y logra un 88% de precisión en el conjunto de prueba . Para verificar la importancia del primer atributo, puedes volver a entrenar el modelo usando solo los otros nueve atributos. Si el modelo reentrenado tiene un rendimiento significativamente peor (por ejemplo, un 55% de precisión), es probable que el atributo quitado fuera importante. Por el contrario, si el modelo reentrenado funciona igual de bien, entonces esa característica probablemente no era tan importante.

La ablación también puede ayudar a determinar la importancia de lo siguiente:

- Componentes más grandes, como un subsistema completo de un sistema de aprendizaje automático más grande.

- Procesos o técnicas, como un paso de preprocesamiento de datos

En ambos casos, observarías cómo cambia (o no cambia) el rendimiento del sistema después de quitar el componente.

Pruebas A/B

Es una forma estadística de comparar dos (o más) técnicas: la A y la B. Por lo general, la A es una técnica existente y la B es una técnica nueva. Las pruebas A/B no solo determinan qué técnica funciona mejor, sino también si la diferencia es estadísticamente significativa.

Las pruebas A/B suelen comparar una sola métrica en dos técnicas. Por ejemplo, ¿cómo se compara la precisión del modelo para dos técnicas? Sin embargo, las pruebas A/B también pueden comparar cualquier cantidad finita de métricas.

chip acelerador

Es una categoría de componentes de hardware especializados diseñados para realizar cálculos clave necesarios para los algoritmos de aprendizaje profundo.

Los chips aceleradores (o simplemente aceleradores) pueden aumentar significativamente la velocidad y la eficiencia de las tareas de entrenamiento y de inferencia en comparación con una CPU de uso general. Son ideales para entrenar redes neuronales y realizar tareas similares que requieren un uso intensivo del procesamiento.

Estos son algunos ejemplos de chips aceleradores:

- Unidades de procesamiento tensorial de Google (TPUs) con hardware dedicado para aprendizaje profundo.

- Las GPU de NVIDIA, aunque se diseñaron inicialmente para el procesamiento de gráficos, están diseñadas para permitir el procesamiento paralelo, lo que puede aumentar significativamente la velocidad de procesamiento.

exactitud

Es la cantidad de predicciones de clasificación correctas dividida por la cantidad total de predicciones. Es decir:

Por ejemplo, un modelo que realizó 40 predicciones correctas y 10 incorrectas tendría una precisión de:

La clasificación binaria proporciona nombres específicos para las diferentes categorías de predicciones correctas y predicciones incorrectas. Por lo tanto, la fórmula de exactitud para la clasificación binaria es la siguiente:

Donde:

- TP es el número de verdaderos positivos (predicciones correctas).

- TN es el número de verdaderos negativos (predicciones correctas).

- FP es la cantidad de falsos positivos (predicciones incorrectas).

- FN es el número de falsos negativos (predicciones incorrectas).

Compara y contrasta la exactitud con la precisión y la recuperación.

Consulta Clasificación: Precisión, recuperación, exactitud y métricas relacionadas en el Curso intensivo de aprendizaje automático para obtener más información.

acción

En el aprendizaje por refuerzo, es el mecanismo por el cual el agente realiza la transición entre los estados del entorno. El agente elige la acción con una política.

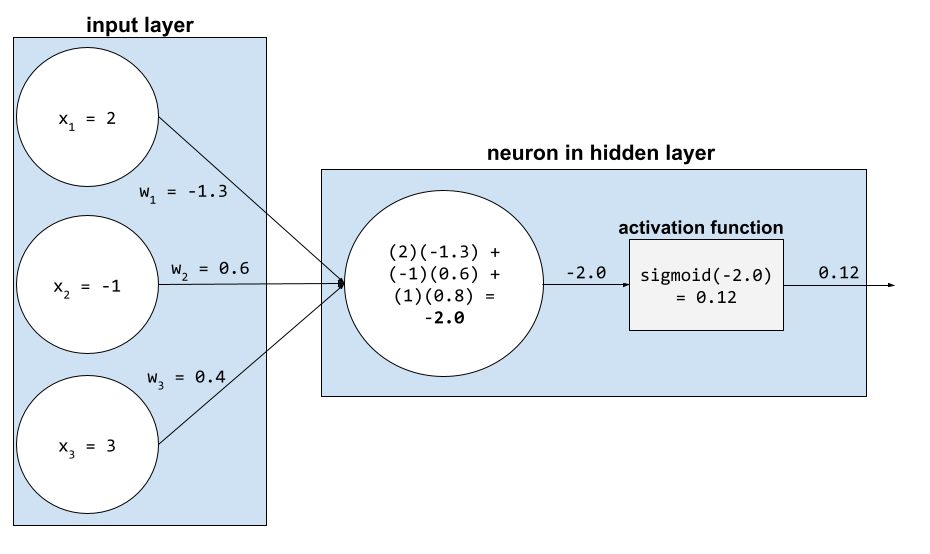

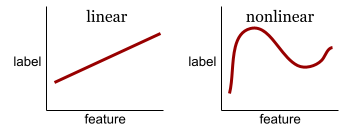

función de activación

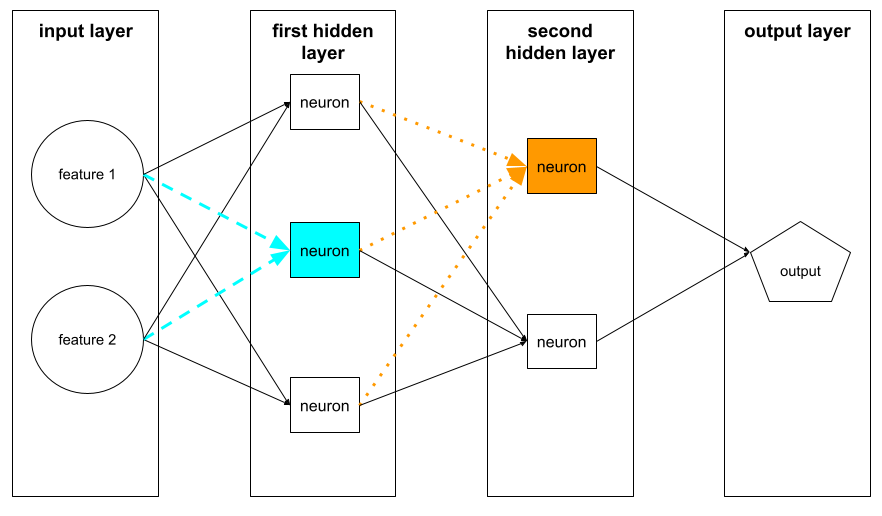

Es una función que permite que las redes neuronales aprendan relaciones no lineales (complejas) entre las características y la etiqueta.

Entre las funciones de activación más populares se incluyen:

Los gráficos de las funciones de activación nunca son líneas rectas únicas. Por ejemplo, el gráfico de la función de activación ReLU consta de dos líneas rectas:

La gráfica de la función de activación sigmoide tiene el siguiente aspecto:

Consulte Redes neuronales: Funciones de activación en el Curso intensivo de aprendizaje automático para obtener más información.

aprendizaje activo

Un enfoque de entrenamiento en el que el algoritmo elige algunos de los datos sobre los cuales aprende. El aprendizaje activo es especialmente útil cuando los ejemplos etiquetados son pocos o difíciles de obtener. En lugar de buscar entre un amplio rango de ejemplos etiquetados, un algoritmo de aprendizaje activo busca selectivamente el rango particular de ejemplos que necesita para aprender.

AdaGrad

Un algoritmo de descenso de gradientes sofisticado que reajusta los gradientes de cada parámetro y le asigna una tasa de aprendizaje independiente a cada uno. Para obtener una explicación completa, consulta Adaptive Subgradient Methods for Online Learning and Stochastic Optimization.

adaptación

Sinónimo de ajuste o ajuste.

agente

Software capaz de razonar sobre entradas de usuario multimodales para planificar y ejecutar acciones en nombre del usuario.

En el aprendizaje por refuerzo, un agente es la entidad que usa una política para maximizar el retorno esperado que se obtiene de la transición entre los estados del entorno.

agéntico/agéntica

Es la forma adjetiva de agente. El término "agéntico" se refiere a las cualidades que poseen los agentes (como la autonomía).

flujo de trabajo de agente

Es un proceso dinámico en el que un agente planifica y ejecuta acciones de forma autónoma para lograr un objetivo. El proceso puede implicar razonamiento, invocar herramientas externas y corregir su plan por sí mismo.

agrupamiento aglomerado

chapuza de IA

Es el resultado de un sistema de IA generativa que prioriza la cantidad por sobre la calidad. Por ejemplo, una página web con pendiente de IA está repleta de contenido de baja calidad generado por IA y producido de forma económica.

detección de anomalías

Proceso de identificación de valores atípicos. Por ejemplo, si la media de un determinado atributo es 100 con una desviación estándar de 10, la detección de anomalías debería marcar un valor de 200 como sospechoso.

AR

Abreviatura de realidad aumentada.

área bajo la curva PR

Consulta PR AUC (área bajo la curva de PR).

Área bajo la curva ROC

Ver AUC (Área bajo la curva ROC).

Inteligencia artificial general

Un mecanismo no humano que demuestra unamplia gama de resolución de problemas, creatividad y adaptabilidad. Por ejemplo, un programa que demuestre inteligencia artificial general podría traducir texto, componer sinfonías, y sobresalir en juegos que aún no se han inventado.

inteligencia artificial

Es un programa o modelo no humano que puede resolver tareas sofisticadas. Por ejemplo, los programas o modelos que traducen textos o que identifican enfermedades a partir de imágenes radiológicas son muestras de inteligencia artificial.

Técnicamente, el aprendizaje automático es un subcampo de la inteligencia artificial. Sin embargo, en los últimos años, algunas organizaciones comenzaron a utilizar los términos inteligencia artificial y aprendizaje automático de manera indistinta.

Attention,

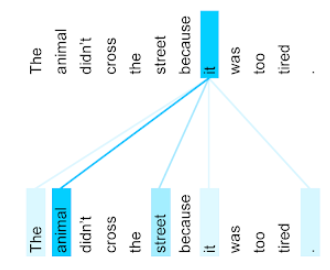

Es un mecanismo que se usa en una red neuronal para indicar la importancia de una palabra o parte de una palabra en particular. La atención comprime la cantidad de información que necesita un modelo para predecir el siguiente token o palabra. Un mecanismo de atención típico puede consistir en una suma ponderada sobre un conjunto de entradas, en la que otra parte de la red neuronal calcula el peso de cada entrada.

Consulta también autoatención y autoatención de múltiples cabezales, que son los componentes básicos de los Transformers.

Consulta LLMs: ¿Qué es un modelo de lenguaje grande? en el Curso intensivo de aprendizaje automático para obtener más información sobre la autoatención.

atributo

Sinónimo de atributo.

En el ámbito de la equidad en el aprendizaje automático, los atributos suelen referirse a características propias de los individuos.

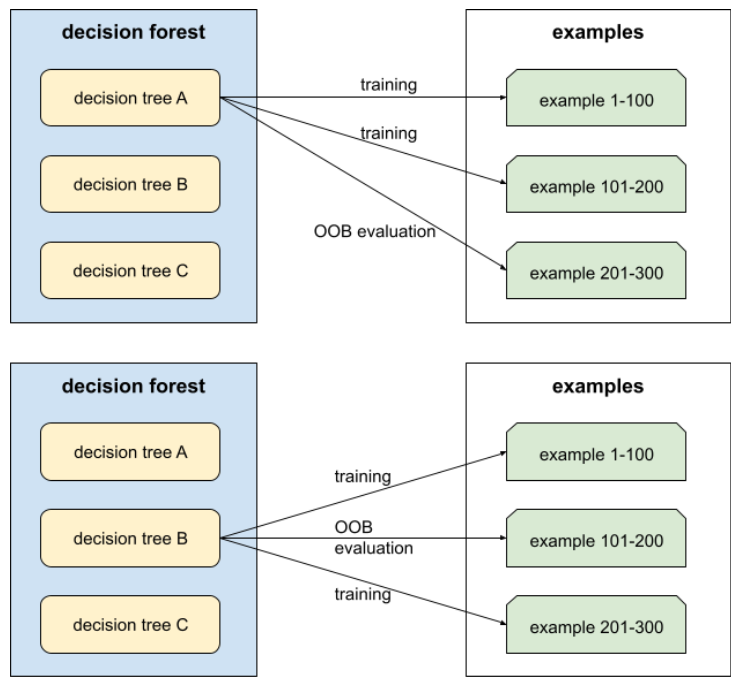

muestreo de atributos

Una táctica para entrenar un bosque de decisión en el que cada árbol de decisión considera solo un subconjunto aleatorio de posibles características al aprender la condición. En general, se muestrea un subconjunto diferente de atributos para cada nodo. En cambio, cuando se entrena un árbol de decisión sin muestreo de atributos, se consideran todos los atributos posibles para cada nodo.

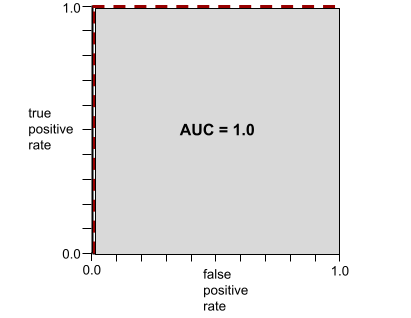

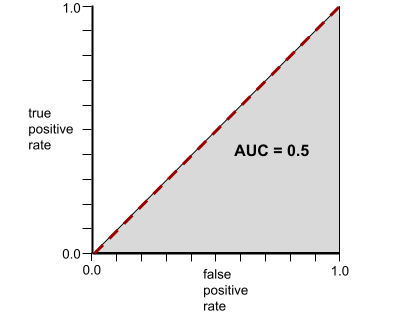

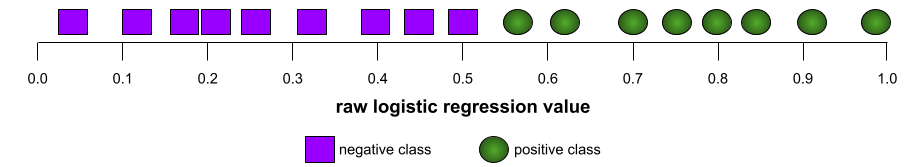

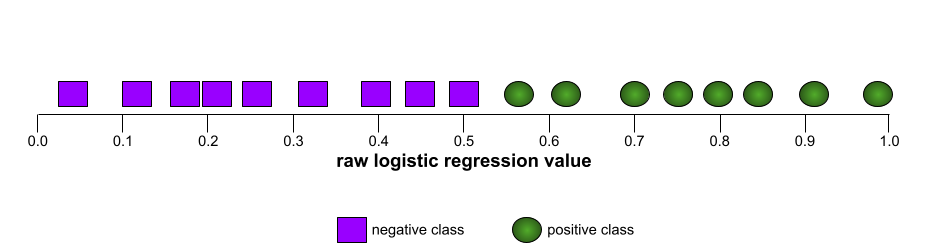

AUC (área bajo la curva ROC)

Es un número entre 0.0 y 1.0 que representa la capacidad de un modelo de clasificación binaria para separar las clases positivas de las clases negativas. Cuanto más cerca esté el AUC de 1.0, mejor será la capacidad del modelo para separar las clases entre sí.

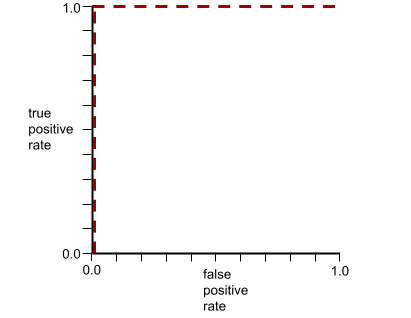

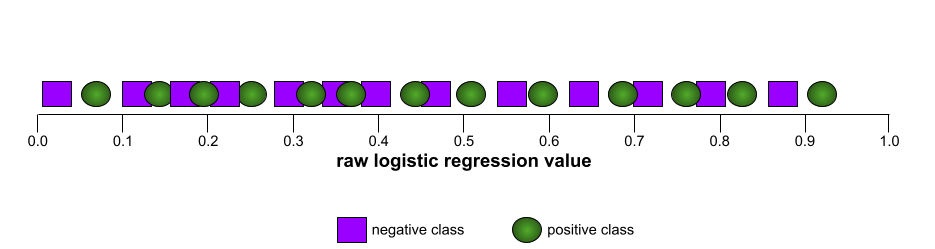

Por ejemplo, la siguiente ilustración muestra un modelo de clasificación que separa perfectamente las clases positivas (óvalos verdes) de las clases negativas (rectángulos morados). Este modelo perfecto poco realista tiene un AUC de 1.0:

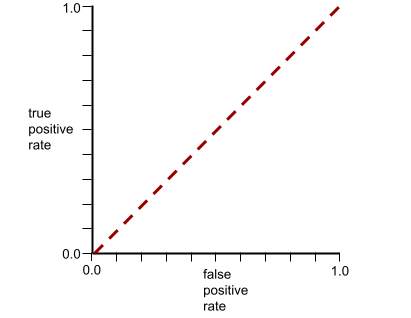

Por el contrario, la siguiente ilustración muestra los resultados de un modelo de clasificación que generó resultados aleatorios. Este modelo tiene un AUC de 0.5:

Sí, el modelo anterior tiene un AUC de 0.5, no de 0.0.

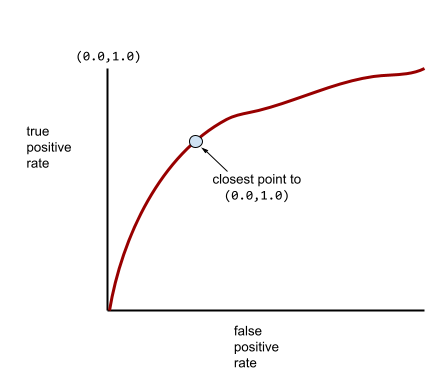

La mayoría de los modelos se encuentran en algún punto intermedio entre los dos extremos. Por ejemplo, el siguiente modelo separa los positivos de los negativos en cierta medida y, por lo tanto, tiene un AUC entre 0.5 y 1.0:

El AUC ignora cualquier valor que establezcas para el umbral de clasificación. En cambio, el AUC considera todos los umbrales de clasificación posibles.

Para obtener más información, consulta Clasificación: ROC y AUC en el Curso intensivo de aprendizaje automático.

realidad aumentada

Es una tecnología que superpone una imagen generada por computadora en la vista del mundo real de un usuario, lo que proporciona una vista compuesta.

Codificador automático

Es un sistema que aprende a extraer la información más importante de la entrada. Los codificadores automáticos son una combinación de un codificador y un decodificador. Los autoencoders se basan en el siguiente proceso de dos pasos:

- El codificador asigna la entrada a un formato (intermedio) de menor dimensión (por lo general, con pérdida).

- El decodificador crea una versión con pérdidas de la entrada original, mapeando el formato de menor dimensión al formato de entrada original de mayor dimensión.

Los codificadores automáticos se entrenan de extremo a extremo haciendo que el decodificador intente reconstruir la entrada original a partir del formato intermedio del codificador de la manera más precisa posible. Dado que el formato intermedio es más pequeño (de menor dimensión) que el formato original, el codificador automático se ve obligado a aprender qué información de la entrada es esencial, y la salida no será perfectamente idéntica a la entrada.

Por ejemplo:

- Si los datos de entrada son un gráfico, la copia no exacta sería similar al gráfico original, pero con algunas modificaciones. Quizás la copia no exacta quite el ruido del gráfico original o complete algunos píxeles faltantes.

- Si los datos de entrada son texto, un autoencoder generaría un nuevo texto que imita (pero no es idéntico a) el texto original.

Consulta también codificadores automáticos variacionales.

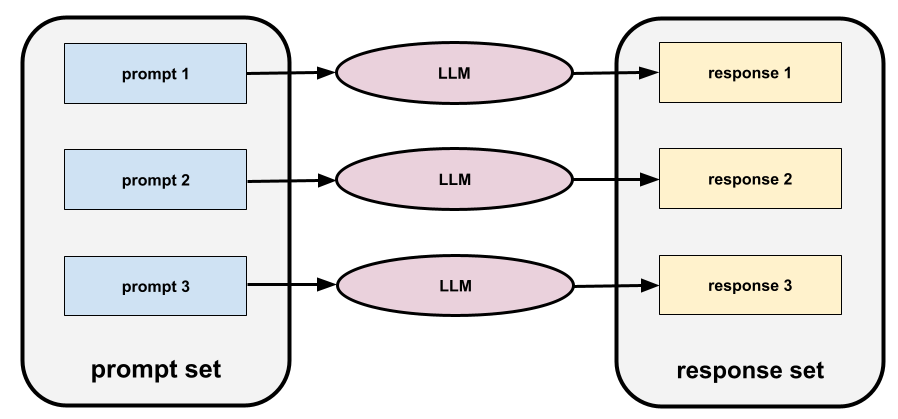

evaluación automática

Usar software para juzgar la calidad del resultado de un modelo

Cuando el resultado del modelo es relativamente sencillo, una secuencia de comandos o un programa pueden comparar el resultado del modelo con una respuesta ideal. A veces, este tipo de evaluación automática se denomina evaluación programática. Las métricas como ROUGE o BLEU suelen ser útiles para la evaluación programática.

Cuando la salida del modelo es compleja o no tiene una respuesta correcta, a veces un programa de aprendizaje automático separado llamado autorater realiza la evaluación automática.

Contrasta con evaluación humana.

sesgo de automatización

Cuando una persona que toma decisiones favorece las recomendaciones hechas por un sistema automático de decisión por sobre la información obtenida sin automatización, incluso cuando el sistema de decisión automatizado comete un error.

Consulta Equidad: Tipos de sesgo en el Curso intensivo de aprendizaje automático para obtener más información.

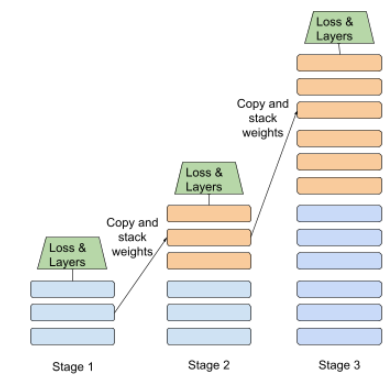

AutoML

Cualquier proceso automatizado para compilar modelos de aprendizaje automático AutoML puede realizar automáticamente tareas como las siguientes:

- Busca el modelo más adecuado.

- Ajusta los hiperparámetros.

- Prepara los datos (incluida la ingeniería de atributos).

- Implementa el modelo resultante.

AutoML resulta útil para los científicos de datos porque les permite ahorrar tiempo y esfuerzo en el desarrollo de flujos de trabajo de aprendizaje automático y mejorar la precisión de las predicciones. También resulta útil para personas no expertas, al hacer más accesibles para ellas las tareas complejas de aprendizaje automático.

Consulte Aprendizaje automático automatizado (AutoML) en el Curso intensivo de aprendizaje automático para obtener más información.

Evaluación del evaluador automático

Es un mecanismo híbrido para juzgar la calidad del resultado de un modelo de IA generativa que combina la evaluación humana con la evaluación automática. Un evaluador automático es un modelo de AA entrenado con datos creados por la evaluación humana. Idealmente, un autor debería aprender a imitar a un evaluador humano.Hay autorraters prediseñados disponibles, pero los mejores se ajustan específicamente para la tarea que evalúas.

modelo autorregresivo

Un modelo que infiere una predicción en función de sus propias predicciones anteriores. Por ejemplo, los modelos de lenguaje autorregresivos predicen el siguiente token en función de los tokens predichos anteriormente. Todos los modelos de lenguaje grandes basados en Transformer son de regresión automática.

En cambio, los modelos de imágenes basados en GAN no suelen ser autorregresivos, ya que generan una imagen en un solo pase hacia adelante y no de forma iterativa en pasos. Sin embargo, ciertos modelos de generación de imágenes son autorregresivos porque generan una imagen en pasos.

Pérdida auxiliar

Una función de pérdida, que se usa junto con la función de pérdida principal del modelo de red neuronal, que ayuda a acelerar el entrenamiento durante las primeras iteraciones cuando los pesos se inicializan de forma aleatoria.

Las funciones de pérdida auxiliares envían gradientes efectivos a las capas anteriores. Esto facilita la convergencia durante el entrenamiento, ya que combate el problema de desvanecimiento del gradiente.

Precisión promedio en k

Es una métrica para resumir el rendimiento de un modelo en una sola instrucción que genera resultados clasificados, como una lista numerada de recomendaciones de libros. La precisión promedio en k es, bueno, el promedio de los valores de precisión en k para cada resultado relevante. Por lo tanto, la fórmula para la precisión promedio en k es la siguiente:

\[{\text{average precision at k}} = \frac{1}{n} \sum_{i=1}^n {\text{precision at k for each relevant item} } \]

Donde:

- \(n\) es el número de elementos relevantes en la lista.

Contrasta con recuerdo en k.

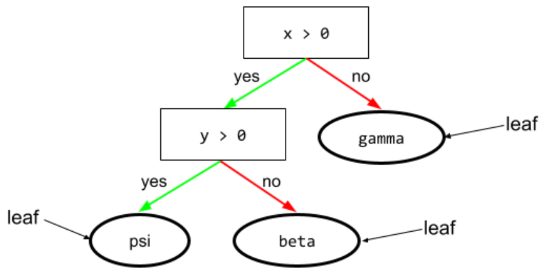

Condición alineada con el eje

En un árbol de decisión, una condición que involucra solo una característica. Por ejemplo, si area es una característica, la siguiente es una condición alineada con el eje:

area > 200

Contrasta con la condición oblicua .

B

propagación inversa

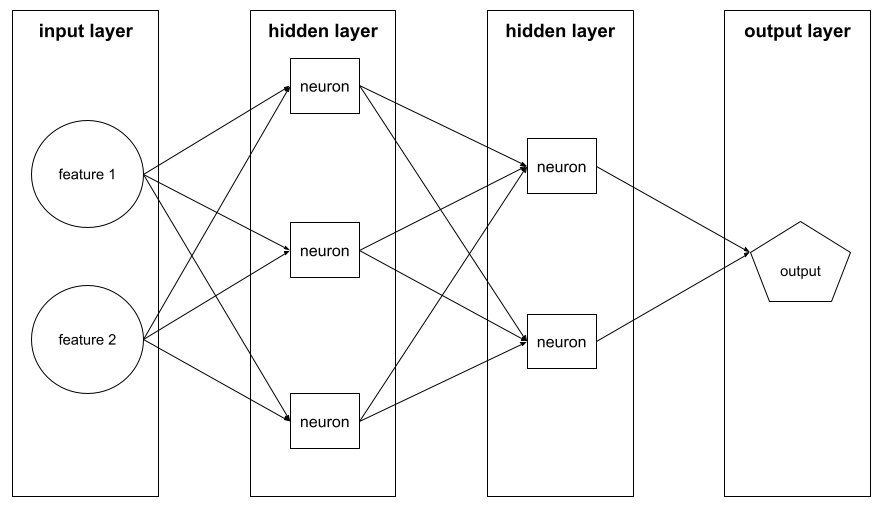

Es el algoritmo que implementa el descenso de gradientes en las redes neuronales.

El entrenamiento de una red neuronal implica muchas iteraciones del siguiente ciclo de dos pasos:

- Durante el pase hacia adelante, el sistema procesa un lote de ejemplos para generar predicciones. El sistema compara cada predicción con cada valor de etiqueta. La diferencia entre la predicción y el valor de la etiqueta es la pérdida para ese ejemplo. El sistema agrega las pérdidas de todos los ejemplos para calcular la pérdida total del lote actual.

- Durante el pase hacia atrás (retropropagación), el sistema reduce la pérdida ajustando los pesos de todas las neuronas en todas las capas ocultas.

Las redes neuronales suelen contener muchas neuronas en muchas capas ocultas. Cada una de esas neuronas contribuye a la pérdida general de diferentes maneras. La retropropagación determina si se deben aumentar o disminuir los pesos aplicados a neuronas específicas.

La tasa de aprendizaje es un multiplicador que controla el grado en que cada pase hacia atrás aumenta o disminuye cada peso. Una tasa de aprendizaje grande aumentará o disminuirá cada peso más que una tasa de aprendizaje pequeña.

En términos de cálculo, la retropropagación implementa la regla de la cadena del cálculo. Es decir, la retropropagación calcula la derivada parcial del error con respecto a cada parámetro.

Hace años, los profesionales del AA tenían que escribir código para implementar la retropropagación. Las APIs de AA modernas, como Keras, ahora implementan la retropropagación por ti. ¡Vaya!

Consulte Redes neuronales en el Curso intensivo de aprendizaje automático para obtener más información.

harpillera

Es un método para entrenar un ensamble en el que cada modelo constituyente se entrena con un subconjunto aleatorio de ejemplos de entrenamiento muestreados con reemplazo. Por ejemplo, un bosque aleatorio es una colección de árboles de decisión entrenados con bagging.

El término bagging es la abreviatura de bootstrap aggregating.

Consulta Bosques aleatorios en el curso de Bosques de decisión para obtener más información.

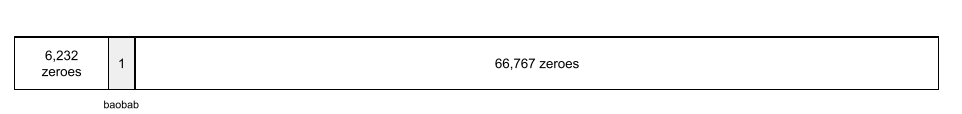

bolsa de palabras

Representación de las palabras de una frase o pasaje, sin importar el orden. Por ejemplo, una bolsa de palabras representa las tres frases siguientes de forma idéntica:

- el perro salta

- salta el perro

- perro salta el

Cada palabra se asigna a un índice en un vector disperso, donde el vector tiene un índice para cada palabra del vocabulario. Por ejemplo, la frase el perro salta se asigna a un vector de atributos con valores distintos de cero en los tres índices correspondientes a las palabras el, perro y salta. El valor distinto de cero puede ser alguno de los siguientes:

- Un 1 para indicar la presencia de una palabra.

- Es el recuento de la cantidad de veces que una palabra aparece en la bolsa. (por ejemplo, si la frase fuera el perro negro es un perro con pelaje negro, entonces tanto negro como perro se representarían con un 2, mientras que las demás palabras con un 1)

- Algún otro valor como por ejemplo el logaritmo de la cantidad de veces que una palabra aparece en la bolsa

modelo de referencia

Un modelo que se usa como punto de referencia para comparar el rendimiento de otro modelo (por lo general, uno más complejo). Por ejemplo, un modelo de regresión logística podría servir como un buen modelo de referencia para un modelo profundo.

Para un problema específico, la línea base ayuda a los desarrolladores de modelos a cuantificar el rendimiento mínimo esperado que un nuevo modelo debe alcanzar para que resulte útil.

modelo base

Un modelo previamente entrenado que puede servir como punto de partida para el ajuste para abordar tareas o aplicaciones específicas.

Consulta también modelo previamente entrenado y modelo fundamental.

lote

Es el conjunto de ejemplos que se usan en una iteración de entrenamiento. El tamaño del lote determina la cantidad de ejemplos en un lote.

Consulta época para obtener una explicación de cómo se relaciona un lote con una época.

Consulta Regresión lineal: Hiperparámetros en el Curso intensivo de aprendizaje automático para obtener más información.

inferencia por lotes

El proceso de inferir predicciones en múltiples ejemplos no etiquetados divididos en subconjuntos más pequeños ("lotes").

La inferencia por lotes puede aprovechar las funciones de paralelización de los chips aceleradores. Es decir, varios aceleradores pueden inferir predicciones de forma simultánea en diferentes lotes de ejemplos sin etiquetar, lo que aumenta drásticamente la cantidad de inferencias por segundo.

Para obtener más información, consulta Sistemas de AA en producción: inferencia estática versus dinámica en el Curso intensivo de aprendizaje automático.

Normalización por lotes

Normalizar la entrada o la salida de las funciones de activación en una capa oculta La normalización por lotes puede proporcionar los siguientes beneficios:

- Hacer las redes neuronales más estables protegiéndolas de valores atípicos de pesos

- Permitir tasas de aprendizaje más altas, lo que puede acelerar el entrenamiento

- Reducir el sobreajuste

tamaño del lote

Es la cantidad de ejemplos en un lote. Por ejemplo, si el tamaño del lote es 100, el modelo procesa 100 ejemplos por iteración.

A continuación, se indican algunas estrategias populares para determinar el tamaño del lote:

- Descenso de gradientes estocástico (SGD), en el que el tamaño del lote es 1

- Lote completo, en el que el tamaño del lote es la cantidad de ejemplos en todo el conjunto de entrenamiento. Por ejemplo, si el conjunto de entrenamiento contiene un millón de ejemplos, el tamaño del lote sería de un millón de ejemplos. Por lo general, el procesamiento por lotes completo es una estrategia ineficiente.

- Minilote, en el que el tamaño del lote suele ser entre 10 y 1,000. Por lo general, el minilote es la estrategia más eficiente.

Consulte los siguientes artículos para obtener más información:

- Sistemas de AA de producción: inferencia estática frente a inferencia dinámica en el Curso intensivo de aprendizaje automático.

- Guía de ajuste del aprendizaje profundo.

Red neuronal bayesiana

Una red neuronal probabilística que tiene en cuenta la incertidumbre en los pesos y los resultados. Un modelo de regresión de red neuronal estándar suele predecir un valor escalar; por ejemplo, un modelo estándar predice el precio de una casa en 853,000. En contraste, una red neuronal Bayesiana predice una distribución de valores, por ejemplo, un modelo Bayesiano predice el precio de una casa en 853,000 con una desviación estándar de 67,200.

Las redes neuronales bayesianas se basan en el teorema de Bayes para calcular la incertidumbre entre pesos y predicciones. Una red neuronal bayesiana puede ser útil en los casos en que se precisa calcular el grado de incertidumbre, como en modelos relacionados con la industria farmacéutica. Las redes neuronales Bayesianas también pueden ayudar a reducir el sobreajuste.

Optimización bayesiana

Técnica de modelo de regresión probabilística para optimizar funciones objetivo costosas desde el punto de vista computacional. En cambio, se optimiza un sustituto que cuantifica la incertidumbre con una técnica de aprendizaje bayesiano. Dado que la optimización bayesiana es muy costosa, se suele usar para optimizar tareas costosas de evaluar que tienen una pequeña cantidad de parámetros, como la selección de hiperparámetros.

Ecuación de Bellman

En el aprendizaje por refuerzo, la siguiente identidad satisface la función Q óptima:

\[Q(s, a) = r(s, a) + \gamma \mathbb{E}_{s'|s,a} \max_{a'} Q(s', a')\]

Los algoritmos de aprendizaje por refuerzo aplican esta identidad para crear el aprendizaje Q con la siguiente regla de actualización:

\[Q(s,a) \gets Q(s,a) + \alpha \left[r(s,a) + \gamma \displaystyle\max_{\substack{a_1}} Q(s',a') - Q(s,a) \right] \]

Más allá del aprendizaje por refuerzo, la ecuación de Bellman tiene aplicaciones en la programación dinámica. Consulta la entrada de Wikipedia sobre la ecuación de Bellman.

BERT (Bidirectional Encoder Representations from Transformers)

Es una arquitectura de modelo para la representación de texto. Un modelo BERT entrenado puede actuar como parte de un modelo más grande para la clasificación de texto o para otras tareas de AA.

BERT tiene las siguientes características:

- Utiliza la arquitectura Transformer y, por lo tanto, se basa en la autoatención.

- Usa la parte del codificador del Transformer. El trabajo del codificador es producir buenas representaciones de texto, en lugar de realizar una tarea específica como la clasificación.

- ¿Es bidireccional?

- Utiliza el enmascaramiento para el entrenamiento no supervisado.

Las variantes de BERT incluyen las siguientes:

Consulta Open Sourcing BERT: State-of-the-Art Pre-training for Natural Language Processing para obtener una descripción general de BERT.

sesgo (ética/equidad)

1. Estereotipo, prejuicio o preferencia de cosas, personas o grupos por sobre otros. Estos sesgos pueden afectar la recopilación y la interpretación de datos, el diseño de un sistema y cómo los usuarios interactúan con él. Algunos tipos de este sesgo incluyen:

- sesgo de automatización

- Sesgo de confirmación

- Sesgo del experimentador

- sesgo de correspondencia

- Sesgo implícito

- Sesgo endogrupal

- Sesgo de homogeneidad de los demás

2. Error sistemático debido a un procedimiento de muestreo o de realización de un informe. Algunos tipos de este sesgo incluyen:

- Sesgo de cobertura

- Sesgo de no respuesta

- Sesgo de participación

- Sesgo de reporte

- sesgo de muestreo

- sesgo de selección

No se debe confundir con el término de sesgo en los modelos de aprendizaje automático ni con el sesgo de predicción.

Consulta Equidad: Tipos de sesgo en el Curso intensivo de aprendizaje automático para obtener más información.

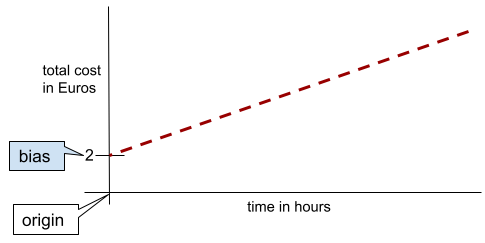

sesgo (matemático) o término de sesgo

Una intersección o desplazamiento de un origen. La ordenada al origen es un parámetro en los modelos de aprendizaje automático, que se simboliza con cualquiera de los siguientes:

- b

- w0

Por ejemplo, la ordenada al origen es la b en la siguiente fórmula:

En una línea bidimensional simple, el sesgo solo significa "intersección con el eje Y". Por ejemplo, la ordenada al origen de la línea en la siguiente ilustración es 2.

El sesgo existe porque no todos los modelos comienzan desde el origen (0,0). Por ejemplo, supongamos que la entrada a un parque de diversiones cuesta EUR 2 y se cobra EUR 0.5 adicionales por cada hora que se queda un cliente. Por lo tanto, un modelo que asigna el costo total tiene un sesgo de 2 porque el costo más bajo es de 2 euros.

El sesgo no se debe confundir con el sesgo en ética y equidad ni con el sesgo de predicción.

Consulta Regresión lineal en el Curso intensivo de aprendizaje automático para obtener más información.

bidireccional

Término que se usa para describir un sistema que evalúa el texto que precede y sigue a una sección de texto objetivo. En cambio, un sistema unidireccional solo evalúa el texto que precede a una sección de texto objetivo.

Por ejemplo, considere un modelo de lenguaje enmascarado que debe determinar las probabilidades de la palabra o palabras que representan el subrayado en la siguiente pregunta:

¿Qué te _____?

Un modelo de lenguaje unidireccional tendría que basar sus probabilidades solo en el contexto proporcionado por las palabras "¿Cuál", "es" y "el". En cambio, un modelo de lenguaje bidireccional también podría obtener contexto de "con" y "tú", lo que podría ayudarlo a generar mejores predicciones.

modelo de lenguaje bidireccional

Un modelo de lenguaje que determina la probabilidad de que un token dado esté presente en una ubicación determinada en un extracto de texto basado en el texto anterior y el texto posterior.

bigrama

Un n-grama en el que N=2.

Clasificación binaria

Es un tipo de tarea de clasificación que predice una de dos clases mutuamente exclusivas:

- la clase positiva

- la clase negativa

Por ejemplo, los dos siguientes modelos de aprendizaje automático realizan cada uno una clasificación binaria:

- Un modelo que determina si los mensajes de correo electrónico son spam (la clase positiva) o no son spam (la clase negativa).

- Un modelo que evalúa los síntomas médicos para determinar si una persona tiene una enfermedad en particular (clase positiva) o no la tiene (clase negativa).

Compara esto con la clasificación de clases múltiples.

Consulta también regresión logística y umbral de clasificación.

Consulte Clasificación en el Curso intensivo de aprendizaje automático para obtener más información.

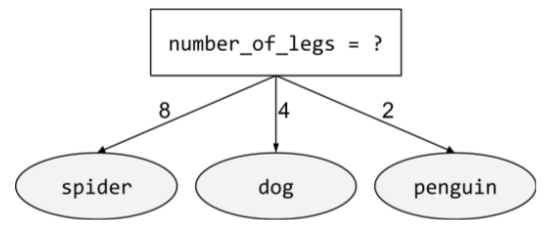

condición binaria

En un árbol de decisión, una condición que tiene solo dos resultados posibles, por lo general, sí o no. Por ejemplo, la siguiente es una condición binaria:

temperature >= 100

Compara esto con la condición no binaria.

Consulte Tipos de condiciones en el curso de Bosques de Decisión para obtener más información.

discretización

Sinónimo de agrupamiento.

Modelo de caja negra

Un modelo cuyo "razonamiento" es imposible o difícil de entender para los humanos. Es decir, si bien las personas pueden ver cómo las instrucciones afectan las respuestas, no pueden determinar con exactitud cómo un modelo de caja negra determina la respuesta. En otras palabras, un modelo de caja negra carece de interpretabilidad.

La mayoría de los modelos profundos y los modelos de lenguaje grandes son cajas negras.

BLEU (Bilingual Evaluation Understudy)

Una métrica entre 0.0 y 1.0 para evaluar traducciones automáticas, por ejemplo, del español al japonés.

Para calcular una puntuación, BLEU normalmente compara la traducción de un modelo de aprendizaje automático (texto generado) con la traducción de un experto humano (texto de referencia). El grado en que los N-gramas en el texto generado y el texto de referencia coinciden determina la puntuación BLEU.

El documento original sobre esta métrica es BLEU: a Method for Automatic Evaluation of Machine Translation.

Consulta también BLEURT.

BLEURT (Bilingual Evaluation Understudy from Transformers)

Es una métrica para evaluar las traducciones automáticas de un idioma a otro, en especial, hacia y desde el inglés.

En el caso de las traducciones desde y hacia el inglés, BLEURT se alinea más estrechamente con las calificaciones humanas que BLEU. A diferencia de BLEU, BLEURT enfatiza las similitudes semánticas (de significado) y puede adaptarse al parafraseo.

BLEURT se basa en un modelo de lenguaje grande preentrenado (BERT para ser exactos) que luego se ajusta con texto de traductores humanos.

El documento original sobre esta métrica es BLEURT: Learning Robust Metrics for Text Generation.

potenciación

Una técnica de aprendizaje automático que combina iterativamente un conjunto de modelos de clasificación simples y no muy precisos (denominados "clasificadores débiles") en un modelo de clasificación con alta precisión (un "clasificador fuerte") mediante aumentar el peso de los ejemplos que el modelo actualmente está clasificando mal.

Consulta ¿Qué son los árboles de decisión potenciados por gradientes? en el curso de Bosques de decisión para obtener más información.

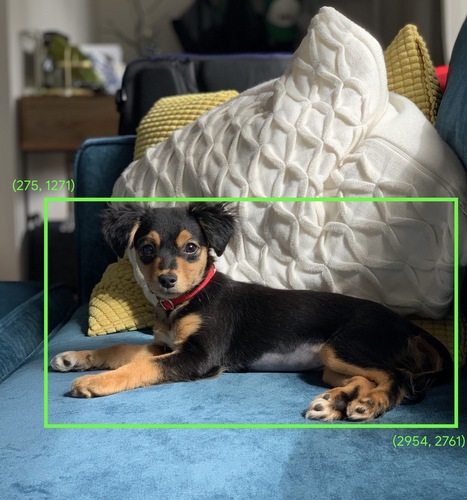

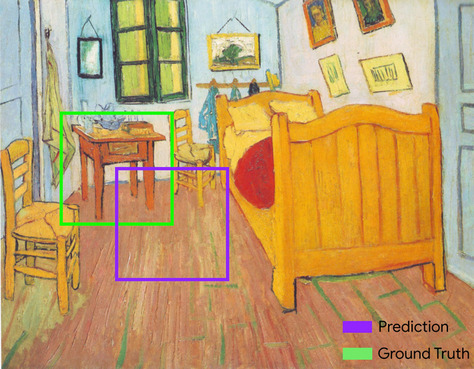

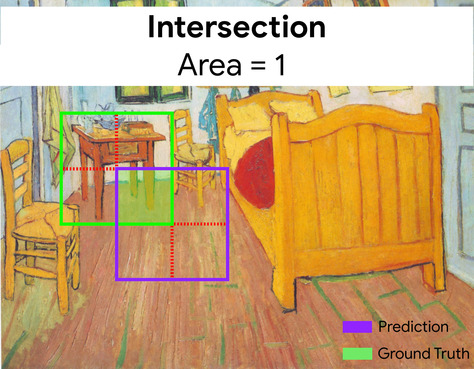

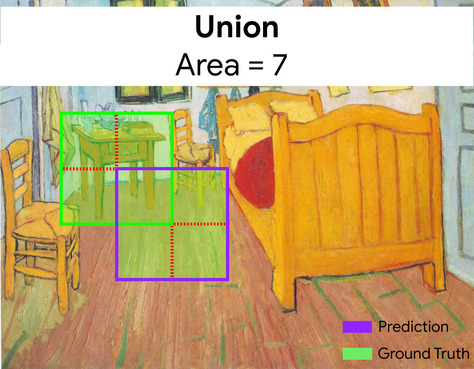

cuadro de límite

En una imagen, las coordenadas (x, y) de un rectángulo alrededor de un área de interés, como el perro en la siguiente imagen.

transmisión

En una operación matemática de matrices, expansión de la forma de un operando a dimensiones compatibles para esa operación. Por ejemplo, el álgebra lineal requiere que los dos operandos en una operación de suma de matrices tengan las mismas dimensiones. En consecuencia, no se puede agregar una matriz de forma (m, n) a un vector de longitud n. La transmisión permite esta operación expandiendo virtualmente el vector de longitud n en una matriz de forma (m, n) replicando los mismos valores en cada columna.

Para obtener más detalles, consulta la siguiente descripción de la emisión en NumPy.

Agrupamiento

Conversión de un solo atributo en varios atributos binarios denominados agrupamientos o discretizaciones, que en general se basan en un rango de valores. Por lo general, el atributo segmentado es un atributo continuo.

Por ejemplo, en lugar de representar la temperatura como una única característica continua de punto flotante, podría dividir los rangos de temperaturas en intervalos discretos, como por ejemplo:

- Los valores inferiores o iguales a 10 grados Celsius se incluirían en el bucket de "frío".

- El intervalo de 11 a 24 grados Celsius sería el intervalo "templado".

- Los valores mayores o iguales a 25 grados Celsius se incluirían en el bucket "cálido".

El modelo tratará cada valor del mismo bucket de forma idéntica. Por ejemplo, los valores 13 y 22 se encuentran en el bucket de temperatura, por lo que el modelo trata ambos valores de forma idéntica.

Consulta Datos numéricos: discretización en el Curso intensivo de aprendizaje automático para obtener más información.

C

Capa de calibración

Ajuste posterior a la predicción, generalmente para dar cuenta del sesgo de predicción. Las predicciones ajustadas y las probabilidades deben coincidir con la distribución del conjunto de etiquetas observado.

generación de candidatos

Conjunto inicial de recomendaciones elegidas por un sistema de recomendación. Por ejemplo, considera una librería que ofrece 100,000 títulos. La fase de generación de candidatos crea una lista mucho menor de libros adecuados para un usuario específico, digamos 500. Pero incluso 500 libros son demasiados para recomendar a un usuario. Las fases posteriores y más costosas de un sistema de recomendación (como la puntuación y la reclasificación) reducen esos 500 libros a un conjunto de recomendaciones mucho más pequeño y útil.

Para obtener más información, consulta la descripción general de la generación de candidatos en el curso de Sistemas de recomendación.

muestreo de candidatos

Es una optimización del entrenamiento que calcula una probabilidad para todas las etiquetas positivas, por ejemplo, con softmax, pero solo para una muestra aleatoria de etiquetas negativas. Por ejemplo, dado un ejemplo etiquetado como beagle y perro, el muestreo de candidatos calcula las probabilidades predichas y los términos de pérdida correspondientes para lo siguiente:

- beagle

- perro

- un subconjunto aleatorio de las clases negativas restantes (por ejemplo, gato, golosina, cerca)

La idea es que las clases negativas pueden aprender de un refuerzo negativo menos frecuente, siempre y cuando las clases positivas siempre reciban el refuerzo positivo apropiado, y esto se observa empíricamente.

El muestreo de candidatos es más eficiente computacionalmente que los algoritmos de entrenamiento que calculan predicciones para todas clases negativas, particularmente cuando el número de clases negativas es muy grande.

datos categóricos

Características que tienen un conjunto específico de valores posibles. Por ejemplo, considere una característica categórica llamada traffic-light-state, que solo puede tener uno de los siguientes tres valores posibles:

redyellowgreen

Al representar traffic-light-state como una característica categórica, un modelo puede aprender los diferentes impactos de red, green y yellow en el comportamiento del conductor.

Las características categóricas a veces se denominan características discretas.

Compara esto con los datos numéricos.

Consulte Trabajar con datos categóricos en el Curso intensivo de aprendizaje automático para obtener más información.

modelo de lenguaje causal

Sinónimo de modelo de lenguaje unidireccional.

Consulte modelo de lenguaje bidireccional para contrastar diferentes enfoques direccionales en el modelado del lenguaje.

centroid

Es el centro de un clúster determinado por un algoritmo de k-means o k-median. Por ejemplo, si k es 3, entonces el algoritmo k-means o k-median encuentra 3 centroides.

Consulta Algoritmos de agrupamiento en el curso de Clustering para obtener más información.

agrupamiento en clústeres basado en centroides

Categoría de algoritmos de agrupamiento en clústeres que organiza los datos en clústeres no jerárquicos. k-means es el algoritmo de agrupamiento en clústeres basado en centroides más utilizado.

Compara esto con los algoritmos de agrupamiento en clústeres jerárquico.

Consulta Algoritmos de agrupamiento en el curso de Clustering para obtener más información.

Cadena de pensamientos

Una técnica de ingeniería de prompts que anima a un modelo de lenguaje grande (LLM) a explicar su razonamiento, paso a paso. Por ejemplo, considere la siguiente pregunta, prestando especial atención a la segunda oración:

¿Cuántas fuerzas G experimentaría un conductor en un automóvil que va de 0 a 96.56 km/h en 7 segundos? En la respuesta, muestra todos los cálculos pertinentes.

La respuesta del LLM probablemente sería:

- Muestre una secuencia de fórmulas de física, sustituyendo los valores 0, 60 y 7 en los lugares apropiados.

- Explica por qué eligió esas fórmulas y qué significan las distintas variables.

La instrucción de cadena de pensamientos obliga al LLM a realizar todos los cálculos, lo que podría generar una respuesta más correcta. Además, el encadenamiento de pensamientos permite que el usuario examine los pasos del LLM para determinar si la respuesta tiene sentido.

Puntuación F del N-grama de caracteres (ChrF)

Es una métrica para evaluar los modelos de traducción automática. La puntuación F de n-gramas de caracteres determina el grado en que los n-gramas del texto de referencia se superponen con los n-gramas del texto generado de un modelo de AA.

La puntuación F del N-grama de caracteres es similar a las métricas de las familias ROUGE y BLEU, excepto que:

- La puntuación F del N-grama de caracteres opera sobre N-gramas de caracter.

- ROUGE y BLEU operan sobre word N-gramas o tokens.

chatear

Contenido de un diálogo bidireccional con un sistema de AA, por lo general, un modelo de lenguaje grande. La interacción anterior en un chat (lo que escribiste y cómo respondió el modelo de lenguaje grande) se convierte en el contexto para las partes posteriores del chat.

Un chatbot es una aplicación de un modelo de lenguaje grande.

punto de control

Son los datos que capturan el estado de los parámetros de un modelo durante el entrenamiento o después de que este se completa. Por ejemplo, durante el entrenamiento, puedes hacer lo siguiente:

- Deje de entrenar, quizás intencionalmente o quizás como resultado de ciertos errores.

- Captura el punto de control.

- Más adelante, vuelve a cargar el punto de control, posiblemente en hardware diferente.

- Reiniciar el entrenamiento.

clase

Es una categoría a la que puede pertenecer una etiqueta. Por ejemplo:

- En un modelo de clasificación binaria que detecta spam, las dos clases podrían ser spam y no spam.

- En un modelo de clasificación de varias clases que identifica razas de perros, las clases podrían ser caniche, beagle, pug, etcétera.

Un modelo de clasificación predice una clase. Por el contrario, un modelo de regresión predice un número en lugar de una clase.

Consulta Clasificación en el Curso intensivo de aprendizaje automático para obtener más información.

conjunto de datos equilibrado por clase

Un conjunto de datos que contiene etiquetas categóricas en el que la cantidad de instancias de cada categoría es aproximadamente igual. Por ejemplo, considera un conjunto de datos botánicos cuya etiqueta binaria puede ser planta nativa o planta no nativa:

- Un conjunto de datos con 515 plantas nativas y 485 plantas no nativas es un conjunto de datos equilibrado por clase.

- Un conjunto de datos con 875 plantas nativas y 125 plantas no nativas es un conjunto de datos con desequilibrio de clases.

No existe una línea divisoria formal entre los conjuntos de datos con equilibrio de clases y los conjuntos de datos con desequilibrio de clases. La distinción solo se vuelve importante cuando un modelo entrenado en un conjunto de datos con un desequilibrio de clases significativo no puede converger. Consulta Conjuntos de datos: conjuntos de datos desequilibrados en el Curso intensivo de aprendizaje automático para obtener más información.

modelo de clasificación

Un modelo cuya predicción es una clase. Por ejemplo, los siguientes son todos modelos de clasificación:

- Un modelo que predice el idioma de una oración de entrada (¿francés? ¿Español? ¿Italiano?

- Un modelo que predice especies de árboles (¿arce? ¿Roble? ¿Baobab?).

- Un modelo que predice la clase positiva o negativa para una condición médica particular.

Por el contrario, los modelos de regresión predicen números en lugar de clases.

Estos son dos tipos comunes de modelos de clasificación:

umbral de clasificación

En una clasificación binaria, es un número entre 0 y 1 que convierte el resultado sin procesar de un modelo de regresión logística en una predicción de la clase positiva o la clase negativa. Ten en cuenta que el umbral de clasificación es un valor que elige una persona, no un valor que se elige durante el entrenamiento del modelo.

Un modelo de regresión logística genera un valor sin procesar entre 0 y 1. Luego:

- Si este valor sin procesar es mayor que el umbral de clasificación, se predice la clase positiva.

- Si este valor sin procesar es menor que el umbral de clasificación, se predice la clase negativa.

Por ejemplo, supongamos que el umbral de clasificación es 0.8. Si el valor sin procesar es 0.9, el modelo predice la clase positiva. Si el valor sin procesar es 0.7, el modelo predice la clase negativa.

La elección del umbral de clasificación influye en gran medida en la cantidad de falsos positivos y falsos negativos.

Consulte Umbrales y la matriz de confusión en el Curso intensivo de aprendizaje automático para obtener más información.

clasificador

Término informal para un modelo de clasificación.

conjunto de datos con desequilibrio de clases

Un conjunto de datos para una clasificación en la que la cantidad total de etiquetas de cada clase difiere significativamente. Por ejemplo, considera un conjunto de datos de clasificación binaria cuyas dos etiquetas se dividen de la siguiente manera:

- 1,000,000 de etiquetas negativas

- 10 etiquetas positivas

La proporción de etiquetas negativas y positivas es de 100,000 a 1, por lo que se trata de un conjunto de datos con desequilibrio de clases.

En cambio, el siguiente conjunto de datos está equilibrado en cuanto a las clases porque la proporción de etiquetas negativas y positivas es relativamente cercana a 1:

- 517 etiquetas negativas

- 483 etiquetas positivas

Los conjuntos de datos de varias clases también pueden tener un desequilibrio de clases. Por ejemplo, el siguiente conjunto de datos de clasificación multiclase también está desequilibrado en cuanto a las clases, ya que una etiqueta tiene muchos más ejemplos que las otras dos:

- 1,000,000 de etiquetas con la clase "verde"

- 200 etiquetas de clase "morado"

- 350 etiquetas con la clase "naranja"

El entrenamiento de conjuntos de datos con clases desequilibradas puede presentar desafíos especiales. Consulta Conjuntos de datos desequilibrados en el Curso intensivo de aprendizaje automático para obtener más detalles.

Consulta también entropía, clase mayoritaria y clase minoritaria.

recorte

Técnica para manejar valores atípicos realizando una o ambas de las siguientes acciones:

- Se reducen los valores de características que superan un umbral máximo hasta ese umbral.

- Se incrementan hasta un umbral mínimo aquellos valores de atributo que sean menores.

Por ejemplo, supongamos que menos del 0.5% de los valores de un atributo en particular se encuentran fuera del rango de 40 a 60. En ese caso, puedes hacer lo siguiente:

- Recorta todos los valores superiores a 60 (el umbral máximo) para que sean exactamente 60.

- Recortar todos los valores inferiores a 40 (el umbral mínimo) para que sean exactamente 40.

Los valores atípicos pueden dañar los modelos y, a veces, provocar un desbordamiento de los pesos durante el entrenamiento. Algunos valores atípicos también pueden afectar significativamente las métricas, como la precisión. El recorte es una técnica común para limitar el daño.

El recorte de gradientes fuerza los valores del gradiente dentro de un rango designado durante el entrenamiento.

Consulta Datos numéricos: Normalización en el Curso intensivo de aprendizaje automático para obtener más información.

Cloud TPU

Es un acelerador de hardware especializado diseñado para acelerar las cargas de trabajo de aprendizaje automático en Google Cloud.

agrupamiento

Agrupar ejemplos relacionados, en especial durante el aprendizaje no supervisado Una vez que todos los ejemplos están agrupados, una persona puede, de forma opcional, asignar un significado a cada clúster.

Existen muchos algoritmos de agrupamiento en clústeres. Por ejemplo, el algoritmo de k-means agrupa los ejemplos según su proximidad a un centroide, como se muestra en el siguiente diagrama:

Un investigador humano podría luego revisar los clústeres y, por ejemplo, etiquetar el grupo 1 como "árboles enanos" y el grupo 2 como "árboles grandes".

Otro ejemplo podría ser un algoritmo de agrupamiento basado en la distancia del ejemplo desde un punto central, como se ilustra a continuación:

Consulta el curso sobre clustering para obtener más información.

coadaptación

Es un comportamiento no deseado en el que las neuronas predicen patrones en los datos de entrenamiento basándose casi exclusivamente en salidas de otras neuronas específicas en lugar de basarse en el comportamiento de la red como un todo. Cuando los patrones que causan la coadaptación no están presentes en los datos de validación, la coadaptación provoca un sobreajuste. La regularización de retirados reduce la coadaptación ya que asegura que las neuronas no puedan basarse solo en otras neuronas específicas.

filtrado colaborativo

Realizar predicciones sobre los intereses de un usuario en función de los intereses de muchos otros usuarios El filtrado colaborativo se usa con frecuencia en los sistemas de recomendación.

Para obtener más información, consulta Filtrado colaborativo en el curso de Sistemas de recomendación.

modelo compacto

Cualquier modelo pequeño diseñado para ejecutarse en dispositivos pequeños con recursos de procesamiento limitados. Por ejemplo, los modelos compactos se pueden ejecutar en teléfonos celulares, tablets o sistemas integrados.

procesamiento

(Sustantivo) Recursos de procesamiento que usa un modelo o sistema, como la potencia de procesamiento, la memoria y el almacenamiento.

Consulta los chips aceleradores.

Desviación de conceptos

Un cambio en la relación entre los atributos y la etiqueta Con el tiempo, la desviación de conceptos reduce la calidad de un modelo.

Durante el entrenamiento, el modelo aprende la relación entre los atributos y sus etiquetas en el conjunto de entrenamiento. Si las etiquetas del conjunto de entrenamiento son buenos sustitutos del mundo real, el modelo debería generar buenas predicciones del mundo real. Sin embargo, debido a la desviación de conceptos, las predicciones del modelo tienden a degradarse con el tiempo.

Por ejemplo, considera un modelo de clasificación binaria que predice si un determinado modelo de automóvil es "eficiente en el consumo de combustible" o no. Es decir, los atributos podrían ser los siguientes:

- peso del automóvil

- compresión del motor

- tipo de transmisión

mientras que la etiqueta es:

- eficiente en el consumo de combustible

- No es eficiente en el consumo de combustible

Sin embargo, el concepto de "automóvil con bajo consumo de combustible" cambia constantemente. Un modelo de automóvil etiquetado como eficiente en el consumo de combustible en 1994 casi con certeza se etiquetaría como no eficiente en el consumo de combustible en 2024. Un modelo que sufre de desviación del concepto tiende a hacer predicciones cada vez menos útiles con el tiempo.

Comparar y contrastar con no estacionariedad.

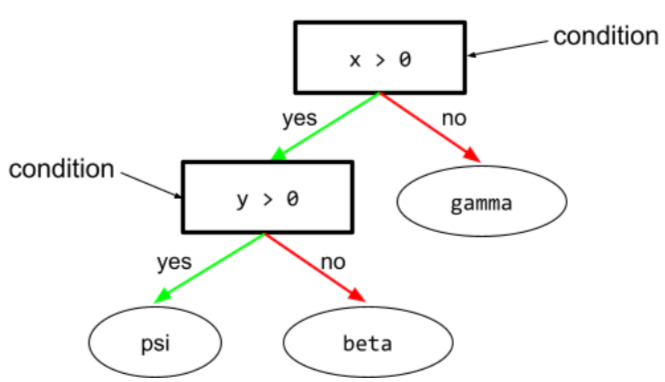

de transición

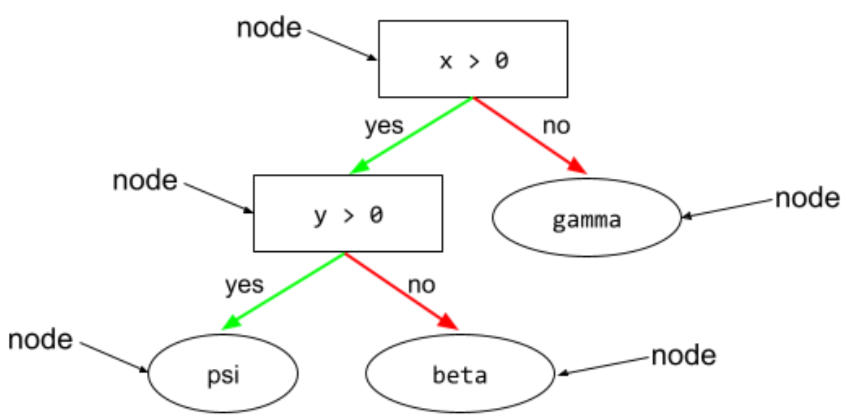

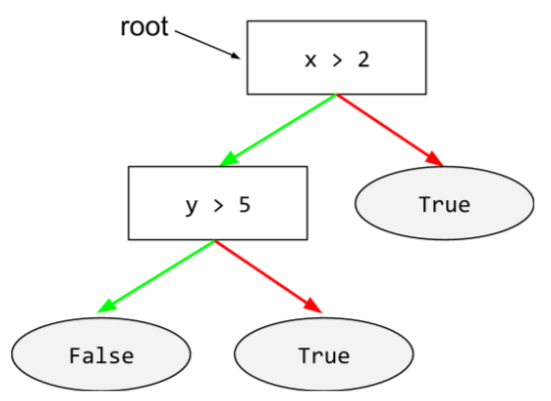

En un árbol de decisión, cualquier nodo que realice una prueba. Por ejemplo, el siguiente árbol de decisión contiene dos condiciones:

Una condición también se denomina división o prueba.

Condición de contraste con hoja.

Consulta lo siguiente:

Consulta Tipos de condiciones en el curso de Bosques de decisión para obtener más información.

confabulación

Sinónimo de alucinación.

Es probable que confabulación sea un término más preciso desde el punto de vista técnico que alucinación. Sin embargo, la alucinación se popularizó primero.

configuración

El proceso de asignar los valores iniciales de las propiedades utilizadas para entrenar un modelo, que incluye:

- el modelo se compone de capas

- La ubicación de los datos

- Hiperparámetros, como los siguientes:

En los proyectos de aprendizaje automático, la configuración se puede realizar a través de un archivo de configuración especial o con bibliotecas de configuración, como las siguientes:

sesgo de confirmación

Tendencia de buscar, interpretar, favorecer y recuperar información de una manera que confirme las creencias o hipótesis preexistentes propias. Los desarrolladores de aprendizaje automático pueden recopilar o etiquetar inadvertidamente los datos de formas que influyan en un resultado que respalde sus creencias. El sesgo de confirmación es una forma de sesgo implícito.

El sesgo de investigación es una forma de sesgo de confirmación en el cual un investigador continúa entrenando modelos hasta confirmar una hipótesis preexistente.

matriz de confusión

Es una tabla de NxN que resume la cantidad de predicciones correctas e incorrectas que realizó un modelo de clasificación. Por ejemplo, considera la siguiente matriz de confusión para un modelo de clasificación binaria:

| Tumor (previsto) | Sin tumor (predicción) | |

|---|---|---|

| Tumor (verdad fundamental) | 18 (TP) | 1 (FN) |

| No tumor (verdad fundamental) | 6 (FP) | 452 (TN) |

En la matriz de confusión anterior, se muestra lo siguiente:

- De las 19 predicciones en las que la verdad fundamental era Tumor, el modelo clasificó correctamente 18 y clasificó incorrectamente 1.

- De las 458 predicciones en las que la verdad fundamental era No Tumor, el modelo clasificó correctamente 452 y clasificó incorrectamente 6.

La matriz de confusión para un problema de clasificación de varias clases puede ayudarte a identificar patrones de errores. Por ejemplo, considera la siguiente matriz de confusión para un modelo de clasificación multiclase de 3 clases que categoriza tres tipos diferentes de iris (virginica, versicolor y setosa). Cuando la verdad fundamental era Virginica, la matriz de confusión muestra que el modelo era mucho más propenso a predecir erróneamente Versicolor que Setosa:

| Setosa (predicha) | Versicolor (previsto) | Virginica (predicción) | |

|---|---|---|---|

| Setosa (verdad sobre el terreno) | 88 | 12 | 0 |

| Versicolor (verdad fundamental) | 6 | 141 | 7 |

| Virginica (verdad fundamental) | 2 | 27 | 109 |

Como otro ejemplo, una matriz de confusión podría revelar que un modelo entrenado para reconocer dígitos escritos a mano tiende a predecir de manera incorrecta 9 en lugar de 4, o 1 en lugar de 7.

Las matrices de confusión contienen suficiente información para calcular una variedad de métricas de rendimiento, incluidas la precisión y la recuperación.

análisis de circunscripciones

Dividir una oración en estructuras gramaticales más pequeñas ("constituyentes") Una parte posterior del sistema de AA, como un modelo de comprensión del lenguaje natural, puede analizar los componentes con mayor facilidad que la oración original. Por ejemplo, considera la siguiente oración:

Mi amigo adoptó dos gatos.

Un analizador sintáctico de constituyentes puede dividir esta oración en los siguientes dos constituyentes:

- Mi amigo es una frase nominal.

- adoptó dos gatos es una frase verbal.

Estos componentes se pueden subdividir aún más en componentes más pequeños. Por ejemplo, la frase verbal

Adopté dos gatos

podría subdividirse aún más en:

- adoptado es un verbo.

- dos gatos es otra frase nominal.

incrustación de lenguaje contextualizado

Una incorporación que se acerca a la "comprensión" de palabras y frases de formas en que pueden hacerlo los hablantes humanos fluidos. Las incorporaciones de lenguaje contextualizadas pueden comprender la sintaxis, la semántica y el contexto complejos.

Por ejemplo, considera las incorporaciones de la palabra en inglés cow. Las incorporaciones más antiguas, como word2vec, pueden representar palabras en inglés de modo que la distancia en el espacio de incorporación de vaca a toro sea similar a la distancia de oveja (oveja hembra) a carnero (oveja macho) o de mujer a hombre. Las incorporaciones de lenguaje contextualizadas pueden ir un paso más allá y reconocer que los angloparlantes a veces usan la palabra cow de manera informal para referirse a una vaca o a un toro.

ventana de contexto

Es la cantidad de tokens que un modelo puede procesar en una instrucción determinada. Cuanto mayor sea la ventana de contexto, más información podrá utilizar el modelo para proporcionar respuestas coherentes y consistentes a la solicitud.

atributo continuo

Una característica de punto flotante con un rango infinito de valores posibles, como temperatura o peso.

Contrasta con característica discreta.

muestreo por conveniencia

Uso de un conjunto de datos no recopilados científicamente con el objetivo de realizar experimentos rápidos. Posteriormente, es fundamental cambiar a un conjunto de datos recopilados científicamente.

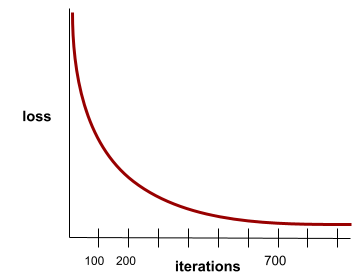

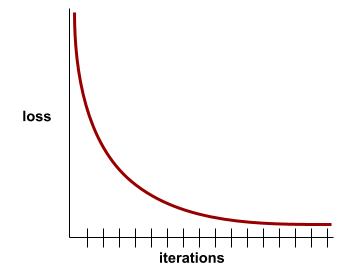

convergencia

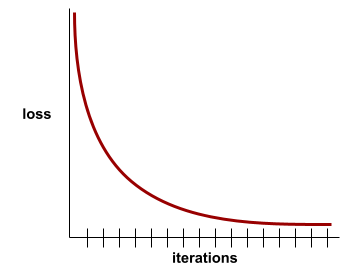

Es un estado que se alcanza cuando los valores de la pérdida cambian muy poco o nada con cada iteración. Por ejemplo, la siguiente curva de pérdida sugiere convergencia alrededor de las 700 iteraciones:

Un modelo converge cuando el entrenamiento adicional no lo mejora.

En el aprendizaje profundo, los valores de pérdida a veces se mantienen constantes o casi constantes durante muchas iteraciones antes de descender finalmente. Durante un período prolongado de valores de pérdida constantes, puede tener temporalmente una falsa sensación de convergencia.

Véase también parada temprana.

Consulte Convergencia del modelo y curvas de pérdida en el Curso intensivo de aprendizaje automático para obtener más información.

Programación conversacional

Es un diálogo iterativo entre tú y un modelo de IA generativa con el propósito de crear software. Emite una instrucción que describe algún software. Luego, el modelo usa esa descripción para generar código. Luego, emites una nueva instrucción para abordar las fallas de la instrucción anterior o del código generado, y el modelo genera código actualizado. Ambos se envían mensajes hasta que el software generado es lo suficientemente bueno.

El codificación de la conversación es, esencialmente, el significado original de vibe coding.

Contrasta con la codificación especificativa .

función convexa

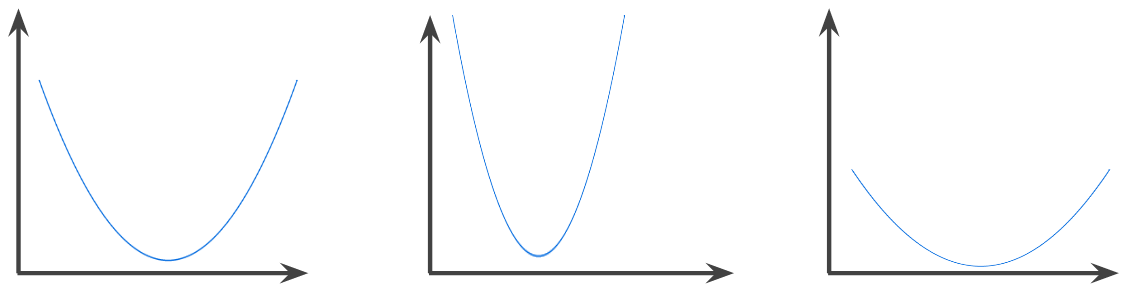

Función en la que la región por encima del gráfico de la función es un conjunto convexo. La función convexa prototípica tiene una forma similar a la letra U. Por ejemplo, las siguientes son todas funciones convexas:

En contraste, la siguiente función no es convexa. Observa cómo la región sobre el gráfico no es un conjunto convexo:

Una función estrictamente convexa tiene exactamente un punto mínimo local, que también es el punto mínimo global. Las funciones clásicas con forma de U son funciones estrictamente convexas. Sin embargo, algunas funciones convexas (por ejemplo, las líneas rectas) no lo son.

Consulta Convergencia y funciones convexas en el Curso intensivo de aprendizaje automático para obtener más información.

optimización convexa

Proceso de uso de técnicas matemáticas, como el descenso de gradientes, para encontrar el mínimo de una función convexa. Gran parte de la investigación sobre el aprendizaje automático se ha centrado en formular distintos problemas como problemas de optimización convexa y en solucionar esas cuestiones de manera más eficaz.

Para obtener más información, consulta Convex Optimization de Boyd y Vandenberghe.

conjunto convexo

Es un subconjunto del espacio euclidiano tal que una línea trazada entre dos puntos cualesquiera del subconjunto permanece completamente dentro de él. Por ejemplo, las siguientes dos formas son conjuntos convexos:

En cambio, las dos figuras siguientes no son conjuntos convexos:

circunvolución

En matemáticas, la convolución es (informalmente) una manera de mezclar dos funciones que mide cuanta superposición hay entre las dos funciones En el aprendizaje automático, una convolución mezcla el filtro convolucional y la matriz de entrada para entrenar pesos.

El término "convolución" en aprendizaje automático es a menudo una forma abreviada de referirse a operación convolucional o capa convolucional.

Sin convoluciones, un algoritmo de aprendizaje automático tendría que aprender un peso separado para cada celda en un tensor grande. Por ejemplo, un algoritmo de aprendizaje automático que se entrena con imágenes de 2,000 x 2,000 se vería obligado a encontrar 4 millones de pesos separados. Gracias a las convoluciones, un algoritmo de aprendizaje automático solo tiene que encontrar pesos para cada celda en el filtro convolucional, lo que reduce drásticamente la memoria necesaria para entrenar el modelo. Cuando se aplica el filtro convolucional, simplemente se replica en las celdas de modo que cada una se multiplique por el filtro.

Consulta Introducción a las redes neuronales convolucionales en el curso de clasificación de imágenes para obtener más información.

filtro convolucional

Uno de los dos actores en una operación convolucional (El otro actor es una porción de una matriz de entrada). Un filtro convolucional es una matriz que tiene el mismo rango que la de entrada, pero una forma más pequeña. Por ejemplo, en una matriz de entrada 28 x 28, el filtro podría ser cualquier matriz 2D más pequeña que 28 x 28.

En la manipulación fotográfica, todas las celdas de un filtro convolucional suelen establecerse en un patrón constante de unos y ceros. En el aprendizaje automático, los filtros convolucionales suelen inicializarse con números aleatorios y, luego, la red entrena los valores ideales.

Consulta Convolución en el curso de Clasificación de imágenes para obtener más información.

capa convolucional

Capa de una red neuronal profunda en la que un filtro convolucional pasa a lo largo de una matriz de entrada. Por ejemplo, considera el siguiente filtro convolucional de 3 x 3:

![Una matriz de 3 x 3 con los siguientes valores: [[0,1,0], [1,0,1], [0,1,0]]](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalFilter33.svg?hl=es)

En la siguiente animación, se muestra una capa convolucional que consta de 9 operaciones convolucionales que involucran la matriz de entrada de 5 x 5. Observa que cada operación convolucional funciona en una porción diferente de 3 x 3 de la matriz de entrada. La matriz resultante de 3 x 3 (a la derecha) consta de los resultados de las 9 operaciones convolucionales:

![Animación que muestra dos matrices. La primera matriz es la matriz de 5 x 5: [[128,97,53,201,198], [35,22,25,200,195], [37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].

La segunda matriz es la matriz de 3 x 3:

[[181,303,618], [115,338,605], [169,351,560]].

La segunda matriz se calcula aplicando el filtro convolucional [[0, 1, 0], [1, 0, 1], [0, 1, 0]] en diferentes subconjuntos de 3 x 3 de la matriz de 5 x 5.](https://developers.google.com/static/machine-learning/glossary/images/AnimatedConvolution.gif?hl=es)

Consulta Capas completamente conectadas en el curso de Clasificación de imágenes para obtener más información.

red neuronal convolucional

Una red neuronal en la que al menos una capa es una capa convolucional. Una red neuronal convolucional típica consta de alguna combinación de las siguientes capas:

Las redes neuronales convolucionales han tenido un gran éxito en ciertos tipos de problemas, como el reconocimiento de imágenes.

operación convolucional

La siguiente operación matemática de dos pasos:

- Multiplicación por elementos del filtro convolucional y una porción de una matriz de entrada (La porción de la matriz de entrada tiene el mismo rango y tamaño que el filtro convolucional).

- Suma de todos los valores en la matriz de producto resultante

Por ejemplo, considere la siguiente matriz de entrada de 5x5:

![La matriz 5x5: [[128,97,53,201,198], [35,22,25,200,195], [37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerInputMatrix.svg?hl=es)

Ahora, imagina el siguiente filtro convolucional de 2 x 2:

![La matriz 2x2: [[1, 0], [0, 1]]](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerFilter.svg?hl=es)

Cada operación convolucional involucra una sola porción de 2 x 2 de la matriz de entrada. Por ejemplo, supongamos que usamos la división de 2 x 2 en la parte superior izquierda de la matriz de entrada. Por lo tanto, la operación de convolución en este segmento se ve de la siguiente manera:

![Aplicación del filtro convolucional [[1, 0], [0, 1]] a la sección superior izquierda de 2 x 2 de la matriz de entrada, que es [[128,97], [35,22]].

El filtro convolucional deja intactos los valores 128 y 22, pero establece en cero los valores 97 y 35. Por lo tanto, la operación de convolución arroja el valor 150 (128 + 22).](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerOperation.svg?hl=es)

Una capa convolucional consiste en una serie de operaciones convolucionales que actúan en porciones diferentes de la matriz de entrada.

costo

Sinónimo de pérdida.

coentrenamiento

Un enfoque de aprendizaje semi-supervisado particularmente útil cuando se cumplen todas las siguientes condiciones:

- La proporción de ejemplos sin etiquetar en comparación con los ejemplos etiquetados en el conjunto de datos es alta.

- Este es un problema de clasificación (binaria o multiclase).

- El dataset contiene dos conjuntos diferentes de variables predictivas que son independientes entre sí y complementarias.

El entrenamiento conjunto amplifica los indicadores independientes para generar un indicador más potente. Por ejemplo, considera un modelo de clasificación que categoriza los autos usados individuales como Buenos o Malos. Un conjunto de atributos predictivos podría enfocarse en características agregadas, como el año, la marca y el modelo del automóvil; otro conjunto de atributos predictivos podría enfocarse en el historial de conducción del propietario anterior y el historial de mantenimiento del automóvil.

El documento fundamental sobre el coentrenamiento es Combining Labeled and Unlabeled Data with Co-Training de Blum y Mitchell.

Equidad contrafáctica

Es una métrica de equidad que verifica si un modelo de clasificación produce el mismo resultado para una persona que para otra idéntica a la primera, excepto en lo que respecta a uno o más atributos sensibles. Evaluar un modelo de clasificación para la equidad contrafáctica es un método para identificar posibles fuentes de sesgo en un modelo.

Consulta cualquiera de los siguientes vínculos para obtener más información:

- Equidad: Equidad contrafáctica en el Curso intensivo de aprendizaje automático.

- When Worlds Collide: Integrating Different Counterfactual Assumptions in Fairness (Cuando los mundos chocan: Integración de diferentes suposiciones contrafácticas en la equidad)

sesgo de cobertura

Consulta sesgo de selección.

crash blossom

Oración o frase con un significado ambiguo. Un crash blossom presenta un problema importante para la comprensión del lenguaje natural. Por ejemplo, el titular La cinta roja que sostiene un rascacielos es un crash blossom porque un modelo CLN podría interpretar el titular en sentido literal o figurado.

crítico

Sinónimo de Red Q profunda.

entropía cruzada

Es una generalización de la pérdida de registro para problemas de clasificación de clases múltiples. La entropía cruzada cuantifica la diferencia entre dos distribuciones de probabilidad. Consulta también perplejidad.

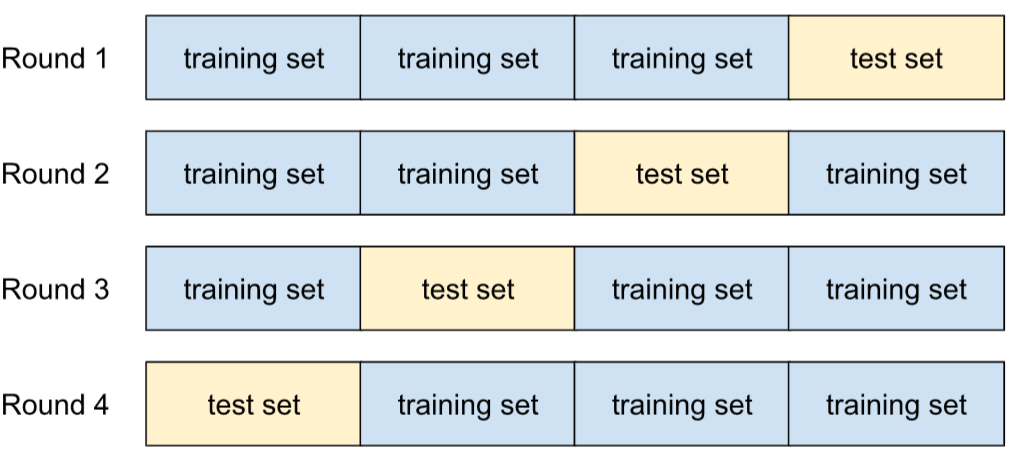

validación cruzada

Mecanismo para estimar qué tan bien un modelo generalizará datos nuevos probando el modelo con uno o más subconjuntos de datos no superpuestos retenidos del conjunto de entrenamiento.

Función de distribución acumulativa (FDA)

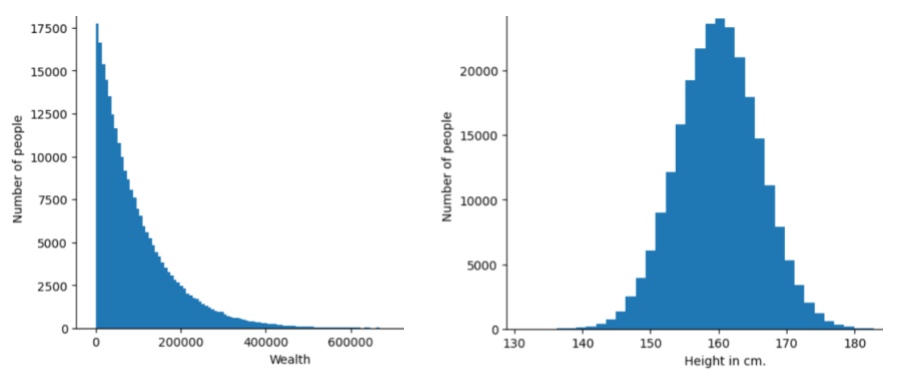

Es una función que define la frecuencia de las muestras menores o iguales que un valor objetivo. Por ejemplo, considera una distribución normal de valores continuos. Una CDF te indica que, aproximadamente, el 50% de las muestras debe ser menor o igual que la media y que, aproximadamente, el 84% de las muestras debe ser menor o igual que una desviación estándar por encima de la media.

D

análisis de datos

El proceso de obtener una comprensión de los datos mediante la consideración de muestras, mediciones y visualizaciones. El análisis de datos puede ser particularmente útil cuando se recibe por primera vez un conjunto de datos, antes de crear el primer modelo. También es crucial para comprender los experimentos y problemas de depuración del sistema.

magnificación de datos

Se incrementa de forma artificial el rango y la cantidad de ejemplos de entrenamiento a través de transformaciones sobre los ejemplos existentes para crear ejemplos adicionales. Por ejemplo, supongamos que uno de tus atributos son las imágenes, pero tu conjunto de datos no contiene suficientes ejemplos de imágenes para que el modelo aprenda asociaciones útiles. Lo ideal sería agregar suficientes imágenes etiquetadas al conjunto de datos para permitir que el modelo se entrene adecuadamente. De no ser posible, la magnificación de datos puede rotar, estirar y reflejar cada imagen para producir muchas variantes de la imagen original, lo que producirá, posiblemente, suficientes datos etiquetados para permitir un excelente entrenamiento.

DataFrame

Tipo de datos popular de Pandas para representar conjuntos de datos en la memoria.

Un DataFrame es análogo a una tabla o una hoja de cálculo. Cada columna de un DataFrame tiene un nombre (un encabezado), y cada fila se identifica mediante un número único.

Cada columna de un DataFrame se estructura como un array bidimensional, excepto que a cada columna se le puede asignar su propio tipo de datos.

Consulta también la página de referencia de pandas.DataFrame oficial.

paralelismo de datos

Es una forma de escalar el entrenamiento o la inferencia que replica un modelo completo en varios dispositivos y, luego, pasa un subconjunto de los datos de entrada a cada dispositivo. El paralelismo de datos puede habilitar el entrenamiento y la inferencia en tamaños de lote muy grandes. Sin embargo, requiere que el modelo sea lo suficientemente pequeño como para caber en todos los dispositivos.

El paralelismo de datos suele acelerar el entrenamiento y la inferencia.

Véase también paralelismo de modelos.

API de Dataset (tf.data)

Una API de TensorFlow de alto nivel para leer datos y transformarlos en un formato que requiere un algoritmo de aprendizaje automático.

Un objeto tf.data.Dataset representa una secuencia de elementos, en la que cada uno de ellos contiene uno o más tensores. Un objeto tf.data.Iterator proporciona acceso a los elementos de un Dataset.

conjunto de datos o conjunto de datos

Es una colección de datos sin procesar, que se suelen organizar (aunque no exclusivamente) en uno de los siguientes formatos:

- una hoja de cálculo

- Un archivo en formato CSV (valores separados por comas)

límite de decisión

El separador entre clases aprendido por un modelo en un problema de clasificación clase binaria o clasificación multiclase. Por ejemplo, en la siguiente imagen que representa un problema de clasificación binaria, el límite de decisión es la frontera entre la clase naranja y la clase azul:

bosque de decisión

Es un modelo creado a partir de varios árboles de decisión. Un bosque de decisión realiza una predicción agregando las predicciones de sus árboles de decisión. Los tipos populares de bosques de decisión incluyen los bosques aleatorios y los árboles potenciados con gradientes.

Consulta la sección Bosques de decisión del curso sobre bosques de decisión para obtener más información.

umbral de decisión

Sinónimo de umbral de clasificación.

árbol de decisión

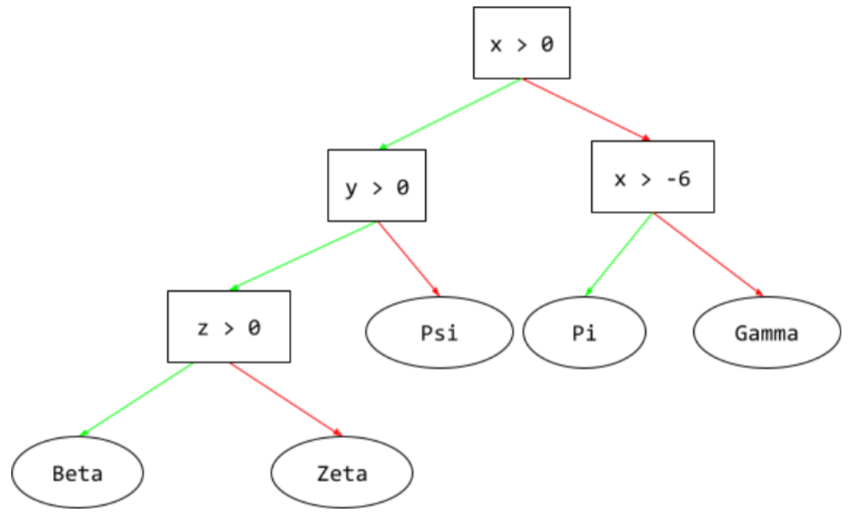

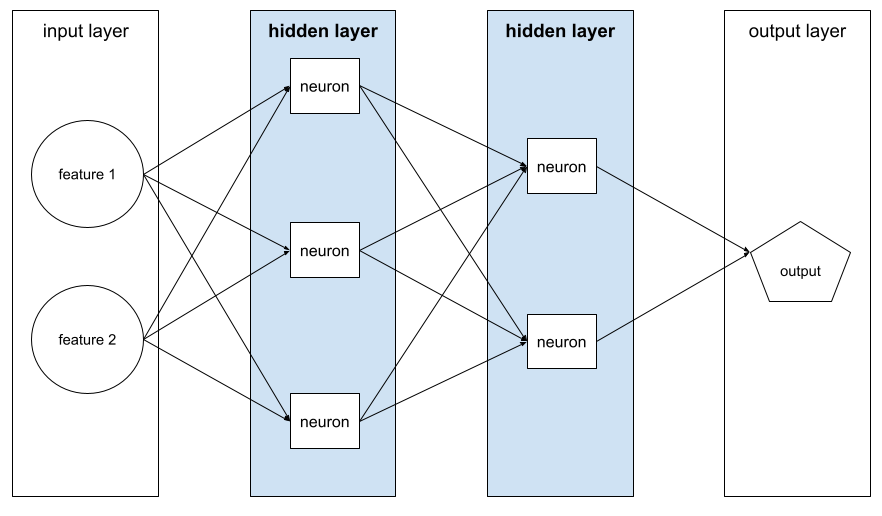

Es un modelo de aprendizaje supervisado compuesto por un conjunto de condiciones y hojas organizadas de forma jerárquica. Por ejemplo, el siguiente es un árbol de decisión:

descifrador

En general, cualquier sistema de AA que convierta una representación interna, densa o procesada en una representación más externa, dispersa o sin procesar.

Los decodificadores suelen ser un componente de un modelo más grande, en el que se combinan con un codificador.

En las tareas de secuencia a secuencia , un decodificador comienza con el estado interno generado por el codificador para predecir la siguiente secuencia.

Consulta Transformer para obtener la definición de un decodificador dentro de la arquitectura de Transformer.

Consulte Modelos de lenguaje grandes en Curso intensivo de aprendizaje automático para obtener más información.

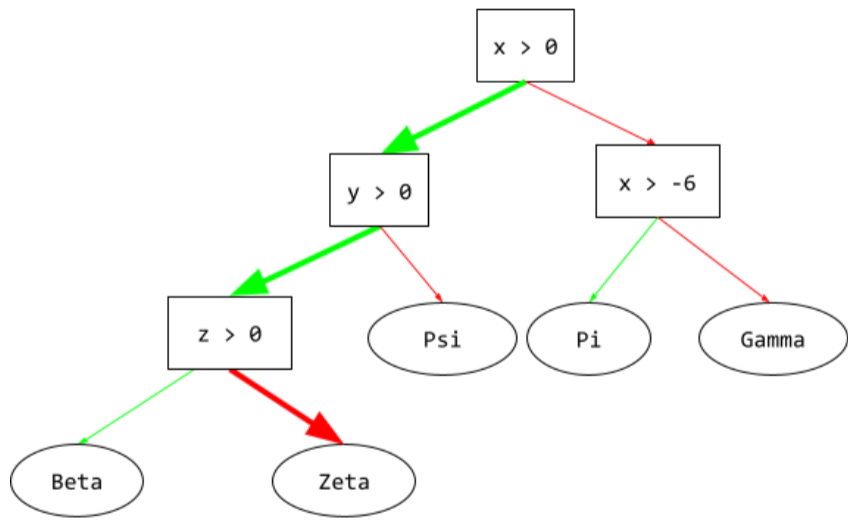

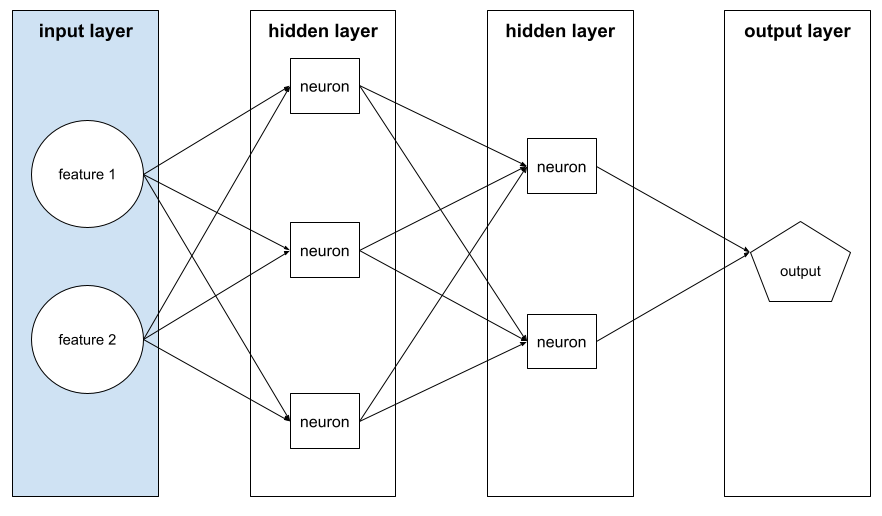

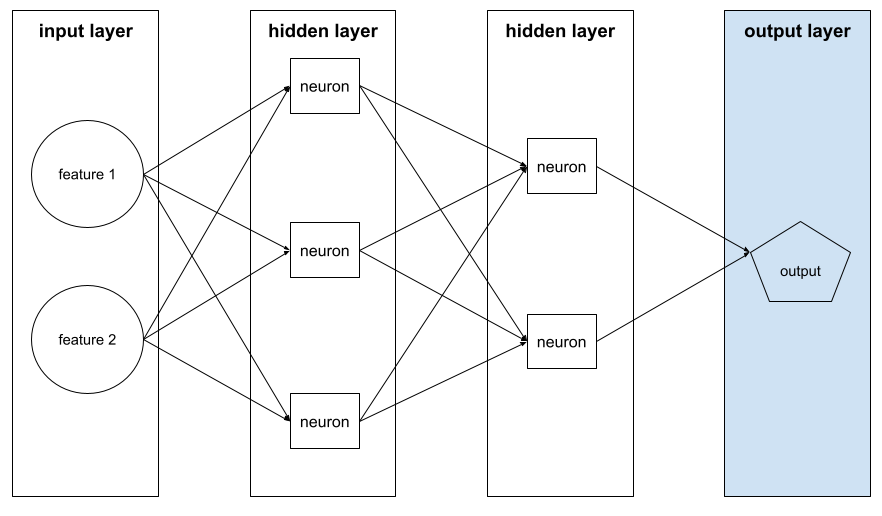

modelo profundo

Una red neuronal que contiene más de una capa oculta.

Un modelo profundo también se denomina red neuronal profunda.

Compara esto con el modelo amplio.

diseño de red neuronal profunda

Sinónimo de modelo profundo.

Red Q profunda (DQN)

En el aprendizaje Q, una red neuronal profunda que predice funciones Q.

Critic es un sinónimo de Deep Q-Network.

Paridad demográfica

Es una métrica de equidad que se cumple si los resultados de la clasificación de un modelo no dependen de un atributo sensible determinado.

Por ejemplo, si tanto los liliputienses como los brobdingnagianos postulan a la Universidad de Glubbdubdrib, se logra la paridad demográfica si el porcentaje de liliputienses admitidos es el mismo que el porcentaje de brobdingnagianos admitidos, independientemente de si un grupo está, en promedio, más calificado que el otro.

Contrasta con la igualdad de probabilidades y la igualdad de oportunidades, que permiten que los resultados de la clasificación en conjunto dependan de atributos sensibles, pero no permiten que los resultados de la clasificación para ciertas etiquetas de verdad fundamental especificadas dependan de atributos sensibles. Consulta "Cómo combatir la discriminación con un aprendizaje automático más inteligente" para ver una visualización que explora las compensaciones cuando se optimiza la paridad demográfica.

Consulta Equidad: paridad demográfica en el Curso intensivo de aprendizaje automático para obtener más información.

Reducción de ruido

Un enfoque común del aprendizaje autosupervisado en el que se hace lo siguiente:

El eliminación de ruido permite el aprendizaje a partir de ejemplos sin etiquetar. El conjunto de datos original sirve como objetivo o etiqueta, y los datos ruidosos como entrada.

Algunos modelos de lenguaje enmascarados usan la eliminación de ruido de la siguiente manera:

- Se agrega ruido de forma artificial a una oración sin etiquetar enmascarando algunos de los tokens.

- El modelo intenta predecir los tokens originales.

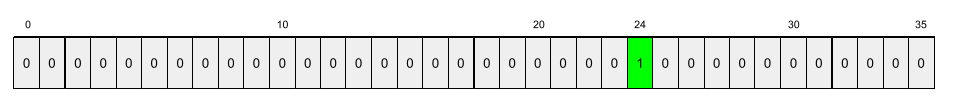

atributo denso

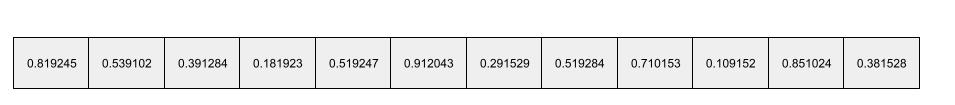

Es una característica en la que la mayoría o todos los valores son distintos de cero, por lo general, un tensor de valores de punto flotante. Por ejemplo, el siguiente tensor de 10 elementos es denso porque 9 de sus valores no son cero:

| 8 | 3 | 7 | 5 | 2 | 4 | 0 | 4 | 9 | 6 |

Compara esto con el atributo disperso.

capa densa

Sinónimo de capa completamente conectada.

depth

La suma de los siguientes elementos en una red neuronal:

- la cantidad de capas ocultas

- La cantidad de capas de salida, que suele ser 1

- el número de capas de incrustación

Por ejemplo, una red neuronal con cinco capas ocultas y una capa de salida tiene una profundidad de 6.

Ten en cuenta que la capa de entrada no influye en la profundidad.

red neuronal convolucional separable en profundidad (sepCNN)

Es una arquitectura de red neuronal convolucional basada en Inception, pero en la que los módulos de Inception se reemplazan por convoluciones separables en profundidad. También se conoce como Xception.

Una convolución separable por profundidad (también abreviada como convolución separable) factoriza una convolución 3D estándar en dos operaciones de convolución separadas que son más eficientes desde el punto de vista computacional: primero, una convolución por profundidad, con una profundidad de 1 (n × n × 1) y, luego, una convolución punto a punto, con una longitud y un ancho de 1 (1 × 1 × n).

Para obtener más información, consulta Xception: Deep Learning with Depthwise Separable Convolutions (Xception: Aprendizaje profundo con convoluciones separables por profundidad).

etiqueta derivada

Sinónimo de etiqueta de proxy.

dispositivo

Término sobrecargado con las siguientes dos definiciones posibles:

- Categoría de hardware que puede ejecutar una sesión de TensorFlow y que incluye CPU, GPU y TPUs.

- Cuando se entrena un modelo de AA en chips aceleradores (GPUs o TPU), es la parte del sistema que realmente manipula los tensores y las incorporaciones. El dispositivo funciona con chips aceleradores. En cambio, el host suele ejecutarse en una CPU.

privacidad diferencial

En el aprendizaje automático, es un enfoque de anonimización para proteger cualquier dato sensible (por ejemplo, la información personal de un individuo) incluido en el conjunto de entrenamiento de un modelo para que no se exponga. Este enfoque garantiza que el modelo no aprenda ni recuerde mucho sobre una persona específica. Esto se logra mediante el muestreo y la adición de ruido durante el entrenamiento del modelo para ocultar los datos individuales, lo que mitiga el riesgo de exponer datos de entrenamiento sensibles.

La privacidad diferencial también se usa fuera del aprendizaje automático. Por ejemplo, los científicos de datos a veces usan la privacidad diferencial para proteger la privacidad individual cuando calculan estadísticas de uso del producto para diferentes datos demográficos.

reducción de dimensiones

Disminución de la cantidad de dimensiones que se usan para representar un atributo particular en un vector de atributos, generalmente mediante la conversión en un vector de incorporación.

dimensiones

Término sobrecargado con alguna de las siguientes definiciones:

Es la cantidad de niveles de coordenadas en un Tensor. Por ejemplo:

- Un escalar tiene cero dimensiones; por ejemplo,

["Hello"]. - Un vector tiene una dimensión; por ejemplo,

[3, 5, 7, 11]. - Una matriz tiene dos dimensiones; por ejemplo,

[[2, 4, 18], [5, 7, 14]]. Se puede especificar de forma única una celda en particular en un vector unidimensional con una coordenada; se necesitan dos coordenadas para especificar de forma única una celda particular en una matriz bidimensional.

- Un escalar tiene cero dimensiones; por ejemplo,

Es la cantidad de entradas en un vector de atributos.

Es la cantidad de elementos en una capa de incorporación.

Instrucción directa

Sinónimo de instrucción sin ejemplos.

característica discreta

Un atributo con un conjunto finito de valores posibles. Por ejemplo, un atributo cuyos valores solo pueden ser animal, vegetal o mineral es un atributo discreto (o categórico).

Compara esto con el atributo continuo.

modelo discriminativo

Un modelo que predice etiquetas a partir de un conjunto de uno o más atributos. Más formalmente, los modelos discriminativos definen la probabilidad condicional de un resultado dados ciertos atributos y pesos, es decir:

p(output | features, weights)

Por ejemplo, un modelo que predice si un correo electrónico es spam a partir de características y ponderaciones es un modelo discriminativo.

La gran mayoría de los modelos de aprendizaje supervisado, incluidos los modelos de clasificación y regresión, son modelos discriminativos.

Contrasta con el modelo generativo .

discriminador

Sistema que determina si los ejemplos son reales o falsos.

De manera alternativa, el subsistema dentro de una red neuronal adversarial generativa que determina si los ejemplos creados por el generador son reales o falsos.

Consulta El discriminador en el curso de las GAN para obtener más información.

Impacto dispar

Tomar decisiones sobre las personas que afectan de manera desproporcionada a diferentes subgrupos de la población Por lo general, se refiere a situaciones en las que un proceso algorítmico de toma de decisiones perjudica o beneficia a algunos subgrupos más que a otros.