注意:這門圖像分類課程已不適用,將於 2025 年 12 月 15 日刪除。

Google uses AI technology to translate content into your preferred language. AI translations can contain errors.

Google uses AI technology to translate content into your preferred language. AI translations can contain errors.

機器學習實務:圖片分類

透過集合功能整理內容

你可以依據偏好儲存及分類內容。

避免過度配適

與任何機器學習模型一樣,訓練卷積神經網路時,主要須注意過度配適問題:模型會根據訓練資料的特定內容進行調整,因此無法推廣至新示例。以下是兩種避免過度擬合 CNN 的做法:

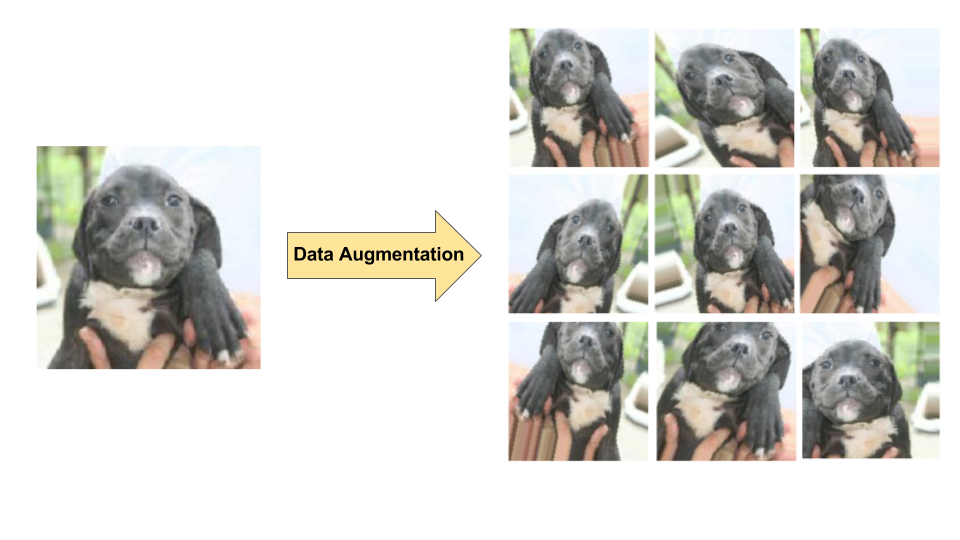

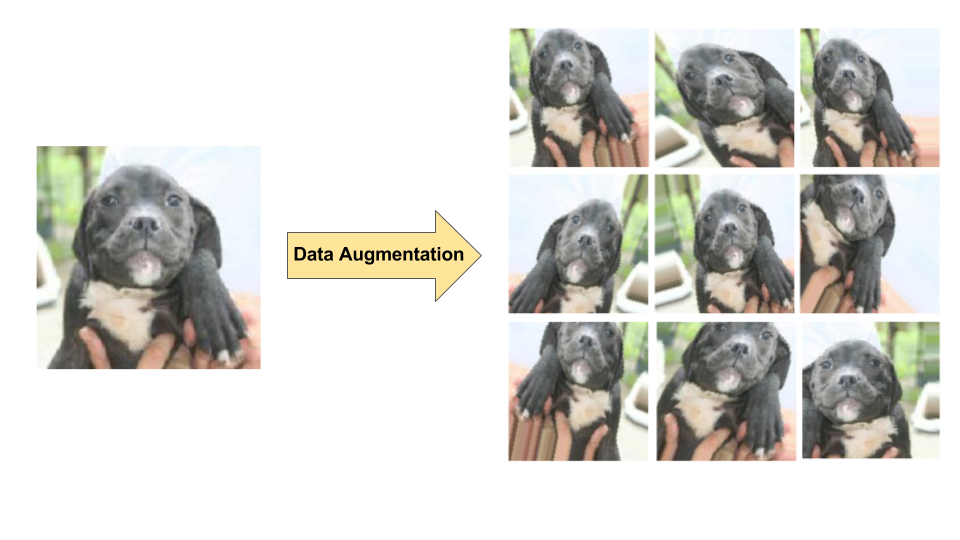

- 資料擴增:對現有圖片執行隨機轉換,藉此人為地增加訓練範例的多樣性和數量,以建立一組新的變化版本 (請見圖 7)。當原始訓練資料集較小時,資料擴增功能就特別實用。

- Dropout 規則:在訓練梯度步驟中隨機移除類神經網路中的單位。

圖 7. 針對單一狗狗圖片進行資料增強 (摘錄自 Kaggle 提供的「Dogs vs. Cats」資料集)。左側:訓練集的原始狗狗圖片。右圖:使用隨機轉換功能,從原始圖片產生九張新圖片。

圖 7. 針對單一狗狗圖片進行資料增強 (摘錄自 Kaggle 提供的「Dogs vs. Cats」資料集)。左側:訓練集的原始狗狗圖片。右圖:使用隨機轉換功能,從原始圖片產生九張新圖片。

除非另有註明,否則本頁面中的內容是採用創用 CC 姓名標示 4.0 授權,程式碼範例則為阿帕契 2.0 授權。詳情請參閱《Google Developers 網站政策》。Java 是 Oracle 和/或其關聯企業的註冊商標。

上次更新時間:2025-01-18 (世界標準時間)。

[[["容易理解","easyToUnderstand","thumb-up"],["確實解決了我的問題","solvedMyProblem","thumb-up"],["其他","otherUp","thumb-up"]],[["缺少我需要的資訊","missingTheInformationINeed","thumb-down"],["過於複雜/步驟過多","tooComplicatedTooManySteps","thumb-down"],["過時","outOfDate","thumb-down"],["翻譯問題","translationIssue","thumb-down"],["示例/程式碼問題","samplesCodeIssue","thumb-down"],["其他","otherDown","thumb-down"]],["上次更新時間:2025-01-18 (世界標準時間)。"],[],[]]

圖 7. 針對單一狗狗圖片進行資料增強 (摘錄自 Kaggle 提供的「Dogs vs. Cats」資料集)。左側:訓練集的原始狗狗圖片。右圖:使用隨機轉換功能,從原始圖片產生九張新圖片。

圖 7. 針對單一狗狗圖片進行資料增強 (摘錄自 Kaggle 提供的「Dogs vs. Cats」資料集)。左側:訓練集的原始狗狗圖片。右圖:使用隨機轉換功能,從原始圖片產生九張新圖片。