Android SDK की मदद से, Glass EE2 में उपलब्ध अलग-अलग इनपुट और सेंसर को ऐक्सेस किया जा सकता है. इस पेज पर, उपलब्ध सुविधाओं, उन्हें लागू करने के बारे में जानकारी, और काम की सलाह दी गई है.

टच जेस्चर

Android SDK का इस्तेमाल करके, Glass के टचपैड से मिले रॉ डेटा को ऐक्सेस किया जा सकता है. यह काम, जेस्चर डिटेक्टर की मदद से किया जाता है. यह Glass पर किए जाने वाले सामान्य जेस्चर का अपने-आप पता लगाता है. जैसे, टैप करना, फ़्लिंग करना, और स्क्रोल करना.

अपने ऐप्लिकेशन में इस जेस्चर डिटेक्टर का इस्तेमाल करके, टैप करने, आगे की ओर स्वाइप करने, पीछे की ओर स्वाइप करने, और नीचे की ओर स्वाइप करने की सुविधा को शामिल किया जा सकता है. यह पिछले Glass डिवाइसों की तरह ही है.

इन जेस्चर का इस्तेमाल इन तरीकों से करना सबसे अच्छा होता है:

- टैप करें: पुष्टि करें या डालें.

- आगे की ओर स्वाइप करें, पीछे की ओर स्वाइप करें: कार्ड और स्क्रीन के बीच नेविगेट करें.

- नीचे की ओर स्वाइप करें: वापस जाएं या बाहर निकलें.

लागू करने से जुड़ी जानकारी के लिए, जेस्चर डिटेक्टर का सैंपल पढ़ें.

Android के जेस्चर डिटेक्टर की मदद से जेस्चर का पता लगाना

Android GestureDetector की मदद से, आसान और मुश्किल जेस्चर का पता लगाया जा सकता है. जैसे, एक से ज़्यादा उंगलियों का इस्तेमाल करके किए जाने वाले जेस्चर या स्क्रोलिंग.

गतिविधि के लेवल पर जेस्चर का पता लगाना

ऐक्टिविटी लेवल पर जेस्चर का पता सिर्फ़ तब लगाएं, जब इससे कोई फ़र्क़ न पड़े कि आपके यूज़र इंटरफ़ेस (यूआई) के किस हिस्से पर फ़ोकस है.

उदाहरण के लिए, अगर आपको उपयोगकर्ता के टचपैड पर टैप करने पर मेन्यू दिखाना है, तो इस बात से कोई फ़र्क़ नहीं पड़ता कि किस व्यू पर फ़ोकस है. इसके लिए, ऐक्टिविटी में MotionEvent को हैंडल करें.

यहां गतिविधि के लेवल पर जेस्चर का पता लगाने का एक उदाहरण दिया गया है. इसमें

GestureDetector का इस्तेमाल किया जाता है और पहचाने गए जेस्चर को प्रोसेस करने के लिए

GestureDetector.OnGestureListener को लागू किया जाता है. इसके बाद, इन्हें मैनेज किया जाता है और इस तरह से ट्रांसलेट किया जाता है:

TAPSWIPE_FORWARDSWIPE_BACKWARDSWIPE_UPSWIPE_DOWN

Kotlin

class GlassGestureDetector(context: Context, private val onGestureListener: OnGestureListener) : GestureDetector.OnGestureListener { private val gestureDetector = GestureDetector(context, this) enum class Gesture { TAP, SWIPE_FORWARD, SWIPE_BACKWARD, SWIPE_UP, SWIPE_DOWN } interface OnGestureListener { fun onGesture(gesture: Gesture): Boolean } fun onTouchEvent(motionEvent: MotionEvent): Boolean { return gestureDetector.onTouchEvent(motionEvent) } override fun onDown(e: MotionEvent): Boolean { return false } override fun onShowPress(e: MotionEvent) {} override fun onSingleTapUp(e: MotionEvent): Boolean { return onGestureListener.onGesture(Gesture.TAP) } override fun onScroll( e1: MotionEvent, e2: MotionEvent, distanceX: Float, distanceY: Float ): Boolean { return false } override fun onLongPress(e: MotionEvent) {} /** * Swipe detection depends on the: * - movement tan value, * - movement distance, * - movement velocity. * * To prevent unintentional SWIPE_DOWN and SWIPE_UP gestures, they are detected if movement * angle is only between 60 and 120 degrees. * Any other detected swipes, will be considered as SWIPE_FORWARD and SWIPE_BACKWARD, depends * on deltaX value sign. * * ______________________________________________________________ * | \ UP / | * | \ / | * | 60 120 | * | \ / | * | \ / | * | BACKWARD <------- 0 ------------ 180 ------> FORWARD | * | / \ | * | / \ | * | 60 120 | * | / \ | * | / DOWN \ | * -------------------------------------------------------------- */ override fun onFling( e1: MotionEvent, e2: MotionEvent, velocityX: Float, velocityY: Float ): Boolean { val deltaX = e2.x - e1.x val deltaY = e2.y - e1.y val tan = if (deltaX != 0f) abs(deltaY / deltaX).toDouble() else java.lang.Double.MAX_VALUE return if (tan > TAN_60_DEGREES) { if (abs(deltaY) < SWIPE_DISTANCE_THRESHOLD_PX || Math.abs(velocityY) < SWIPE_VELOCITY_THRESHOLD_PX) { false } else if (deltaY < 0) { onGestureListener.onGesture(Gesture.SWIPE_UP) } else { onGestureListener.onGesture(Gesture.SWIPE_DOWN) } } else { if (Math.abs(deltaX) < SWIPE_DISTANCE_THRESHOLD_PX || Math.abs(velocityX) < SWIPE_VELOCITY_THRESHOLD_PX) { false } else if (deltaX < 0) { onGestureListener.onGesture(Gesture.SWIPE_FORWARD) } else { onGestureListener.onGesture(Gesture.SWIPE_BACKWARD) } } } companion object { private const val SWIPE_DISTANCE_THRESHOLD_PX = 100 private const val SWIPE_VELOCITY_THRESHOLD_PX = 100 private val TAN_60_DEGREES = tan(Math.toRadians(60.0)) } }

Java

public class GlassGestureDetector implements GestureDetector.OnGestureListener { enum Gesture { TAP, SWIPE_FORWARD, SWIPE_BACKWARD, SWIPE_UP, SWIPE_DOWN, } interface OnGestureListener { boolean onGesture(Gesture gesture); } private static final int SWIPE_DISTANCE_THRESHOLD_PX = 100; private static final int SWIPE_VELOCITY_THRESHOLD_PX = 100; private static final double TAN_60_DEGREES = Math.tan(Math.toRadians(60)); private GestureDetector gestureDetector; private OnGestureListener onGestureListener; public GlassGestureDetector(Context context, OnGestureListener onGestureListener) { gestureDetector = new GestureDetector(context, this); this.onGestureListener = onGestureListener; } public boolean onTouchEvent(MotionEvent motionEvent) { return gestureDetector.onTouchEvent(motionEvent); } @Override public boolean onDown(MotionEvent e) { return false; } @Override public void onShowPress(MotionEvent e) { } @Override public boolean onSingleTapUp(MotionEvent e) { return onGestureListener.onGesture(Gesture.TAP); } @Override public boolean onScroll(MotionEvent e1, MotionEvent e2, float distanceX, float distanceY) { return false; } @Override public void onLongPress(MotionEvent e) { } /** * Swipe detection depends on the: * - movement tan value, * - movement distance, * - movement velocity. * * To prevent unintentional SWIPE_DOWN and SWIPE_UP gestures, they are detected if movement * angle is only between 60 and 120 degrees. * Any other detected swipes, will be considered as SWIPE_FORWARD and SWIPE_BACKWARD, depends * on deltaX value sign. * * ______________________________________________________________ * | \ UP / | * | \ / | * | 60 120 | * | \ / | * | \ / | * | BACKWARD <------- 0 ------------ 180 ------> FORWARD | * | / \ | * | / \ | * | 60 120 | * | / \ | * | / DOWN \ | * -------------------------------------------------------------- */ @Override public boolean onFling(MotionEvent e1, MotionEvent e2, float velocityX, float velocityY) { final float deltaX = e2.getX() - e1.getX(); final float deltaY = e2.getY() - e1.getY(); final double tan = deltaX != 0 ? Math.abs(deltaY/deltaX) : Double.MAX_VALUE; if (tan > TAN_60_DEGREES) { if (Math.abs(deltaY) < SWIPE_DISTANCE_THRESHOLD_PX || Math.abs(velocityY) < SWIPE_VELOCITY_THRESHOLD_PX) { return false; } else if (deltaY < 0) { return onGestureListener.onGesture(Gesture.SWIPE_UP); } else { return onGestureListener.onGesture(Gesture.SWIPE_DOWN); } } else { if (Math.abs(deltaX) < SWIPE_DISTANCE_THRESHOLD_PX || Math.abs(velocityX) < SWIPE_VELOCITY_THRESHOLD_PX) { return false; } else if (deltaX < 0) { return onGestureListener.onGesture(Gesture.SWIPE_FORWARD); } else { return onGestureListener.onGesture(Gesture.SWIPE_BACKWARD); } } } }

इस्तेमाल के उदाहरण

गतिविधि के हिसाब से जेस्चर का पता लगाने की सुविधा का इस्तेमाल करने के लिए, आपको ये टास्क पूरे करने होंगे:

- ऐप्लिकेशन के बारे में जानकारी देने वाले सेक्शन में, अपनी मेनिफ़ेस्ट फ़ाइल में यह एलान जोड़ें. इससे आपका ऐप्लिकेशन, गतिविधि में

MotionEventको पा सकता है:<application> <!-- Copy below declaration into your manifest file --> <meta-data android:name="com.google.android.glass.TouchEnabledApplication" android:value="true" /> </application>

- गतिविधि के

dispatchTouchEvent(motionEvent)तरीके को बदलकर, मोशन इवेंट को जेस्चर डिटेक्टर केonTouchEvent(motionEvent)तरीके पर पास करें. - अपनी गतिविधि में

GlassGestureDetector.OnGestureListenerको लागू करें.

यहां गतिविधि-लेवल के जेस्चर डिटेक्टर का एक उदाहरण दिया गया है:

Kotlin

class MainAcvitiy : AppCompatActivity(), GlassGestureDetector.OnGestureListener { private lateinit var glassGestureDetector: GlassGestureDetector override fun onCreate(savedInstanceState: Bundle?) { super.onCreate(savedInstanceState) setContentView(R.layout.activity_main) glassGestureDetector = GlassGestureDetector(this, this) } override fun onGesture(gesture: GlassGestureDetector.Gesture): Boolean { when (gesture) { TAP -> // Response for TAP gesture return true SWIPE_FORWARD -> // Response for SWIPE_FORWARD gesture return true SWIPE_BACKWARD -> // Response for SWIPE_BACKWARD gesture return true else -> return false } } override fun dispatchTouchEvent(ev: MotionEvent): Boolean { return if (glassGestureDetector.onTouchEvent(ev)) { true } else super.dispatchTouchEvent(ev) } }

Java

public class MainActivity extends AppCompatActivity implements OnGestureListener { private GlassGestureDetector glassGestureDetector; @Override protected void onCreate(Bundle savedInstanceState) { super.onCreate(savedInstanceState); setContentView(R.layout.activity_main); glassGestureDetector = new GlassGestureDetector(this, this); } @Override public boolean onGesture(Gesture gesture) { switch (gesture) { case TAP: // Response for TAP gesture return true; case SWIPE_FORWARD: // Response for SWIPE_FORWARD gesture return true; case SWIPE_BACKWARD: // Response for SWIPE_BACKWARD gesture return true; default: return false; } } @Override public boolean dispatchTouchEvent(MotionEvent ev) { if (glassGestureDetector.onTouchEvent(ev)) { return true; } return super.dispatchTouchEvent(ev); } }

ऑडियो इनपुट

Glass Enterprise Edition 2, स्टैंडर्ड AOSP पर आधारित डिवाइस है. यह बुनियादी ऑडियो सोर्स के साथ काम करता है.

इन ऑडियो सोर्स में, बेहतर सिग्नल प्रोसेसिंग की सुविधा लागू की गई है:

आवाज़ पहचानने की सुविधा

Glass Enterprise Edition 2 में, बोली पहचानने की सुविधा पहले से मौजूद होती है. यह सुविधा सिर्फ़ अंग्रेज़ी भाषा के लिए उपलब्ध है.

आवाज़ को पहचानने वाला यूज़र इंटरफ़ेस (यूआई), उपयोगकर्ता के बोलने का इंतज़ार करता है. इसके बाद, जब उपयोगकर्ता बोल लेता है, तो यह यूआई, बोली को लिखाई में बदले गए टेक्स्ट को दिखाता है. गतिविधि शुरू करने के लिए, यह तरीका अपनाएं:

ACTION_RECOGNIZE_SPEECHइंटेंट के साथstartActivityForResult()कॉल करें. गतिविधि शुरू करते समय, ये इंटेंट एक्स्ट्रा इस्तेमाल किए जा सकते हैं:onActivityResult()कॉलबैक को बदलें, ताकि आपकोEXTRA_RESULTSइंटेंट एक्स्ट्रा से ट्रांसक्राइब किया गया टेक्स्ट मिल सके. इसके लिए, यहां दिए गए कोड का इस्तेमाल करें. जब उपयोगकर्ता बोलना बंद कर देता है, तब इस कॉलबैक को कॉल किया जाता है.

Kotlin

private const val SPEECH_REQUEST = 109 private fun displaySpeechRecognizer() { val intent = Intent(RecognizerIntent.ACTION_RECOGNIZE_SPEECH) startActivityForResult(intent, SPEECH_REQUEST) } override fun onActivityResult(requestCode: Int, resultCode: Int, data: Intent) { if (requestCode == SPEECH_REQUEST && resultCode == RESULT_OK) { val results: List<String>? = data.getStringArrayListExtra(RecognizerIntent.EXTRA_RESULTS) val spokenText = results?.get(0) // Do something with spokenText. } super.onActivityResult(requestCode, resultCode, data) }

Java

private static final int SPEECH_REQUEST = 109; private void displaySpeechRecognizer() { Intent intent = new Intent(RecognizerIntent.ACTION_RECOGNIZE_SPEECH); startActivityForResult(intent, SPEECH_REQUEST); } @Override protected void onActivityResult(int requestCode, int resultCode, Intent data) { if (requestCode == SPEECH_REQUEST && resultCode == RESULT_OK) { List<String> results = data.getStringArrayListExtra( RecognizerIntent.EXTRA_RESULTS); String spokenText = results.get(0); // Do something with spokenText. } super.onActivityResult(requestCode, resultCode, data); }

लागू करने से जुड़ी जानकारी के लिए, आवाज़ पहचानने वाले ऐप्लिकेशन का उदाहरण पढ़ें.

कीवर्ड के हिसाब से पक्षपात करना

Glass पर आवाज़ पहचानने की सुविधा, कीवर्ड की सूची के लिए पक्षपाती हो सकती है. बायसिंग से, कीवर्ड पहचानने की सुविधा की सटीकता बढ़ती है. कीवर्ड के लिए बाइसिंग की सुविधा चालू करने के लिए, इनका इस्तेमाल करें:

Kotlin

val keywords = arrayOf("Example", "Biasing", "Keywords") val intent = Intent(RecognizerIntent.ACTION_RECOGNIZE_SPEECH) intent.putExtra("recognition-phrases", keywords) startActivityForResult(intent, SPEECH_REQUEST)

Java

final String[] keywords = {"Example", "Biasing", "Keywords"}; Intent intent = new Intent(RecognizerIntent.ACTION_RECOGNIZE_SPEECH); intent.putExtra("recognition-phrases", keywords); startActivityForResult(intent, SPEECH_REQUEST);

बोलकर दिए जाने वाले निर्देश

आवाज़ से दिए जाने वाले निर्देशों की मदद से, उपयोगकर्ता ऐक्टिविटी से जुड़ी कार्रवाइयां कर सकते हैं. Android के स्टैंडर्ड मेन्यू एपीआई की मदद से, आवाज़ से कंट्रोल होने वाली कमांड बनाई जाती हैं. हालांकि, उपयोगकर्ता मेन्यू आइटम को छूने के बजाय, आवाज़ से कंट्रोल होने वाली कमांड से चालू कर सकते हैं.

किसी गतिविधि के लिए, बोलकर दिए जाने वाले निर्देशों की सुविधा चालू करने के लिए, यह तरीका अपनाएं:

- बोलकर निर्देश देने की सुविधा चालू करने के लिए, अपनी पसंद की गतिविधि में

getWindow().requestFeature(FEATURE_VOICE_COMMANDS)को कॉल करें. इस सुविधा के चालू होने पर, जब भी इस गतिविधि पर फ़ोकस किया जाता है, तब स्क्रीन के सबसे नीचे बाएं कोने में माइक्रोफ़ोन आइकॉन दिखता है. - अपने ऐप्लिकेशन में

RECORD_AUDIOकी अनुमति का अनुरोध करें. - ओवरराइड करें

onCreatePanelMenu()और मेन्यू रिसॉर्स को बड़ा करें. - पहचाने गए बोले गए निर्देशों को हैंडल करने के लिए,

onContextItemSelected()को बदलें.

Kotlin

class VoiceCommandsActivity : AppCompatActivity() { companion object { const val FEATURE_VOICE_COMMANDS = 14 const val REQUEST_PERMISSION_CODE = 200 val PERMISSIONS = arrayOf(Manifest.permission.RECORD_AUDIO) val TAG = VoiceCommandsActivity::class.java.simpleName } override fun onCreate(savedInstanceState: Bundle?) { super.onCreate(savedInstanceState) window.requestFeature(FEATURE_VOICE_COMMANDS) setContentView(R.layout.activity_voice_commands) // Requesting permissions to enable voice commands menu ActivityCompat.requestPermissions( this, PERMISSIONS, REQUEST_PERMISSION_CODE ) } override fun onRequestPermissionsResult( requestCode: Int, permissions: Array<out String>, grantResults: IntArray ) { if (requestCode == REQUEST_PERMISSION_CODE) { for (result in grantResults) { if (result != PackageManager.PERMISSION_GRANTED) { Log.d(TAG, "Permission denied. Voice commands menu is disabled.") } } } else { super.onRequestPermissionsResult(requestCode, permissions, grantResults) } } override fun onCreatePanelMenu(featureId: Int, menu: Menu): Boolean { menuInflater.inflate(R.menu.voice_commands_menu, menu) return true } override fun onContextItemSelected(item: MenuItem): Boolean { return when (item.itemId) { // Handle selected menu item R.id.edit -> { // Handle edit action true } else -> super.onContextItemSelected(item) } } }

Java

public class VoiceCommandsActivity extends AppCompatActivity { private static final String TAG = VoiceCommandsActivity.class.getSimpleName(); private static final int FEATURE_VOICE_COMMANDS = 14; private static final int REQUEST_PERMISSION_CODE = 200; private static final String[] PERMISSIONS = new String[]{Manifest.permission.RECORD_AUDIO}; @Override protected void onCreate(@Nullable Bundle savedInstanceState) { super.onCreate(savedInstanceState); getWindow().requestFeature(FEATURE_VOICE_COMMANDS); setContentView(R.layout.activity_voice_commands); // Requesting permissions to enable voice commands menu ActivityCompat.requestPermissions(this, PERMISSIONS, REQUEST_PERMISSION_CODE); } @Override public void onRequestPermissionsResult(int requestCode, @NonNull String[] permissions, @NonNull int[] grantResults) { if (requestCode == REQUEST_PERMISSION_CODE) { for (int result : grantResults) { if (result != PackageManager.PERMISSION_GRANTED) { Log.d(TAG, "Permission denied. Voice commands menu is disabled."); } } } else { super.onRequestPermissionsResult(requestCode, permissions, grantResults); } } @Override public boolean onCreatePanelMenu(int featureId, @NonNull Menu menu) { getMenuInflater().inflate(R.menu.voice_commands_menu, menu); return true; } @Override public boolean onContextItemSelected(@NonNull MenuItem item) { switch (item.getItemId()) { // Handle selected menu item case R.id.edit: // Handle edit action return true; default: return super.onContextItemSelected(item); } } }

यहां पिछली गतिविधि में इस्तेमाल की गई मेन्यू रिसॉर्स का उदाहरण दिया गया है:

<?xml version="1.0" encoding="utf-8"?> <menu xmlns:android="http://schemas.android.com/apk/res/android"> <item android:id="@+id/delete" android:icon="@drawable/ic_delete" android:title="@string/delete"/> <item android:id="@+id/edit" android:icon="@drawable/ic_edit" android:title="@string/edit"/> <item android:id="@+id/find" android:icon="@drawable/ic_search" android:title="@string/find"/> </menu>

पूरे उदाहरण के लिए, नोट लेने वाले ऐप्लिकेशन का सैंपल पढ़ें.

बोलकर दिए जाने वाले निर्देशों की सूची फिर से लोड हो रही है

बोलकर दिए जाने वाले निर्देशों की सूची को डाइनैमिक तरीके से फिर से लोड किया जा सकता है. इसके लिए, onCreatePanelMenu() तरीके में menu संसाधन बदलें या onPreparePanel() तरीके में मेन्यू ऑब्जेक्ट में बदलाव करें. बदलाव लागू करने के लिए, invalidateOptionsMenu() तरीके का इस्तेमाल करें.

Kotlin

private val options = mutableListOf<String>() fun onPreparePanel(featureId: Int, view: View?, menu: Menu): Boolean { if (featureId != FEATURE_VOICE_COMMANDS) { return super.onCreatePanelMenu(featureId, menu) } for (optionTitle in options) { menu.add(optionTitle) } return true } /** * Method showing example implementation of voice command list modification * * If you call [Activity.invalidateOptionsMenu] method, voice command list will be * reloaded (onCreatePanelMenu and onPreparePanel methods will be called). */ private fun modifyVoiceCommandList() { options.add("Delete") options.add("Play") options.add("Pause") invalidateOptionsMenu() }

Java

private final List<String> options = new ArrayList<>(); @Override public boolean onPreparePanel(int featureId, View view, Menu menu) { if (featureId != FEATURE_VOICE_COMMANDS) { return super.onCreatePanelMenu(featureId, menu); } for (String optionTitle : options) { menu.add(optionTitle); } return true; } /** * Method showing example implementation of voice command list modification * * If you call {@link Activity#invalidateOptionsMenu()} method, voice command list will be * reloaded (onCreatePanelMenu and onPreparePanel methods will be called). */ private void modifyVoiceCommandList() { options.add("Delete"); options.add("Play"); options.add("Pause"); invalidateOptionsMenu(); }

AppCompatActivity समाधान

AppCompatActivity को बढ़ाने वाली किसी गतिविधि में, बोले जाने वाले निर्देश की सूची को फिर से लोड करने के लिए, reload-voice-commands इंटेंट ऐक्शन के साथ sendBroadcast() तरीके का इस्तेमाल करें:

Kotlin

sendBroadcast(Intent("reload-voice-commands"))

Java

sendBroadcast(new Intent("reload-voice-commands"));

रनटाइम में बोलकर निर्देश देने की सुविधा चालू और बंद करना

आपके पास रनटाइम के दौरान, बोलकर निर्देश देने की सुविधा को चालू और बंद करने का विकल्प होता है. इसके लिए, onCreatePanelMenu() तरीके से सही वैल्यू इस तरह से दिखाएं:

- चालू करने के लिए, वैल्यू को

trueपर सेट करें. - बंद करने के लिए, वैल्यू को

falseपर सेट करें.

डीबग मोड

बोलकर दिए जाने वाले निर्देशों के लिए डीबग मोड चालू करने के लिए, अपनी पसंद की गतिविधि में getWindow().requestFeature(FEATURE_DEBUG_VOICE_COMMANDS) को कॉल करें. डीबग मोड चालू करने पर, ये सुविधाएं काम करती हैं:

- Logcat में, डीबग करने के लिए पहचाने गए वाक्यांश का लॉग शामिल होता है.

- जब किसी ऐसी कमांड का पता चलता है जिसे पहचाना नहीं जा सकता, तब यूज़र इंटरफ़ेस (यूआई) ओवरले दिखता है. इसे यहां दिखाया गया है:

Kotlin

class VoiceCommandsActivity : AppCompatActivity() { companion object { const val FEATURE_VOICE_COMMANDS = 14 const val FEATURE_DEBUG_VOICE_COMMANDS = 15 const val REQUEST_PERMISSION_CODE = 200 val PERMISSIONS = arrayOf(Manifest.permission.RECORD_AUDIO) val TAG = VoiceCommandsActivity::class.java.simpleName } override fun onCreate(savedInstanceState: Bundle?) { super.onCreate(savedInstanceState) window.requestFeature(FEATURE_VOICE_COMMANDS) window.requestFeature(FEATURE_DEBUG_VOICE_COMMANDS) setContentView(R.layout.activity_voice_commands) // Requesting permissions to enable voice commands menu ActivityCompat.requestPermissions( this, PERMISSIONS, REQUEST_PERMISSION_CODE ) } . . . }

Java

public class VoiceCommandsActivity extends AppCompatActivity { private static final String TAG = VoiceCommandsActivity.class.getSimpleName(); private static final int FEATURE_VOICE_COMMANDS = 14; private static final int FEATURE_DEBUG_VOICE_COMMANDS = 15; private static final int REQUEST_PERMISSION_CODE = 200; private static final String[] PERMISSIONS = new String[]{Manifest.permission.RECORD_AUDIO}; @Override protected void onCreate(@Nullable Bundle savedInstanceState) { super.onCreate(savedInstanceState); getWindow().requestFeature(FEATURE_VOICE_COMMANDS); getWindow().requestFeature(FEATURE_DEBUG_VOICE_COMMANDS); setContentView(R.layout.activity_voice_commands); // Requesting permissions to enable voice commands menu ActivityCompat.requestPermissions(this, PERMISSIONS, REQUEST_PERMISSION_CODE); } . . . }

लागू करने के बारे में ज़्यादा जानकारी के लिए, आवाज़ से दिए जाने वाले निर्देशों के आधार पर ऐप्लिकेशन को फिर से लोड करने का उदाहरण पढ़ें.

लिखे गए शब्दों को सुनने की सुविधा (टीटीएस)

लिखे गए शब्दों को सुनने की सुविधा, डिजिटल टेक्स्ट को सिंथेसाइज़ किए गए स्पीच आउटपुट में बदलती है. ज़्यादा जानकारी के लिए, Android Developers Documentation TextToSpeech पर जाएं.

Glass EE2 में, Google की लिखाई को बोली में बदलने की सुविधा वाला इंजन इंस्टॉल होता है. इसे डिफ़ॉल्ट टीटीएस इंजन के तौर पर सेट किया जाता है और यह ऑफ़लाइन काम करता है.

Google के टेक्स्ट को ऑडियो में बदलने वाले इंजन के साथ ये भाषाएं बंडल की गई हैं:

|

बंगाली मंदारिन चीनी चेक डैनिश जर्मन ग्रीक अंग्रेज़ी स्पैनिश एस्टोनियन फ़िनिश फ़्रेंच गुजराती हिंदी |

हंगेरियन इंडोनेशियन इटैलियन जैपनीज़ जावानीज़ ऑस्ट्रोनेशियन ऑस्ट्रोएशियाटिक कन्नड़ कोरियन मलयालम नॉर्वेजियन डच |

पोलिश पुर्तगाली रूसी स्लोवाक सुंडानी स्वीडिश तमिल तेलुगु थाई तुर्क़िश यूक्रेनियन वियतनामी |

कैमरा

Glass Enterprise Edition 2 में आठ मेगापिक्सल का फ़िक्स्ड-फ़ोकस कैमरा है. इसमें f/2.4 एपर्चर, 4:3 सेंसर आसपेक्ट रेशियो (लंबाई-चौड़ाई का अनुपात), और 83° डायगोनल फ़ील्ड ऑफ़ व्यू (लैंडस्केप ओरिएंटेशन में 71° x 57°) है. हमारा सुझाव है कि आप स्टैंडर्ड CameraX या Camera2 API का इस्तेमाल करें.

लागू करने से जुड़ी जानकारी के लिए, कैमरा ऐप्लिकेशन का सैंपल पढ़ें.

कैमरा बटन

कैमरा बटन, Glass Enterprise Edition 2 डिवाइस के हिंज पर मौजूद फ़िज़िकल बटन होता है.

इसे स्टैंडर्ड कीबोर्ड ऐक्शन की तरह हैंडल किया जा सकता है. साथ ही, इसे

KeyEvent#KEYCODE_CAMERA कीकोड से पहचाना जा सकता है.

OPM1.200313.001 ओएस अपडेट के बाद, लॉन्चर ऐप्लिकेशन से इन कार्रवाइयों वाले इंटेंट भेजे जाते हैं:

MediaStore#ACTION_IMAGE_CAPTUREकैमरा बटन को कम समय के लिए दबाएं.MediaStore#ACTION_VIDEO_CAPTUREकैमरा बटन को दबाकर रखें.

सेंसर

Glass EE2 में ऐप्लिकेशन डेवलप करते समय, डेवलपर के लिए कई तरह के सेंसर उपलब्ध होते हैं.

Glass पर, Android के इन स्टैंडर्ड सेंसर का इस्तेमाल किया जा सकता है:

-

TYPE_ACCELEROMETER -

TYPE_GRAVITY -

TYPE_GYROSCOPE -

TYPE_LIGHT -

TYPE_LINEAR_ACCELERATION -

TYPE_MAGNETIC_FIELD -

TYPE_ORIENTATION(अब इस्तेमाल नहीं किया जाता) -

TYPE_ROTATION_VECTOR

Glass पर, Android के इन सेंसर का इस्तेमाल नहीं किया जा सकता:

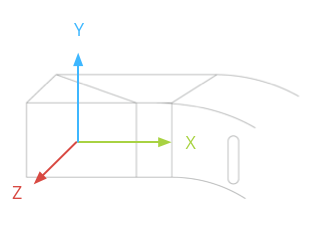

Glass के सेंसर के कोऑर्डिनेट सिस्टम को इस इमेज में दिखाया गया है. यह Glass के डिसप्ले के हिसाब से होता है. ज़्यादा जानकारी के लिए, सेंसर कोऑर्डिनेट सिस्टम देखें.

ऐक्सिलरोमीटर, जाइरोस्कोप, और मैग्नेटोमीटर, Glass डिवाइस के ऑप्टिक्स पॉड पर मौजूद होते हैं. उपयोगकर्ता, डिवाइस को अपनी आंखों के हिसाब से सेट करने के लिए इसे घुमाते हैं. ऑप्टिक्स पॉड के ऐंगल को सीधे तौर पर मेज़र नहीं किया जा सकता. इसलिए, ऐप्लिकेशन के लिए इन सेंसर से मिले ऐंगल का इस्तेमाल करते समय इस बात का ध्यान रखें. जैसे, कंपास हेडिंग.

बैटरी लाइफ़ बढ़ाने के लिए, सेंसर की आवाज़ सिर्फ़ तब सुनें, जब आपको उनकी ज़रूरत हो. सेंसर से डेटा इकट्ठा करने की प्रोसेस शुरू और बंद करने का फ़ैसला लेते समय, ऐप्लिकेशन की ज़रूरतों और लाइफ़साइकल के बारे में सोचें.

सेंसर इवेंट कॉलबैक, यूज़र इंटरफ़ेस (यूआई) थ्रेड पर चलते हैं. इसलिए, इवेंट को प्रोसेस करें और जल्द से जल्द जवाब दें. अगर प्रोसेसिंग में ज़्यादा समय लगता है, तो सेंसर इवेंट को एक कतार में रखें और उन्हें हैंडल करने के लिए बैकग्राउंड थ्रेड का इस्तेमाल करें.

सिर की गतिविधि को ट्रैक करने के लिए, 50 हर्ट्ज़ का सैंपलिंग रेट अक्सर काफ़ी होता है.

सेंसर इस्तेमाल करने के तरीके के बारे में ज़्यादा जानने के लिए, Android डेवलपर गाइड देखें.

जगह की जानकारी

Glass Enterprise Edition 2 डिवाइस में जीपीएस मॉड्यूल नहीं होता. इसलिए, यह उपयोगकर्ता की जगह की जानकारी नहीं देता. हालांकि, इसमें जगह की जानकारी देने वाली सेवाएं लागू की गई हैं. आस-पास मौजूद वाई-फ़ाई नेटवर्क और ब्लूटूथ डिवाइसों की सूची दिखाने के लिए, यह ज़रूरी है.

अगर आपके ऐप्लिकेशन के पास डिवाइस के मालिक के तौर पर काम करने के अधिकार हैं, तो इसका इस्तेमाल करके प्रोग्राम के हिसाब से, सुरक्षित सेटिंग की वैल्यू में बदलाव किया जा सकता है:

Kotlin

val devicePolicyManager = context .getSystemService(Context.DEVICE_POLICY_SERVICE) as DevicePolicyManager if (devicePolicyManager.isDeviceOwnerApp(context.getPackageName())) { val componentName = ComponentName(context, MyDeviceAdmin::class.java) devicePolicyManager.setSecureSetting( componentName, Settings.Secure.LOCATION_MODE, Settings.Secure.LOCATION_MODE_SENSORS_ONLY.toString() ) }

Java

final DevicePolicyManager devicePolicyManager = (DevicePolicyManager) context .getSystemService(Context.DEVICE_POLICY_SERVICE); if (devicePolicyManager.isDeviceOwnerApp(context.getPackageName())) { final ComponentName componentName = new ComponentName(context, MyDeviceAdmin.class); devicePolicyManager.setSecureSetting(componentName, Settings.Secure.LOCATION_MODE, String.valueOf(Settings.Secure.LOCATION_MODE_SENSORS_ONLY)); }

अगर तीसरे पक्ष के एमडीएम समाधान का इस्तेमाल किया जाता है, तो एमडीएम समाधान में आपके लिए इन सेटिंग को बदलने की सुविधा होनी चाहिए.