ดูวิธีที่ Google พัฒนารูปแบบการจัดประเภทภาพ ขั้นสูงเพื่อขับเคลื่อนการค้นหาใน Google Photos สร้างหลักสูตรข้อขัดข้องเกี่ยวกับโครงข่ายระบบประสาทเทียม จากนั้นสร้างตัวแยกประเภทรูปภาพของคุณเองเพื่อแยกรูปภาพแมวออกจากรูปภาพสุนัข

สิ่งที่ต้องมีก่อน

หลักสูตรเร่งรัดเกี่ยวกับแมชชีนเลิร์นนิง หรือประสบการณ์ที่เทียบเท่าในด้านแมชชีนเลิร์นนิง

ความเชี่ยวชาญด้านการเขียนโปรแกรมขั้นพื้นฐาน และการเขียนโค้ดสําหรับประสบการณ์ใน Python

บทนำ

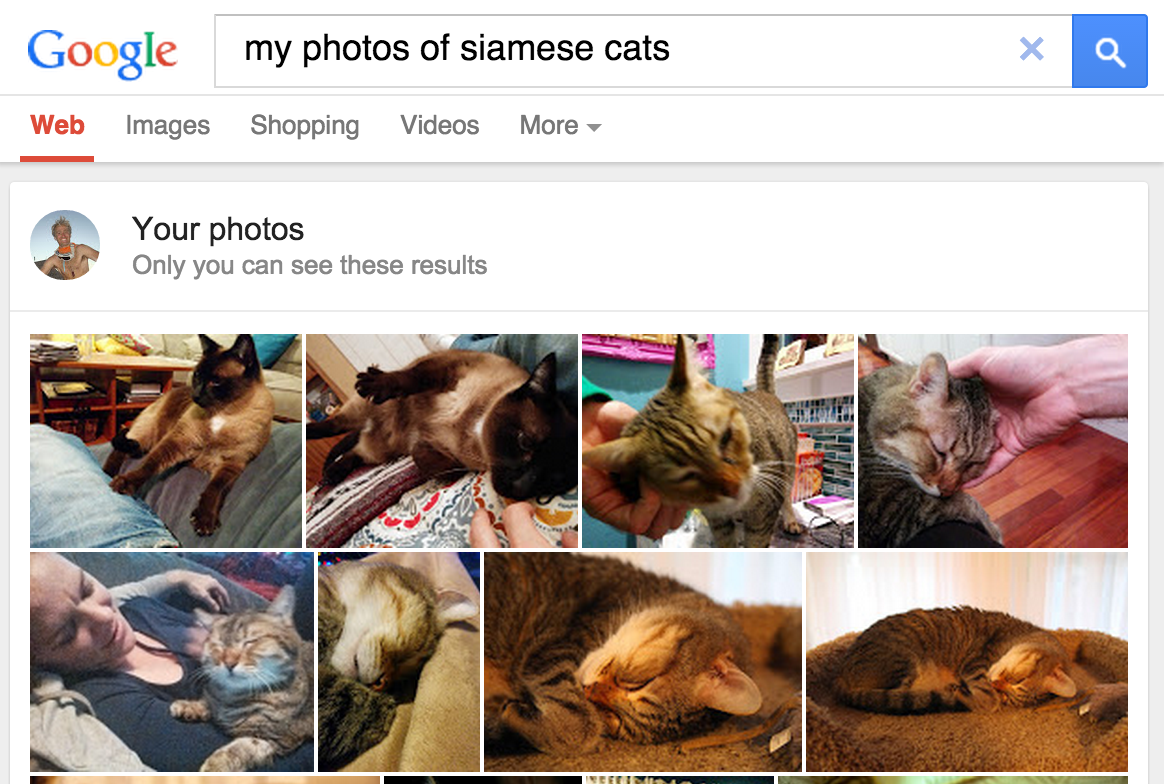

ในเดือนพฤษภาคม 2013 Google เปิดตัวการค้นหารูปภาพส่วนตัวซึ่งทําให้ผู้ใช้เรียกดูรูปภาพในคลังภาพของตัวเองได้โดยอิงตามออบเจ็กต์ที่แสดงในรูปภาพ

รูปที่ 1 การค้นหา"แมว"ใน Google Photos ส่งสินค้ามา

รูปที่ 1 การค้นหา"แมว"ใน Google Photos ส่งสินค้ามา

ฟีเจอร์ต่อมาซึ่งรวมอยู่ใน Google Photos ในปี 2015 ถือว่าเป็นเกมที่พลิกโฉมกันอย่างกว้างขวาง เป็นการพิสูจน์แนวคิดว่าซอฟต์แวร์คอมพิวเตอร์วิทัศน์อาจจัดหมวดหมู่รูปภาพเป็นมาตรฐานของมนุษย์ ซึ่งเพิ่มคุณค่าได้หลายวิธีดังนี้

- ผู้ใช้ไม่จําเป็นต้องติดแท็กรูปภาพด้วยป้ายกํากับอีกต่อไป เช่น "beach" เพื่อจัดหมวดหมู่เนื้อหารูปภาพ โดยการขจัดงานที่ต้องทําด้วยตนเองซึ่งอาจน่าเบื่อเมื่อจัดการรูปภาพหลายร้อยหรือหลายพันรูป

- ผู้ใช้สามารถสํารวจคอลเล็กชันรูปภาพได้ด้วยวิธีใหม่ๆ โดยใช้ข้อความค้นหาเพื่อค้นหารูปภาพที่มีออบเจ็กต์ที่อาจไม่เคยติดแท็กไว้ เช่น อาจค้นหารูป "" Palm" เพื่อแสดงรูปวันหยุดทั้งหมด ที่มีต้นปาล์มอยู่ด้านหลัง

- ซอฟต์แวร์อาจ {0}quot;see" ความแตกต่างทางการจัดหมวดหมู่ที่ผู้ใช้ปลายทางเองอาจมองไม่เห็น (เช่น การจําแนกแมวสยามและแมวอะบิสซิน) การเสริมความรู้ของผู้ใช้อย่างมีประสิทธิภาพ' ความรู้เกี่ยวกับโดเมน

วิธีการทํางานของการแยกประเภทรูปภาพ

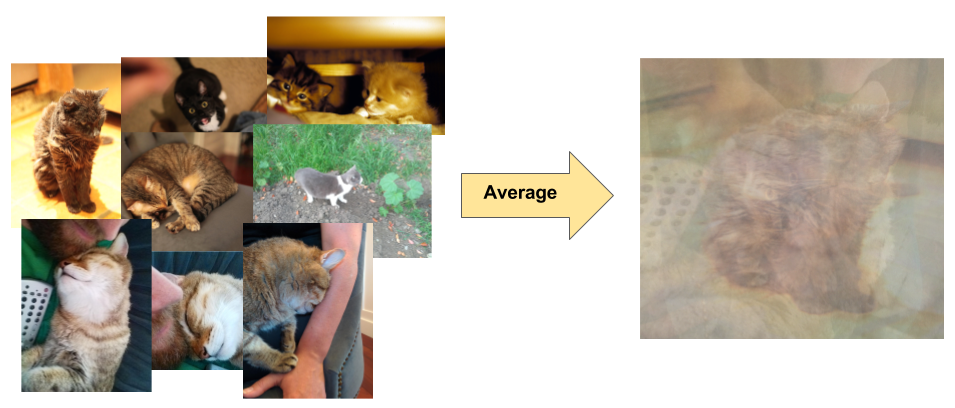

การแยกประเภทรูปภาพคือโจทย์การเรียนรู้ที่มีการควบคุมดูแล โดยจะกําหนดชุดคลาสเป้าหมาย (ออบเจ็กต์ที่จะระบุในรูปภาพ) และฝึกโมเดลให้รู้จําโดยใช้รูปภาพตัวอย่างที่มีป้ายกํากับ โมเดลคอมพิวเตอร์วิทัศน์ยุคแรกอาศัยข้อมูลพิกเซลดิบเป็นอินพุตของโมเดล อย่างไรก็ตาม ดังที่แสดงในรูปที่ 2 ข้อมูลพิกเซลดิบเพียงอย่างเดียวไม่ได้ให้ความเสถียรที่เพียงพอในการรวบรวมรูปแบบอื่นๆ ของออบเจ็กต์ตามที่แสดงในรูปภาพ ตําแหน่งของวัตถุ พื้นหลังหลังวัตถุ แสงแวดล้อม มุมกล้อง และการโฟกัสของกล้องอาจทําให้เกิดความผันผวนในข้อมูลพิกเซลดิบได้ ความแตกต่างเหล่านี้มีนัยสําคัญมากจนแก้ไขไม่ได้โดยการนําค่าเฉลี่ยถ่วงน้ําหนักของค่า RGB ที่ถ่วงน้ําหนักมา

รูปที่ 2 ซ้าย: แมวสามารถถ่ายภาพในท่าต่างๆ พร้อมฉากหลังและสภาวะแสงที่แตกต่างกัน ขวา: การดูข้อมูลพิกเซลเฉลี่ยเพื่อพิจารณาความหลากหลายนี้

ไม่ได้ให้ข้อมูลที่เป็นประโยชน์

รูปที่ 2 ซ้าย: แมวสามารถถ่ายภาพในท่าต่างๆ พร้อมฉากหลังและสภาวะแสงที่แตกต่างกัน ขวา: การดูข้อมูลพิกเซลเฉลี่ยเพื่อพิจารณาความหลากหลายนี้

ไม่ได้ให้ข้อมูลที่เป็นประโยชน์

เพื่อให้โมเดลออบเจ็กต์มีความยืดหยุ่นมากขึ้น โมเดลคอมพิวเตอร์วิทัศน์แบบคลาสสิกได้เพิ่มฟีเจอร์ใหม่ที่ได้จากข้อมูลพิกเซล เช่น ฮิสโตแกรมสี พื้นผิว และรูปร่าง ข้อเสียของกลยุทธ์นี้คือวิศวกรรมฟีเจอร์ได้ก่อให้เกิดภาระที่แท้จริง เนื่องจากมีข้อมูลมากมายที่ต้องแก้ไข สําหรับตัวแยกประเภทแมว สีใดที่มีความเกี่ยวข้องมากที่สุด รูปร่างมีความยืดหยุ่นมากน้อยแค่ไหน เพราะฟีเจอร์ต่างๆ ต้องได้รับการปรับแต่งอย่างแม่นยํา การสร้างรูปแบบที่มีประสิทธิภาพนั้นทําได้ค่อนข้างยากและความแม่นยําก็ลดลง