이 용어집에서는 인공지능 용어를 정의합니다.

A

절제

모델에서 특성 또는 구성요소를 일시적으로 삭제하여 중요도를 평가하는 기법입니다. 그런 다음 해당 기능이나 구성요소 없이 모델을 재학습시키고 재학습된 모델의 성능이 크게 저하되면 삭제된 기능이나 구성요소가 중요한 것일 수 있습니다.

예를 들어 10개의 기능으로 분류 모델을 학습하고 테스트 세트에서 88% 의 정밀도를 달성한다고 가정해 보겠습니다. 첫 번째 특성의 중요도를 확인하려면 다른 9개의 특성만 사용하여 모델을 재학습하면 됩니다. 재학습된 모델의 성능이 크게 저하되는 경우 (예: 정밀도 55%) 삭제된 특성이 중요한 것일 수 있습니다. 반대로 재학습된 모델의 성능이 동일하게 우수하다면 해당 기능은 그다지 중요하지 않았을 수 있습니다.

제거는 다음의 중요도를 파악하는 데도 도움이 됩니다.

- 더 큰 ML 시스템의 전체 하위 시스템과 같은 더 큰 구성요소

- 데이터 전처리 단계와 같은 프로세스 또는 기법

두 경우 모두 구성요소를 삭제한 후 시스템 성능이 어떻게 변하는지 (또는 변하지 않는지) 관찰합니다.

A/B 테스트

두 개 이상의 기법 (A 및 B)을 비교하는 통계적 방법입니다. 일반적으로 A는 기존 기법이고 B는 새로운 기법입니다. A/B 테스트를 통해 어떤 기법이 더 나은 실적을 내는지뿐만 아니라 그 차이가 통계적으로 유의미한지 확인할 수 있습니다.

A/B 테스트는 일반적으로 두 기법의 단일 측정항목을 비교합니다. 예를 들어 두 기법의 모델 정확도를 비교합니다. 하지만 A/B 테스트에서는 유한한 수의 측정항목을 비교할 수도 있습니다.

가속기 칩

딥 러닝 알고리즘에 필요한 핵심 계산을 수행하도록 설계된 특수 하드웨어 구성 요소의 범주입니다.

가속기 칩 (줄여서 가속기)은 범용 CPU에 비해 학습 및 추론 작업의 속도와 효율성을 크게 높일 수 있습니다. 신경망 학습 및 유사한 컴퓨팅 집약적 작업에 적합합니다.

가속기 칩의 예는 다음과 같습니다.

- 심층 학습을 위한 전용 하드웨어가 탑재된 Google의 Tensor Processing Unit (TPU)

- NVIDIA의 GPU는 원래 그래픽 처리를 위해 설계되었지만 병렬 처리를 지원하도록 설계되어 처리 속도를 크게 높일 수 있습니다.

정확성

올바른 분류 예측 수를 총 예측 수로 나눈 값입니다. 이는 다음과 같은 의미입니다.

예를 들어 올바른 예측을 40번 하고 잘못된 예측을 10번 한 모델의 정확도는 다음과 같습니다.

이진 분류는 올바른 예측과 잘못된 예측의 다양한 카테고리에 대한 구체적인 이름을 제공합니다. 따라서 이진 분류의 정확도 공식은 다음과 같습니다.

각 항목의 의미는 다음과 같습니다.

자세한 내용은 머신러닝 단기집중과정의 분류: 정확도, 재현율, 정밀도 및 관련 측정항목을 참고하세요.

action

강화 학습에서 에이전트가 환경의 상태 간에 전환되는 메커니즘입니다. 에이전트는 정책을 사용하여 작업을 선택합니다.

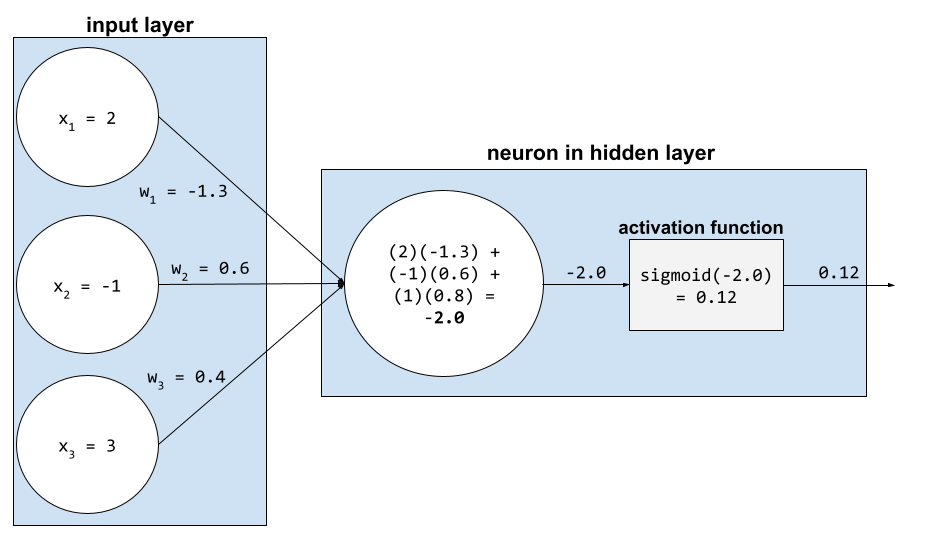

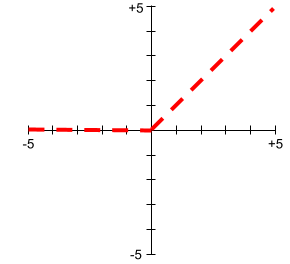

활성화 함수

신경망이 특성과 라벨 간의 비선형 (복잡한) 관계를 학습할 수 있도록 지원하는 함수입니다.

인기 있는 활성화 함수는 다음과 같습니다.

활성화 함수의 플롯은 단일 직선이 아닙니다. 예를 들어 ReLU 활성화 함수의 플롯은 두 개의 직선으로 구성됩니다.

시그모이드 활성화 함수의 플롯은 다음과 같습니다.

자세한 내용은 머신러닝 단기집중과정의 신경망: 활성화 함수를 참고하세요.

능동적 학습

알고리즘이 학습하는 데이터의 일부를 선택하는 학습 접근 방식입니다. 능동적 학습은 라벨이 지정된 예가 부족하거나 비싸서 취득하기 어려운 경우에 특히 유용합니다. 무조건 다양한 범위의 라벨이 있는 예를 찾는 대신, 능동적 학습 알고리즘에서 학습에 필요한 특정 범위의 예를 선택적으로 찾습니다.

AdaGrad

각 매개변수의 경사를 재조정하여 효과적으로 각 매개변수에 독립 학습률을 부여하는 정교한 경사하강법 알고리즘입니다. 자세한 설명은 온라인 학습 및 확률적 최적화를 위한 적응형 하위 기울기 방법을 참고하세요.

적응

튜닝 또는 파인 튜닝의 동의어입니다.

에이전트

사용자를 대신하여 작업을 계획하고 실행하기 위해 다중 모드 사용자 입력을 추론할 수 있는 소프트웨어입니다.

강화 학습에서 에이전트는 정책을 사용하여 환경의 상태 간 전환에서 얻는 예상 수익을 극대화하는 엔티티입니다.

대리적/대리자적

agent의 형용사 형태입니다. 에이전트란 에이전트가 보유한 속성 (예: 자율성)을 의미합니다.

에이전트형 워크플로

에이전트가 목표를 달성하기 위해 자율적으로 작업을 계획하고 실행하는 동적 프로세스입니다. 이 프로세스에는 추론, 외부 도구 호출, 계획 자체 수정이 포함될 수 있습니다.

병합형 군집화

계층적 군집화를 참고하세요.

AI 슬롭

품질보다 양을 우선시하는 생성형 AI 시스템의 출력 예를 들어 AI 슬롭이 있는 웹페이지는 저렴하게 제작된 AI 생성 저품질 콘텐츠로 가득합니다.

이상 감지

이상치를 식별하는 프로세스입니다. 예를 들어 특정 특성의 평균이 100이고 표준편차가 10인 경우 이상치 감지에서 200 값을 의심스러운 값으로 표시해야 합니다.

AR

증강 현실의 약어입니다.

PR 곡선 아래 영역

PR AUC (PR 곡선 아래 영역)를 참고하세요.

ROC 곡선 아래의 면적

AUC (ROC 곡선 아래 영역)을 참고하세요.

범용 인공지능

광범위한 문제 해결 능력, 창의성, 적응력을 보여주는 비인간적 메커니즘입니다. 예를 들어, 인공 일반 지능을 보여주는 프로그램은 텍스트를 번역하고, 교향곡을 작곡하고, 그리고 아직 발명되지 않은 게임에서도 뛰어난 성과를 낼 수 있습니다.

인공지능

정교한 작업을 해결할 수 있는 인간이 아닌 프로그램 또는 모델 예를 들어 텍스트를 번역하는 프로그램이나 모델, 방사선 이미지에서 질병을 식별하는 프로그램이나 모델은 모두 인공지능을 나타냅니다.

공식적으로 머신러닝은 인공지능의 하위 분야입니다. 하지만 최근 몇 년간 일부 조직에서는 인공지능과 머신러닝이라는 용어를 혼용하기 시작했습니다.

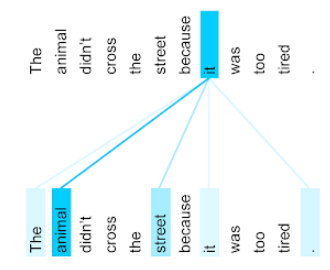

Attention,

신경망에서 특정 단어나 단어의 중요도를 나타내는 데 사용되는 메커니즘입니다. 어텐션은 모델이 다음 토큰/단어를 예측하는 데 필요한 정보의 양을 압축합니다. 일반적인 어텐션 메커니즘은 입력 집합에 대한 가중 합계로 구성될 수 있으며, 각 입력의 가중치는 신경망의 다른 부분에서 계산됩니다.

트랜스포머의 빌딩 블록인 셀프 어텐션 및 멀티 헤드 셀프 어텐션도 참고하세요.

셀프 어텐션에 관한 자세한 내용은 머신러닝 단기집중과정의 LLM: 대규모 언어 모델이란 무엇인가요?를 참고하세요.

속성

기능의 동의어입니다.

머신러닝 공정성에서 속성은 개인과 관련된 특성을 의미하는 경우가 많습니다.

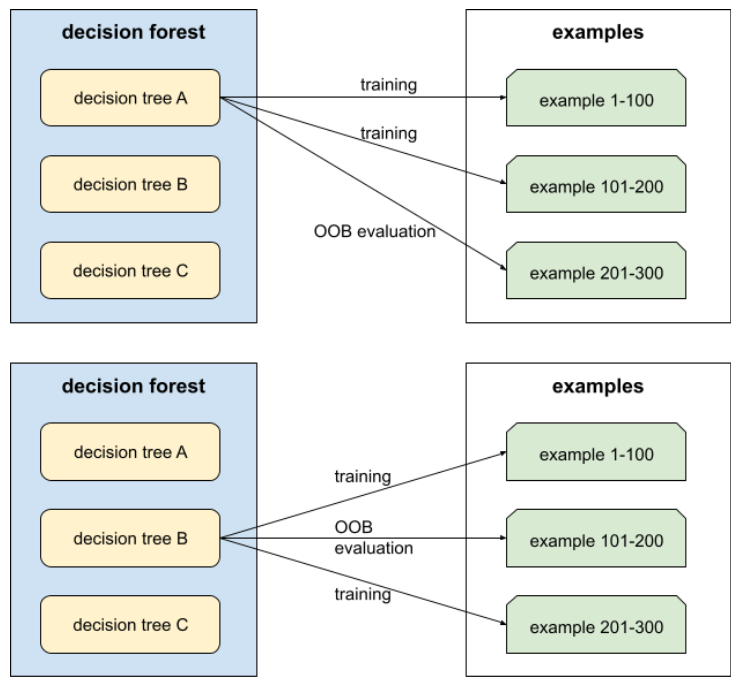

속성 샘플링

각 결정 트리가 조건을 학습할 때 가능한 특성의 무작위 하위 집합만 고려하는 결정 포레스트를 학습하는 전략입니다. 일반적으로 각 노드에 대해 서로 다른 기능 하위 집합이 샘플링됩니다. 반면 속성 샘플링 없이 결정 트리를 학습할 때는 각 노드에 가능한 모든 특성이 고려됩니다.

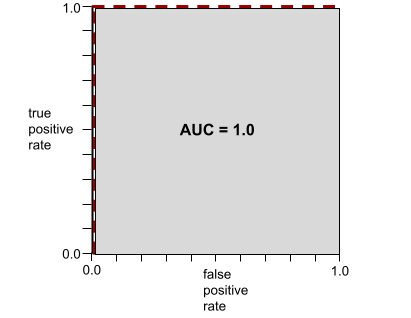

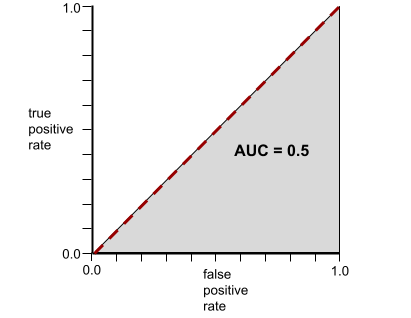

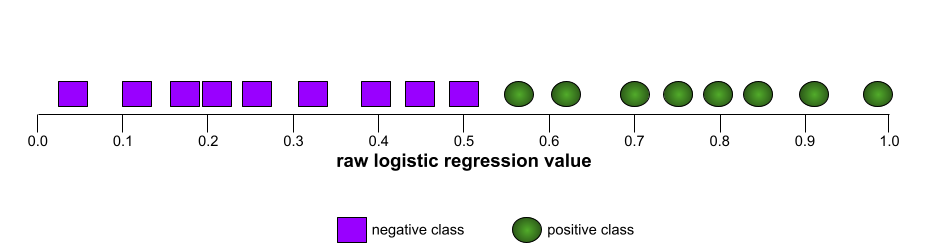

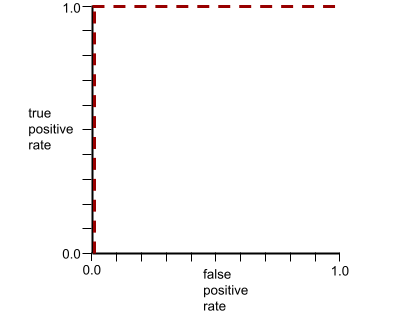

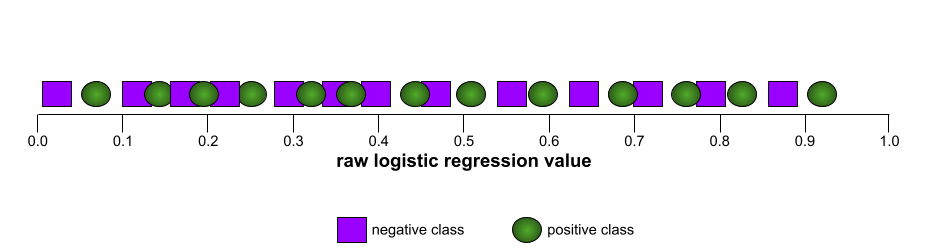

AUC (ROC 곡선 아래 영역)

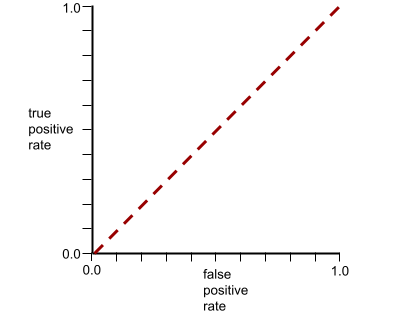

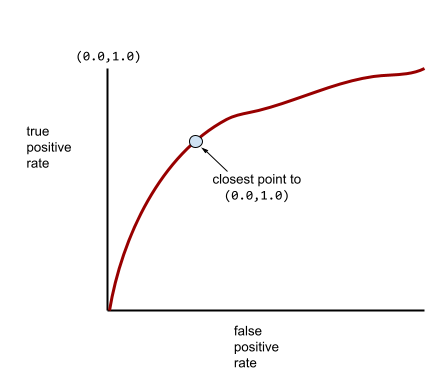

긍정 클래스를 부정 클래스에서 분리하는 이진 분류 모델의 능력을 나타내는 0.0~1.0 사이의 숫자입니다. AUC가 1.0에 가까울수록 모델이 클래스를 서로 분리하는 능력이 우수합니다.

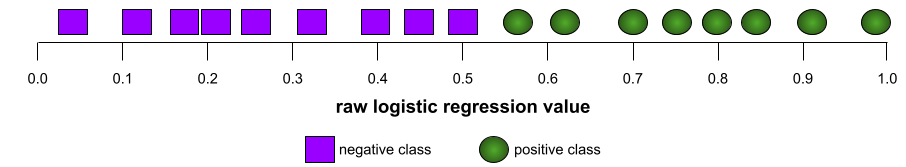

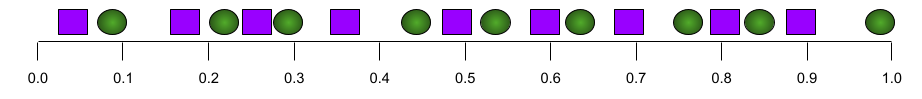

예를 들어 다음 그림은 포지티브 클래스 (녹색 타원)를 네거티브 클래스 (보라색 직사각형)와 완벽하게 구분하는 분류 모델을 보여줍니다. 이 비현실적으로 완벽한 모델의 AUC는 1.0입니다.

반대로 다음 그림은 무작위 결과를 생성한 분류 모델의 결과를 보여줍니다. 이 모델의 AUC는 0.5입니다.

예, 앞의 모델의 AUC는 0.0이 아닌 0.5입니다.

대부분의 모델은 두 극단 사이에 있습니다. 예를 들어 다음 모델은 긍정적인 것과 부정적인 것을 어느 정도 구분하므로 AUC가 0.5와 1.0 사이에 있습니다.

AUC는 분류 기준점에 설정된 값을 무시합니다. AUC는 가능한 모든 분류 임곗값을 고려합니다.

자세한 내용은 머신러닝 단기집중과정의 분류: ROC 및 AUC를 참고하세요.

증강 현실

컴퓨터로 생성된 이미지를 사용자의 실제 세계 뷰에 중첩하여 합성 뷰를 제공하는 기술입니다.

autoencoder

입력에서 가장 중요한 정보를 추출하도록 학습하는 시스템 오토인코더는 인코더와 디코더의 조합입니다. 오토인코더는 다음 두 단계 프로세스를 사용합니다.

- 인코더는 입력을 손실이 있는 하위 차원(중간) 형식에 매핑합니다.

- 디코더는 낮은 차원의 형식을 원래 높은 차원의 입력 형식에 매핑하여 원래 입력의 손실 버전을 빌드합니다.

오토인코더는 디코더가 인코더의 중간 형식에서 원래 입력을 최대한 가깝게 재구성하도록 하여 엔드 투 엔드로 학습됩니다. 중간 형식이 원래 형식보다 작기 때문에(차원이 낮음) 자동 인코더는 입력에서 필수적인 정보를 학습해야 하며 출력은 입력과 완전히 동일하지 않습니다.

예를 들면 다음과 같습니다.

- 입력 데이터가 그래픽인 경우 정확하지 않은 사본은 원본 그래픽과 유사하지만 약간 수정됩니다. 정확하지 않은 사본은 원본 그래픽에서 노이즈를 제거하거나 누락된 픽셀을 채울 수 있습니다.

- 입력 데이터가 텍스트인 경우 자동 인코더는 원본 텍스트를 모방하지만 동일하지는 않은 새 텍스트를 생성합니다.

변분 오토인코더도 참고하세요.

자동 평가

소프트웨어를 사용하여 모델 출력의 품질을 판단합니다.

모델 출력이 비교적 간단한 경우 스크립트나 프로그램이 모델의 출력을 모범 대답과 비교할 수 있습니다. 이러한 유형의 자동 평가를 프로그래매틱 평가라고도 합니다. ROUGE 또는 BLEU와 같은 측정항목은 프로그래매틱 평가에 유용한 경우가 많습니다.

모델 출력이 복잡하거나 정답이 없는 경우 자동 평가기라는 별도의 ML 프로그램이 자동 평가를 실행하기도 합니다.

인간 평가와 대비되는 개념입니다.

자동화 편향

자동 의사결정 시스템에 오류가 있는 경우에도 불구하고 의사 결정권자가 자동 의사결정 시스템에서 제공되는 권장사항을 자동화 없이 생성된 정보보다 우선시하는 경우입니다.

자세한 내용은 머신러닝 단기집중과정의 공정성: 편향 유형을 참고하세요.

AutoML

머신러닝 모델을 빌드하는 자동화된 프로세스 AutoML은 다음과 같은 작업을 자동으로 실행할 수 있습니다.

AutoML은 머신러닝 파이프라인을 개발하는 데 드는 시간과 노력을 줄이고 예측 정확도를 높일 수 있으므로 데이터 과학자에게 유용합니다. 또한 복잡한 머신러닝 작업을 비전문가도 더 쉽게 이용할 수 있도록 지원합니다.

자세한 내용은 머신러닝 단기집중과정의 자동화된 머신러닝 (AutoML)을 참고하세요.

자동 평가 도구 평가

인간 평가와 자동 평가를 결합하여 생성형 AI 모델의 출력 품질을 판단하는 하이브리드 메커니즘입니다. 자동 평가 도구는 인간 평가로 생성된 데이터를 학습한 ML 모델입니다. 이상적으로는 자동 평가 도구가 사람 평가자를 모방하는 방법을 학습합니다.사전 빌드된 자동 평가 도구를 사용할 수 있지만 가장 좋은 자동 평가 도구는 평가 중인 태스크에 맞게 특별히 미세 조정된 것입니다.

자기 회귀 모델

자체 이전 예측을 기반으로 예측을 추론하는 모델 예를 들어 자기 회귀 언어 모델은 이전에 예측된 토큰을 기반으로 다음 토큰을 예측합니다. 모든 Transformer 기반 대규모 언어 모델은 자기 회귀 모델입니다.

반면 GAN 기반 이미지 모델은 일반적으로 자기 회귀적이지 않습니다. 단일 순방향 패스에서 이미지를 생성하고 단계별로 반복적으로 생성하지 않기 때문입니다. 하지만 일부 이미지 생성 모델은 단계별로 이미지를 생성하므로 자기 회귀적입니다.

보조 손실

가중치가 무작위로 초기화되는 초기 반복 중에 학습을 가속화하는 데 도움이 되는 손실 함수입니다. 신경망 모델의 기본 손실 함수와 함께 사용됩니다.

보조 손실 함수는 효과적인 그라데이션을 이전 레이어로 푸시합니다. 이렇게 하면 기울기 소실 문제를 해결하여 학습 중에 수렴이 촉진됩니다.

k에서의 평균 정밀도

순위가 지정된 결과(예: 책 추천의 번호가 매겨진 목록)를 생성하는 단일 프롬프트에 대한 모델의 성능을 요약하는 측정항목입니다. k에서의 평균 정밀도는 각 관련 결과의 k에서의 정밀도 값의 평균입니다. 따라서 k에서의 평균 정밀도 공식은 다음과 같습니다.

\[{\text{average precision at k}} = \frac{1}{n} \sum_{i=1}^n {\text{precision at k for each relevant item} } \]

각 항목의 의미는 다음과 같습니다.

- \(n\) 은 목록에 있는 관련 항목의 수입니다.

k에서의 재현율과 대비되는 개념입니다.

축 정렬 조건

결정 트리에서 단일 기능만 포함하는 조건입니다. 예를 들어 area가 기능인 경우 축 정렬 조건은 다음과 같습니다.

area > 200

사선 조건과 대비되는 개념입니다.

B

역전파

신경망 학습에는 다음 2패스 주기의 반복이 많이 필요합니다.

- 정방향 패스 중에 시스템은 예의 배치를 처리하여 예측을 생성합니다. 시스템은 각 예측을 각 라벨 값과 비교합니다. 예측값과 라벨 값의 차이가 해당 예의 손실입니다. 시스템은 모든 예의 손실을 집계하여 현재 배치에 대한 총 손실을 계산합니다.

- 역방향 패스(역전파) 중에 시스템은 모든 숨겨진 레이어에 있는 모든 뉴런의 가중치를 조정하여 손실을 줄입니다.

신경망에는 여러 히든 레이어에 걸쳐 많은 뉴런이 포함되는 경우가 많습니다. 이러한 각 뉴런은 서로 다른 방식으로 전체 손실에 기여합니다. 역전파는 특정 뉴런에 적용되는 가중치를 늘릴지 줄일지 결정합니다.

학습률은 각 역방향 패스가 각 가중치를 늘리거나 줄이는 정도를 제어하는 승수입니다. 학습률이 크면 학습률이 작은 경우보다 각 가중치가 더 많이 증가하거나 감소합니다.

미적분학 용어로 역전파는 미적분학의 연쇄 법칙을 구현합니다. 즉, 역전파는 각 매개변수에 대한 오류의 편미분을 계산합니다.

몇 년 전에는 ML 실무자가 역전파를 구현하기 위해 코드를 작성해야 했습니다. 이제 Keras와 같은 최신 ML API에서 역전파를 구현합니다. 다양한 혜택이 마음에 드셨나요?

자세한 내용은 머신러닝 단기집중과정의 신경망을 참고하세요.

bagging

각 구성 모델이 복원 추출된 학습 예의 무작위 하위 집합에 대해 학습하는 앙상블을 학습하는 방법입니다. 예를 들어 랜덤 포레스트는 배깅으로 학습된 결정 트리의 모음입니다.

배깅이라는 용어는 bootstrap aggregating의 줄임말입니다.

자세한 내용은 결정 트리 과정의 랜덤 포레스트를 참고하세요.

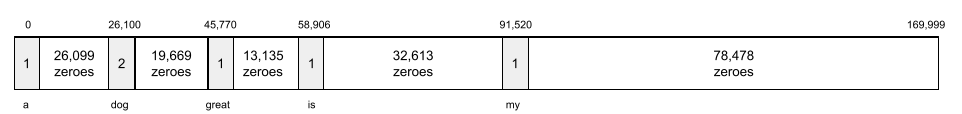

단어 집합

순서에 상관없이 단어를 구 또는 구절로 표현합니다. 예를 들어, 단어 집합은 다음 세 구를 동일하게 표현합니다.

- the dog jumps

- jumps the dog

- dog jumps the

각 단어는 희소 벡터의 색인에 매핑되며 벡터에는 어휘의 모든 단어에 대한 색인이 포함됩니다. 예를 들어, the dog jumps 구는 특징 벡터에 매핑되며, 벡터에는 the, dog 및 jumps 단어에 해당하는 세 색인에 0이 아닌 값이 표시됩니다. 0이 아닌 값은 다음 중 하나일 수 있습니다.

- 1은 단어가 있음을 나타냅니다.

- 단어가 집합에 나타나는 횟수입니다. 예를 들어, the maroon dog is a dog with maroon fur라는 어구가 있는 경우 maroon과 dog는 모두 2로 표시되고 다른 단어는 1로 표시됩니다.

- 가방에 단어가 등장하는 횟수를 세는 로그 값과 같은 다른 값입니다.

기준

다른 모델 (일반적으로 더 복잡한 모델)의 성능을 비교하는 데 참조용으로 사용되는 모델입니다. 예를 들어 로지스틱 회귀 모델은 심층 모델의 좋은 기준이 될 수 있습니다.

특정 문제의 경우 기준은 새 모델이 유용하려면 달성해야 하는 최소 예상 성능을 모델 개발자가 수치화하는 데 도움이 됩니다.

기본 모델

특정 작업이나 애플리케이션을 해결하기 위해 미세 조정의 시작점으로 사용할 수 있는 선행 학습된 모델입니다.

일괄

한 번의 학습 반복에 사용되는 예 집합입니다. 배치 크기에 따라 배치에 포함되는 예시 수가 결정됩니다.

배치가 에포크와 어떤 관련이 있는지는 에포크를 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 하이퍼파라미터를 참고하세요.

일괄 추론

더 작은 하위 집합 ('배치')으로 나뉜 여러 라벨이 지정되지 않은 예에 대한 예측을 추론하는 프로세스입니다.

배치 추론은 가속기 칩의 병렬화 기능을 활용할 수 있습니다. 즉, 여러 가속기가 라벨이 지정되지 않은 다양한 예시 배치에서 동시에 예측을 추론하여 초당 추론 수를 크게 늘릴 수 있습니다.

자세한 내용은 머신 러닝 집중 강좌에서 생산 ML 시스템: 정적 추론 대 동적 추론을 참조하세요.

배치 정규화

숨겨진 레이어의 활성화 함수의 입력 또는 출력을 정규화합니다. 배치 정규화를 사용하면 다음과 같은 이점이 있습니다.

배치 크기

배치의 예 수입니다. 예를 들어 배치 크기가 100이면 모델은 반복당 100개의 예시를 처리합니다.

다음은 인기 있는 배치 크기 전략입니다.

- 배치 크기가 1인 확률적 경사하강법 (SGD)

- 전체 배치: 배치 크기가 전체 학습 세트의 예시 수입니다. 예를 들어 학습 세트에 백만 개의 예가 포함되어 있으면 배치 크기는 백만 개의 예가 됩니다. 전체 배치 전략은 일반적으로 비효율적입니다.

- 미니 배치: 배치 크기는 일반적으로 10~1,000입니다. 일반적으로 미니 배치가 가장 효율적인 전략입니다.

자세한 내용은 다음을 참조하세요.

- 머신러닝 단기집중과정의 프로덕션 ML 시스템: 정적 추론과 동적 추론 비교

- 딥 러닝 튜닝 플레이북.

베이지안 신경망

가중치와 출력의 불확실성을 설명하는 확률적 신경망입니다. 표준 신경망 회귀 모델은 일반적으로 스칼라 값을 예측합니다. 예를 들어 표준 모델은 8억5천만원의 주택 가격을 예측합니다. 반면, 확률적 신경망은 값의 분포를 예측합니다. 예를 들어 확률적 모델은 표준 편차가 67,200인 853,000의 주택 가격을 예측합니다.

확률적 신경망은 베이즈의 정리에 따라 가중치와 예측으로 불확실성을 계산합니다. 베이즈 신경망은 제약 회사 관련 모델의 경우처럼 불확실성을 수치화해야 하는 경우에 유용합니다. 또한 확률적 신경망을 사용하면 과적합을 방지할 수 있습니다.

Bayesian 최적화

베이즈 학습 기법을 사용하여 불확실성을 정량화하는 대리자를 대신 최적화하여 계산 비용이 많이 드는 목표 함수를 최적화하는 확률적 회귀 모델 기법입니다. 베이지안 최적화는 자체적으로 매우 비용이 많이 들기 때문에 일반적으로 초매개변수 선택과 같이 평가하는 데 비용이 많이 들고 매개변수 수가 적은 작업을 최적화하는 데 사용됩니다.

벨만 방정식

강화 학습에서 최적의 Q 함수가 충족하는 다음 항등식

\[Q(s, a) = r(s, a) + \gamma \mathbb{E}_{s'|s,a} \max_{a'} Q(s', a')\]

강화 학습 알고리즘은 이 ID를 적용하여 다음 업데이트 규칙을 사용하여 Q-러닝을 만듭니다.

\[Q(s,a) \gets Q(s,a) + \alpha \left[r(s,a) + \gamma \displaystyle\max_{\substack{a_1}} Q(s',a') - Q(s,a) \right] \]

강화 학습 외에도 벨만 방정식은 동적 프로그래밍에 적용됩니다. 벨만 방정식에 대한 위키백과 항목을 참고하세요.

BERT (Bidirectional Encoder Representations from Transformers)

텍스트 표현을 위한 모델 아키텍처입니다. 학습된 BERT 모델은 텍스트 분류 또는 기타 ML 작업을 위한 더 큰 모델의 일부로 작동할 수 있습니다.

BERT의 특징은 다음과 같습니다.

- Transformer 아키텍처를 사용하므로 self-attention에 의존합니다.

- Transformer의 인코더 부분을 사용합니다. 인코더의 역할은 분류와 같은 특정 작업을 실행하는 것이 아니라 적절한 텍스트 표현을 생성하는 것입니다.

- 양방향입니다.

- 비지도 학습에 마스킹을 사용합니다.

BERT의 변형에는 다음이 포함됩니다.

BERT 개요는 Open Sourcing BERT: State-of-the-Art Pre-training for Natural Language Processing을 참고하세요.

편향(bias)(윤리학/공정성)

1. 특정 사물, 인물 또는 그룹에 대한 정형화, 편견 또는 편애를 말합니다. 이러한 편향은 데이터의 수집과 해석 가능성, 시스템 설계, 사용자가 시스템과 상호작용하는 방식 등에 영향을 줍니다. 이러한 유형의 편향에는 다음이 포함됩니다.

2. 샘플링 또는 보고 절차로 인해 발생하는 체계적인 오류입니다. 이러한 유형의 편향에는 다음이 포함됩니다.

머신러닝 모델의 바이어스 항 또는 예측 편향과 혼동하지 마시기 바랍니다.

자세한 내용은 머신러닝 단기집중과정의 공정성: 편향 유형을 참고하세요.

편향(bias)(수학) 또는 편향 항

원점을 기준으로 한 절편 또는 오프셋입니다. 편향은 머신러닝 모델의 파라미터이며 다음 중 하나로 표시됩니다.

- b

- w0

예를 들어 다음 수식에서 편향은 b입니다.

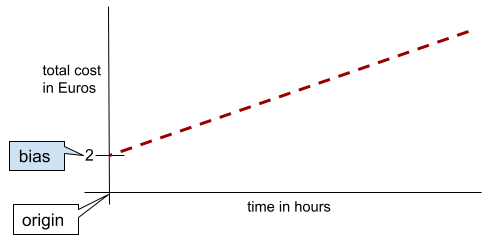

단순한 2차원 선에서 편향은 'y 절편'을 의미합니다. 예를 들어 다음 그림의 선의 편향은 2입니다.

모든 모델이 원점 (0,0)에서 시작하지 않기 때문에 편향이 존재합니다. 예를 들어 놀이공원 입장료가 2유로이고 고객이 머무는 시간당 0.5유로가 추가로 부과된다고 가정해 보겠습니다. 따라서 총비용을 매핑하는 모델에는 가장 낮은 비용이 2유로이므로 2의 편향이 있습니다.

편향은 윤리학 및 공정성의 편향 또는 예측 편향과 혼동해서는 안 됩니다.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀를 참고하세요.

양방향

대상 텍스트 섹션의 앞과 뒤에 있는 텍스트를 모두 평가하는 시스템을 설명하는 데 사용되는 용어입니다. 반면 단방향 시스템은 대상 텍스트 섹션 앞에 있는 텍스트만 평가합니다.

예를 들어 다음 질문에서 밑줄을 나타내는 단어의 확률을 결정해야 하는 마스크 언어 모델을 생각해 보세요.

무슨 _____가 있나요?

단방향 언어 모델은 'What', 'is', 'the'라는 단어가 제공하는 컨텍스트에만 확률을 기반해야 합니다. 반면 양방향 언어 모델은 'with' 및 'you'에서도 컨텍스트를 파악할 수 있으므로 모델이 더 나은 예측을 생성하는 데 도움이 될 수 있습니다.

양방향 언어 모델

이전 및 다음 텍스트를 기반으로 텍스트 발췌문의 지정된 위치에 지정된 토큰이 있을 확률을 결정하는 언어 모델

바이그램

N=2인 N-그램입니다.

이진 분류

상호 배타적인 두 클래스 중 하나를 예측하는 분류 작업의 유형입니다.

예를 들어 다음 두 머신러닝 모델은 각각 이진 분류를 실행합니다.

- 이메일 메시지가 스팸 (포지티브 클래스)인지 스팸 아님 (네거티브 클래스)인지 판단하는 모델입니다.

- 의학적 증상을 평가하여 특정 질병 (양성 클래스)이 있는지 또는 없는지 (음성 클래스)를 판단하는 모델입니다.

다중 클래스 분류와 대비되는 개념입니다.

자세한 내용은 머신러닝 단기집중과정의 분류를 참고하세요.

이진 조건

결정 트리에서 가능한 결과가 두 개(일반적으로 예 또는 아니요)인 조건입니다. 예를 들어 다음은 이진 조건입니다.

temperature >= 100

비이진 조건과 대비되는 개념입니다.

자세한 내용은 결정 트리 과정의 조건 유형을 참고하세요.

비닝

버케팅의 동의어입니다.

블랙박스 모델

모델의 '추론'을 사람이 이해하기 불가능하거나 어렵습니다. 즉, 사람은 프롬프트가 대답에 어떤 영향을 미치는지 알 수 있지만 블랙박스 모델이 대답을 결정하는 정확한 방식은 알 수 없습니다. 즉, 블랙박스 모델에는 해석 가능성이 부족합니다.

대부분의 심층 모델과 대규모 언어 모델은 블랙박스입니다.

BLEU (Bilingual Evaluation Understudy)

예를 들어 스페인어에서 일본어로의 기계 번역을 평가하는 0.0~1.0 사이의 측정항목입니다.

점수를 계산하기 위해 BLEU는 일반적으로 ML 모델의 번역(생성된 텍스트)을 인간 전문가의 번역(참조 텍스트)과 비교합니다. 생성된 텍스트와 참조 텍스트의 N-그램이 일치하는 정도에 따라 BLEU 점수가 결정됩니다.

이 측정항목에 관한 원본 논문은 BLEU: 기계 번역의 자동 평가 방법입니다.

BLEURT도 참고하세요.

BLEURT (Bilingual Evaluation Understudy from Transformers)

한 언어에서 다른 언어로, 특히 영어로 또는 영어에서 기계 번역을 평가하는 측정항목입니다.

영어와 다른 언어 간의 번역의 경우 BLEURT가 BLEU보다 사람의 평가와 더 밀접하게 일치합니다. BLEU와 달리 BLEURT는 의미 유사성을 강조하며 의역을 수용할 수 있습니다.

BLEURT는 사전 학습된 대규모 언어 모델(정확히 말하면 BERT)을 사용하며, 이 모델은 인간 번역가의 텍스트를 기반으로 미세 조정됩니다.

이 측정항목에 관한 원본 논문은 BLEURT: Learning Robust Metrics for Text Generation입니다.

부스팅

모델에서 현재 잘못 분류된 예를 가중치 보정하여 간단하고 그리 정확하지 않은 분류 모델('약한 분류기') 집합을 정확성이 높은 분류 모델('강한 분류기')과 반복적으로 결합하는 머신러닝 기술입니다.

자세한 내용은 결정 트리 과정의 경사 강화 의사 결정 트리란 무엇인가요?를 참고하세요.

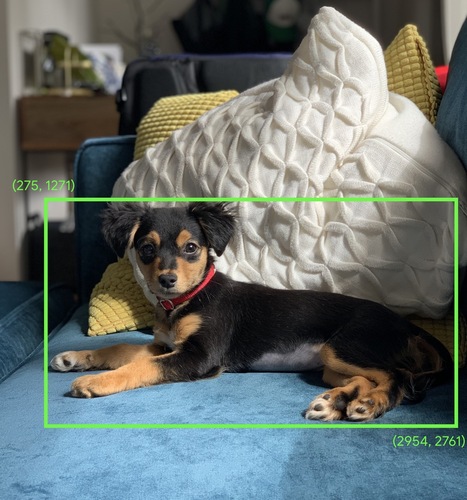

경계 상자

이미지에서 관심 영역(예: 아래 이미지의 개)을 둘러싼 직사각형의 (x, y) 좌표입니다.

방송

행렬 수학 연산에서 피연산자의 모양을 해당 연산과 호환되는 차원으로 확장합니다. 예를 들어, 선형 대수에서는 행렬 덧셈 연산의 두 피연산자의 차원이 동일해야 합니다. 따라서 길이가 n인 벡터에 (m, n) 모양 행렬을 추가할 수 없습니다. 브로드캐스팅은 각 열 아래에 동일한 값을 복제하여 길이가 n인 벡터를 (m, n) 모양 행렬로 가상 확장함으로써 이 연산을 가능하게 합니다.

자세한 내용은 다음 NumPy의 브로드캐스팅 설명을 참고하세요.

버킷팅,

하나의 특성을 버킷 또는 빈이라고 하는 다중 이진 특성으로 변환하는 작업으로서, 일반적으로 값 범위를 기준으로 합니다. 잘린 특성은 일반적으로 연속 특성입니다.

예를 들어 온도를 단일 연속 부동 소수점 특성으로 표현하는 대신 온도 범위를 다음과 같은 불연속 버킷으로 나눌 수 있습니다.

- 섭씨 10도 이하가 '차가운' 버킷입니다.

- 11~24도는 '온대' 버킷에 해당합니다.

- 섭씨 25도 이상은 '따뜻함' 버킷이 됩니다.

모델은 동일한 버킷의 모든 값을 동일하게 취급합니다. 예를 들어 13와 22 값은 모두 온대 버킷에 있으므로 모델은 두 값을 동일하게 취급합니다.

자세한 내용은 머신러닝 단기집중과정의 숫자 데이터: 구간화를 참고하세요.

C

보정 레이어

일반적으로 예측 편향을 보정하기 위한 예측 후 조정입니다. 조정된 예측 및 확률은 관찰된 라벨 집합의 분포와 일치해야 합니다.

후보군 생성

추천 시스템에서 선택되는 일련의 초기 추천입니다. 예를 들어, 10만 권의 서적을 판매하는 서점이 있다고 가정합니다. 후보군 생성 단계에서는 특정 사용자에게 추천할 적은 수(예: 500권)의 도서 목록을 만듭니다. 하지만 500권도 사용자에게 추천하기에는 너무 많습니다. 추천 시스템의 후속 단계 (예: 점수 매기기 및 재정렬)에서는 도서 수를 500권보다 훨씬 줄여 추천을 더 유용하게 만듭니다.

자세한 내용은 추천 시스템 과정의 후보 생성 개요를 참고하세요.

후보 샘플링

학습 도중 소프트맥스 등을 사용하여 모든 긍정 라벨의 확률을 계산하는 최적화입니다. 부정 라벨의 경우 무작위 샘플에 대해서만 계산합니다. 예를 들어 라벨이 beagle 및 dog인 예가 있으면 후보 샘플링에서 다음 항목에 대해 예측되는 확률과 해당 손실 항을 계산합니다.

- beagle

- dog

- 나머지 부정 클래스의 임의 하위 집합 (예: 고양이, 사탕, 울타리)

포지티브 클래스가 항상 적절한 포지티브 강화를 받는 한 네거티브 클래스는 빈도가 적은 네거티브 강화로부터 학습할 수 있기 때문이며, 이는 실제로 경험적으로 관찰되는 사실입니다.

후보 샘플링은 특히 음성 클래스 수가 매우 많은 경우 모든 음성 클래스에 대한 예측을 계산하는 학습 알고리즘보다 컴퓨팅 효율성이 높습니다.

범주형 데이터

가능한 값의 특정 집합을 갖는 특성입니다. 예를 들어 다음 세 가지 값 중 하나만 가질 수 있는 traffic-light-state이라는 범주형 특성을 생각해 보겠습니다.

redyellowgreen

traffic-light-state를 범주형 특성으로 표현하면 모델이 운전자 행동에 대한 red, green, yellow의 서로 다른 영향을 학습할 수 있습니다.

범주형 특성을 불연속 특성이라고도 합니다.

수치 데이터와 대비되는 개념입니다.

자세한 내용은 머신러닝 단기집중과정의 범주형 데이터 작업을 참고하세요.

인과 관계 언어 모델

단방향 언어 모델의 동의어입니다.

언어 모델링에서 다양한 방향성 접근 방식을 비교하려면 양방향 언어 모델을 참고하세요.

centroid

k-평균 또는 k-중앙값 알고리즘에 의해 결정된 클러스터의 중심입니다. 예를 들어 k가 3인 경우 k-평균 또는 k-중앙값 알고리즘에서는 3개의 중심을 찾아냅니다.

자세한 내용은 클러스터링 과정의 클러스터링 알고리즘을 참고하세요.

중심 기반 군집화

데이터를 비계층적 클러스터로 구성하는 클러스터링 알고리즘의 카테고리입니다. k-평균은 가장 널리 사용되는 중심 기반 클러스터링 알고리즘입니다.

계층적 클러스터링 알고리즘과 대조해보세요.

자세한 내용은 클러스터링 과정의 클러스터링 알고리즘을 참고하세요.

연쇄적 사고(CoT) 프롬프팅

대규모 언어 모델 (LLM)이 추론을 단계별로 설명하도록 유도하는 프롬프트 엔지니어링 기법입니다. 예를 들어 다음 프롬프트를 살펴보세요. 특히 두 번째 문장에 주의하세요.

7초 만에 0에서 60마일로 이동하는 자동차의 운전자는 몇 g의 힘을 경험할까요? 답변에 관련된 모든 계산을 표시합니다.

LLM의 대답은 다음과 같을 수 있습니다.

- 적절한 위치에 값 0, 60, 7을 대입하여 물리학 공식의 순서를 보여 줘.

- 이러한 공식을 선택한 이유와 다양한 변수의 의미를 설명합니다.

연쇄적 사고(CoT) 프롬프팅은 LLM이 모든 계산을 수행하도록 강제하므로 더 정확한 답변을 얻을 수 있습니다. 또한 사고의 연쇄 프롬프트를 사용하면 사용자가 LLM의 단계를 검토하여 답변이 타당한지 확인할 수 있습니다.

문자 N-그램 F-점수 (ChrF)

기계 번역 모델을 평가하는 측정항목입니다. 문자 N-그램 F 점수는 참조 텍스트의 N-그램이 ML 모델의 생성된 텍스트의 N-그램과 얼마나 중복되는지 결정합니다.

문자 N-그램 F 점수는 다음과 같은 점을 제외하고 ROUGE 및 BLEU 계열의 측정항목과 유사합니다.

- 문자 N-그램 F 점수는 문자 N-그램에서 작동합니다.

- ROUGE와 BLEU는 단어 N-그램 또는 토큰을 기반으로 작동합니다.

채팅

ML 시스템(일반적으로 대규모 언어 모델)과의 대화 내용입니다. 채팅의 이전 상호작용(내가 입력한 내용과 대규모 언어 모델이 응답한 방식)은 채팅의 후속 부분에 대한 맥락이 됩니다.

챗봇은 대규모 언어 모델의 애플리케이션입니다.

체크포인트

학습 중 또는 학습이 완료된 후에 모델의 파라미터 상태를 캡처하는 데이터입니다. 예를 들어 학습 중에 다음 작업을 할 수 있습니다.

- 의도적으로 또는 특정 오류의 결과로 학습을 중지합니다.

- 체크포인트를 캡처합니다.

- 나중에 다른 하드웨어에서 체크포인트를 새로고침합니다.

- 학습을 다시 시작합니다.

클래스

라벨이 속할 수 있는 카테고리입니다. 예를 들면 다음과 같습니다.

분류 모델은 클래스를 예측합니다. 반면 회귀 모델은 클래스가 아닌 숫자를 예측합니다.

자세한 내용은 머신러닝 단기집중과정의 분류를 참고하세요.

클래스 균형 데이터 세트

각 카테고리의 인스턴스 수가 거의 동일한 범주형 라벨이 포함된 데이터 세트 예를 들어 이진 라벨이 자생 식물 또는 외래 식물일 수 있는 식물 데이터 세트를 생각해 보겠습니다.

- 자생 식물이 515개이고 외래 식물이 485개인 데이터 세트는 클래스 균형 데이터 세트입니다.

- 자생 식물이 875개이고 비자생 식물이 125개인 데이터 세트는 클래스 불균형 데이터 세트입니다.

클래스 균형 데이터 세트와 클래스 불균형 데이터 세트 간의 공식적인 구분선은 없습니다. 클래스 불균형이 심한 데이터 세트로 학습된 모델이 수렴할 수 없는 경우에만 이 구분이 중요해집니다. 자세한 내용은 머신러닝 단기집중과정의 데이터 세트: 불균형 데이터 세트를 참고하세요.

분류 모델

예측이 클래스인 모델입니다. 예를 들어 다음은 모두 분류 모델입니다.

- 입력 문장의 언어 (프랑스어? 스페인어? 이탈리아어?)

- 나무 종(단풍나무? 오크? 바오밥?).

- 특정 질병의 양성 또는 음성 클래스를 예측하는 모델입니다.

반면 회귀 모델은 클래스가 아닌 숫자를 예측합니다.

일반적인 분류 모델에는 다음 두 가지 유형이 있습니다.

분류 기준점

이진 분류에서 로지스틱 회귀 모델의 원시 출력을 양성 클래스 또는 음성 클래스 예측으로 변환하는 0과 1 사이의 숫자입니다. 분류 기준은 모델 학습에서 선택한 값이 아니라 사람이 선택한 값입니다.

로지스틱 회귀 모델은 0과 1 사이의 원시 값을 출력합니다. 그런 다음 아래를 실행합니다.

- 이 원시 값이 분류 기준보다 크면 포지티브 클래스가 예측됩니다.

- 이 원시 값이 분류 임계값보다 작으면 부정 클래스가 예측됩니다.

예를 들어 분류 임곗값이 0.8이라고 가정해 보겠습니다. 원시 값이 0.9이면 모델은 포지티브 클래스를 예측합니다. 원시 값이 0.7이면 모델은 네거티브 클래스를 예측합니다.

분류 기준점 선택은 거짓양성 및 거짓음성 수에 큰 영향을 미칩니다.

자세한 내용은 머신러닝 단기집중과정의 기준점 및 혼동 행렬을 참고하세요.

분류기

분류 모델의 비공식 용어입니다.

클래스 불균형 데이터 세트

각 클래스의 총 라벨 수가 크게 다른 분류의 데이터 세트 예를 들어 두 라벨이 다음과 같이 나뉘는 이진 분류 데이터 세트를 생각해 보겠습니다.

- 1,000,000개의 음수 값 표시 라벨

- 긍정적인 라벨 10개

부정적 라벨과 긍정적 라벨의 비율이 100,000:1이므로 클래스 불균형 데이터 세트입니다.

이와 대조적으로 다음 데이터 세트는 음수 레이블과 양수 레이블의 비율이 비교적 1에 가깝기 때문에 클래스 균형입니다.

- 517개의 부정적인 라벨

- 483개의 긍정적 라벨

다중 클래스 데이터 세트도 클래스 불균형일 수 있습니다. 예를 들어 다음 다중 클래스 분류 데이터 세트는 한 라벨에 다른 두 라벨보다 훨씬 많은 예가 있으므로 클래스 불균형이기도 합니다.

- 클래스가 'green'인 라벨 1,000,000개

- 클래스가 'purple'인 라벨 200개

- 'orange' 클래스가 있는 라벨 350개

클래스 불균형 데이터 세트를 학습하는 데는 특별한 문제가 있을 수 있습니다. 자세한 내용은 머신러닝 단기집중과정의 불균형 데이터 세트를 참고하세요.

클리핑

다음 중 하나 또는 둘 다를 실행하여 이상치를 처리하는 기술입니다.

- 최대 기준점보다 큰 특성 값을 해당 최대 기준점으로 줄입니다.

- 최소 기준점보다 작은 특성 값을 해당 최소 기준점까지 늘립니다.

예를 들어 특정 특성의 값 중 0.5% 미만이 40~60 범위를 벗어난다고 가정합니다. 이 경우 다음과 같이 할 수 있습니다.

- 60 (최대 기준점)을 초과하는 모든 값을 정확히 60으로 자릅니다.

- 40 (최소 기준점) 미만인 모든 값을 정확히 40으로 자릅니다.

이상치는 모델을 손상시켜 학습 중에 가중치가 오버플로되는 경우가 있습니다. 일부 이상치는 정확도와 같은 측정항목을 크게 망칠 수도 있습니다. 클리핑은 손상을 제한하는 일반적인 기법입니다.

경사 제한은 학습 중에 지정된 범위 이내의 경사 값을 강제 적용합니다.

자세한 내용은 머신러닝 단기집중과정의 숫자 데이터: 정규화를 참고하세요.

Cloud TPU

Google Cloud에서 머신러닝 워크로드 속도를 높이도록 설계된 특수 하드웨어 가속기입니다.

클러스터링

특히 비지도 학습 중에 관련 예를 그룹화합니다. 모든 예가 그룹으로 묶이고 나면 사람이 선택적으로 각 클러스터에 의미를 부여할 수 있습니다.

클러스터링에는 여러 가지 알고리즘이 사용됩니다. 예를 들어 k-평균 알고리즘은 다음 다이어그램과 같이 중심과의 근접성을 기반으로 예시를 클러스터링합니다.

그러면 인간 연구자가 클러스터를 검토하여 예를 들어 클러스터 1을 "왜소 나무"로, 클러스터 2를 "전체 크기 나무"로 분류할 수 있습니다.

다음에서 확인할 수 있는 것처럼 중심점에서 예가 얼마나 떨어져 있는지를 바탕으로 한 클러스터링 알고리즘도 있을 수 있습니다.

자세한 내용은 클러스터링 과정을 참고하세요.

모방 적응

뉴런이 네트워크 전체의 동작에 의존하지 않고 특정 다른 뉴런의 출력에만 거의 전적으로 의존하여 학습 데이터의 패턴을 예측하는 바람직하지 않은 동작입니다. 공동 적응을 유발하는 패턴이 검증 데이터에 없는 경우 공동 적응으로 인해 과적합이 발생합니다. 드롭아웃 정규화는 드롭아웃을 통해 뉴런이 다른 특정 뉴런에만 의존할 수 없도록 하여 공동 적응을 줄입니다.

협업 필터링

다른 여러 사용자의 관심사를 기준으로 특정 사용자의 관심 항목에 관한 예측을 수행합니다. 협업 필터링은 추천 시스템에 자주 사용됩니다.

자세한 내용은 추천 시스템 과정의 협업 필터링을 참조하세요.

컴팩트 모델

제한된 계산 리소스를 갖춘 소형 장치에서 실행되도록 설계된 모든 소형 모델입니다. 예를 들어, 컴팩트 모델은 모바일폰, 태블릿 또는 임베디드 시스템에서 실행될 수 있습니다.

컴퓨팅

(명사) 모델 또는 시스템에서 사용하는 컴퓨팅 리소스(예: 처리 능력, 메모리, 스토리지)입니다.

가속기 칩을 참고하세요.

개념 드리프트

특성과 라벨 간의 관계가 변경됩니다. 시간이 지남에 따라 개념 드리프트로 인해 모델의 품질이 저하됩니다.

학습하는 동안 모델은 학습 세트의 특성과 레이블 간의 관계를 학습합니다. 학습 세트의 라벨이 실제 세계를 잘 나타내는 경우 모델은 실제 세계를 잘 예측해야 합니다. 하지만 개념 드리프트로 인해 모델의 예측은 시간이 지남에 따라 저하되는 경향이 있습니다.

예를 들어 특정 자동차 모델이 '연비가 좋은지'를 예측하는 이진 분류 모델을 생각해 보세요. 즉, 기능은 다음과 같을 수 있습니다.

- 차량 무게

- 엔진 압축

- 변속기 유형

라벨은 다음 중 하나입니다.

- 연비가 좋은

- 연료 효율이 좋지 않다

하지만 '연비가 좋은 자동차'의 개념은 계속해서 바뀌고 있습니다. 1994년에 연비가 좋은 것으로 표시된 자동차 모델은 2024년에는 거의 확실히 연비가 좋지 않은 것으로 표시될 것입니다. 개념 드리프트가 발생하는 모델은 시간이 지날수록 유용한 예측을 점점 더 적게 하는 경향이 있습니다.

비정상성과 비교하고 대조해 보세요.

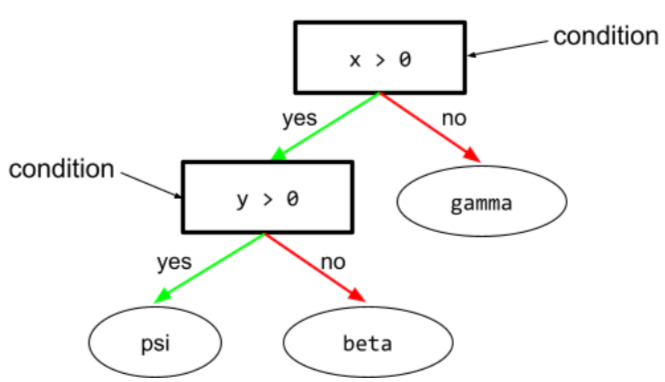

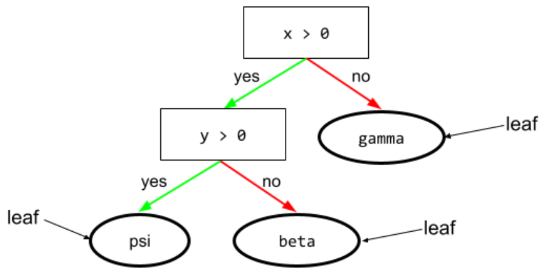

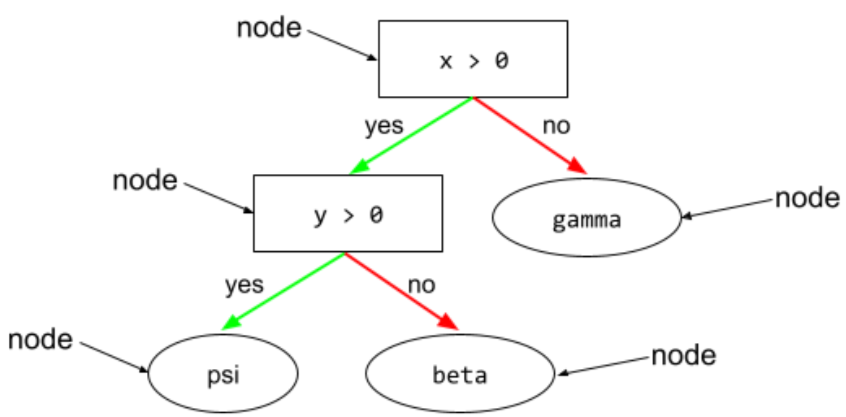

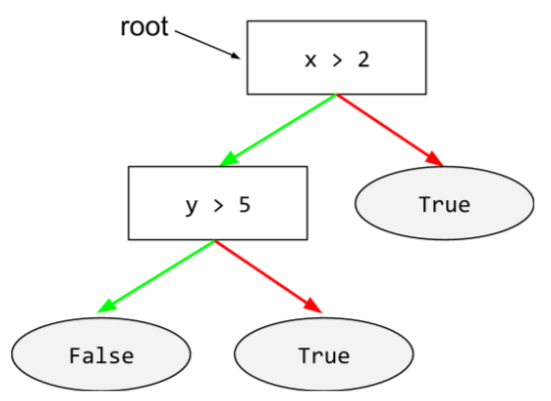

조건

의사결정 트리에서는 테스트를 수행하는 모든 노드입니다. 예를 들어 다음 결정 트리에는 두 가지 조건이 포함되어 있습니다.

조건을 분할 또는 테스트라고도 합니다.

leaf와 대조되는 조건입니다.

관련 주제에 대한 추가 정보

자세한 내용은 결정 트리 과정의 조건 유형을 참고하세요.

간담

환각의 동의어입니다.

환각보다는 '공감'이라는 용어가 기술적으로 더 정확할 것이다. 하지만 환각이 먼저 인기를 얻었습니다.

구성

모델을 학습하는 데 사용되는 초기 속성 값을 할당하는 프로세스입니다. 여기에는 다음이 포함됩니다.

머신러닝 프로젝트에서는 특수 구성 파일을 통해 또는 다음과 같은 구성 라이브러리를 사용하여 구성을 실행할 수 있습니다.

확증 편향

기존의 믿음이나 가설을 확인하는 방식으로 정보를 검색, 해석, 선호, 회상하는 경향입니다. 머신러닝 개발자가 의도치 않게 기존 믿음을 뒷받침하는 결과에 영향을 미치는 방식으로 데이터를 수집하거나 데이터에 라벨을 지정할 수 있습니다. 확증 편향은 일종의 내재적 편향입니다.

실험자 편향은 실험자가 기존 가설이 확인될 때까지 모델 학습을 계속하는 확인 편향의 한 형태입니다.

혼동 행렬

분류 모델이 수행한 올바른 예측과 잘못된 예측의 수를 요약한 NxN 표입니다. 예를 들어 이진 분류 모델의 다음 혼동 행렬을 고려해 보세요.

| 종양 (예상) | 종양이 아님 (예측) | |

|---|---|---|

| 종양 (정답) | 18 (티피) | 1 (FN) |

| 종양이 아님 (정답) | 6 (FP) | 452 (TN) |

위의 혼동 행렬은 다음을 보여줍니다.

- 그라운드 트루스가 종양인 19개의 예측 중 모델이 18개를 올바르게 분류하고 1개를 잘못 분류했습니다.

- 그라운드 트루스가 Non-Tumor인 458개의 예측 중 모델이 452개를 올바르게 분류하고 6개를 잘못 분류했습니다.

다중 클래스 분류 문제의 혼동 행렬은 실수 패턴을 식별하는 데 도움이 될 수 있습니다. 예를 들어 세 가지 다른 붓꽃 유형(버지니카, 버시컬러, 세토사)을 분류하는 3개 클래스 다중 클래스 분류 모델의 다음 혼동 행렬을 고려해 보세요. 실측 정보가 Virginica인 경우 혼동 행렬을 보면 모델이 Setosa보다 Versicolor를 잘못 예측할 가능성이 훨씬 더 높습니다.

| Setosa (예측) | Versicolor (예측) | Virginica (예측) | |

|---|---|---|---|

| Setosa (정답) | 88 | 12 | 0 |

| Versicolor (정답) | 6 | 141 | 7 |

| Virginica (정답) | 2 | 27 | 109 |

또 다른 예로, 혼동 행렬은 필기 숫자를 인식하도록 학습된 모델이 4를 9로, 아니면 7을 1로 잘못 예측하는 경향이 있음을 드러낼 수 있습니다.

혼동 행렬에는 정밀도 및 재현율을 비롯한 다양한 성능 측정항목을 계산하기에 충분한 정보가 포함되어 있습니다.

구성요소 파싱

문장을 더 작은 문법 구조 ('구성요소')로 나눕니다. 자연어 이해 모델과 같은 ML 시스템의 후반부에서는 원래 문장보다 구성요소를 더 쉽게 파싱할 수 있습니다. 예를 들어 다음 문장을 살펴보겠습니다.

내 친구가 고양이 두 마리를 입양했어.

구성요소 파서는 이 문장을 다음 두 구성요소로 나눌 수 있습니다.

- 내 친구는 명사구입니다.

- adopted two cats는 동사구입니다.

이러한 구성요소는 더 작은 구성요소로 세분화할 수 있습니다. 예를 들어 동사구

고양이 두 마리를 입양했습니다.

다음과 같이 더 세분화할 수 있습니다.

- 채택됨은 동사입니다.

- two cats는 또 다른 명사구입니다.

문맥화된 언어 임베딩

유창한 인간 화자가 단어와 구문을 이해하는 방식과 유사하게 단어와 구문을 '이해'하는 임베딩 컨텍스트화된 언어 임베딩은 복잡한 구문, 시맨틱, 컨텍스트를 이해할 수 있습니다.

예를 들어 영어 단어 cow의 임베딩을 생각해 보세요. word2vec과 같은 이전 삽입은 소에서 황소까지의 삽입 공간의 거리가 암양에서 수양까지 또는 여성에서 남성까지의 거리와 유사하도록 영어 단어를 표현할 수 있습니다. 문맥화된 언어 삽입은 영어 사용자가 때때로 cow라는 단어를 암소 또는 수소라는 의미로 무심코 사용하는 것을 인식하여 한 단계 더 나아갈 수 있습니다.

컨텍스트 윈도우

모델이 특정 프롬프트에서 처리할 수 있는 토큰 수입니다. 컨텍스트 윈도우가 클수록 모델은 더 많은 정보를 사용하여 프롬프트에 일관되고 논리적인 대답을 제공할 수 있습니다.

연속 특성

온도나 무게와 같이 가능한 값의 범위가 무한한 부동 소수점 특성입니다.

불연속 특성과 대비되는 개념입니다.

편의 샘플링

실험을 빠르게 실행하기 위해 과학적으로 수집되지 않은 데이터 세트를 사용합니다. 나중에 과학적으로 수집된 데이터 세트로 전환해야 합니다.

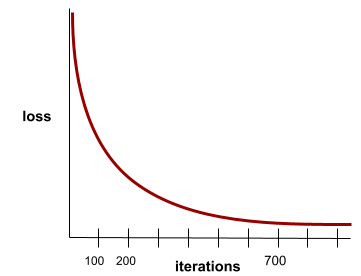

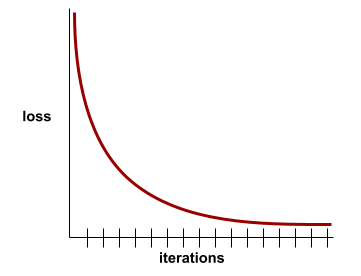

수렴

반복마다 손실 값이 거의 또는 전혀 변화하지 않는 상태입니다. 예를 들어 다음 손실 곡선은 약 700회 반복에서 수렴을 보여줍니다.

추가 학습으로 모델이 개선되지 않으면 모델이 수렴됩니다.

딥 러닝에서는 손실 값이 최종적으로 감소하기 전에 여러 반복 동안 일정하거나 거의 일정하게 유지되는 경우가 있습니다. 손실 값이 일정하게 유지되는 기간이 길어지면 일시적으로 수렴이 이루어진 것처럼 느껴질 수 있습니다.

조기 중단도 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 모델 수렴 및 손실 곡선을 참고하세요.

대화형 코딩

소프트웨어를 만들기 위해 사용자와 생성형 AI 모델 간에 이루어지는 반복적인 대화입니다. 소프트웨어를 설명하는 프롬프트를 입력합니다. 그런 다음 모델은 이 설명을 사용하여 코드를 생성합니다. 그런 다음 이전 프롬프트 또는 생성된 코드의 결함을 해결하기 위해 새 프롬프트를 발행하면 모델에서 업데이트된 코드를 생성합니다. 생성된 소프트웨어가 충분히 만족스러울 때까지 두 사람이 계속해서 왔다 갔다 합니다.

대화 코딩은 본질적으로 분위기 코딩의 원래 의미입니다.

명시적 코딩과 대비되는 개념입니다.

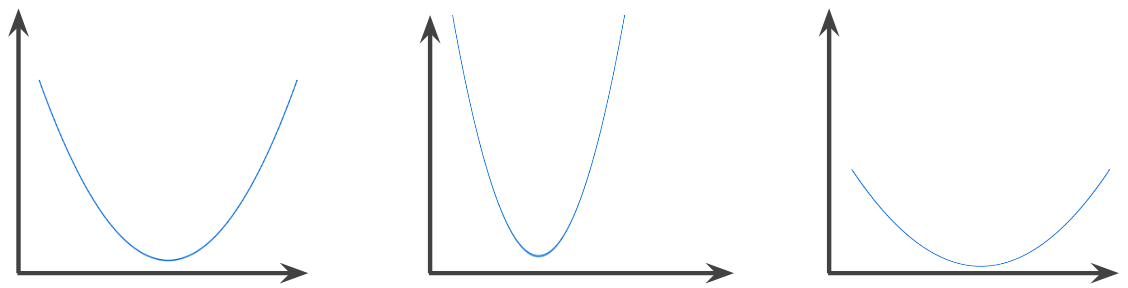

볼록 함수

함수 그래프의 위쪽 영역이 볼록 집합인 함수입니다. 전형적인 볼록 함수는 U자 모양입니다. 예를 들어 다음은 모두 볼록 함수입니다.

반면 다음 함수는 볼록하지 않습니다. 그래프 위의 영역이 볼록 집합이 아닌 것을 확인하세요.

순볼록 함수에는 지역 최솟값 점이 하나만 있으며, 이는 전역 최솟값 점이기도 합니다. 고전적인 U자형 함수는 순볼록 함수입니다. 그러나 직선과 같은 볼록 함수는 U자형이 아닙니다.

자세한 내용은 머신러닝 단기집중과정의 수렴 및 볼록 함수를 참고하세요.

볼록 최적화

경사하강법과 같은 수학적 기법을 사용하여 볼록 함수의 최솟값을 찾는 프로세스입니다. 머신러닝에 대한 연구 중 상당한 비중이 볼록 최적화와 같은 다양한 문제를 고안하고 효과적인 해법을 찾는 데 집중되었습니다.

자세한 내용은 Boyd와 Vandenberghe의 볼록 최적화를 참고하세요.

볼록 집합

부분 집합의 두 점 사이에 그려진 선이 부분 집합 내에 완전히 유지되는 유클리드 공간의 부분 집합입니다. 예를 들어 다음 두 도형은 볼록 집합입니다.

반면 다음 두 도형은 볼록 집합이 아닙니다.

컨볼루션

수학에서 두 함수의 혼합을 비공식적으로 말합니다. 머신러닝에서 컨볼루션은 컨볼루셔널 필터와 입력 행렬을 혼합하여 가중치를 학습시킵니다.

머신러닝에서 '컨볼루션'이라는 용어는 컨볼루션 연산 또는 컨볼루션 레이어를 지칭하는 약칭인 경우가 많습니다.

컨볼루션이 없으면 머신러닝 알고리즘이 큰 텐서의 모든 셀에 있어서 별도의 가중치를 학습해야 합니다. 예를 들어 2K x 2K 이미지로 학습하는 머신러닝 알고리즘은 4백만 개의 별도 가중치를 찾아야 합니다. 컨볼루션이 있기 때문에 머신러닝 알고리즘은 컨볼루셔널 필터에 있는 모든 셀의 가중치만 찾아도 되고, 이로 인해 모델 학습에 필요한 메모리가 크게 줄어듭니다. 컨볼루션 필터가 적용되면 각 셀에 필터가 곱해지도록 셀 전체에 간단히 복제됩니다.

자세한 내용은 이미지 분류 과정의 컨볼루션 신경망 소개를 참고하세요.

컨볼루션 필터

컨볼루셔널 연산에서 사용되는 두 가지 중 하나입니다. (다른 행위자는 입력 행렬의 슬라이스입니다.) 컨볼루셔널 필터는 입력 행렬과 순위는 동일하지만 모양은 더 작은 행렬입니다. 예를 들어 28x28 입력 행렬이 주어지면 필터는 28x28보다 작은 2D 행렬일 수 있습니다.

사진 조작에서 컨볼루션 필터의 모든 셀은 일반적으로 1과 0의 상수 패턴으로 설정됩니다. 머신러닝에서 컨볼루션 필터는 일반적으로 난수로 시드된 후 네트워크가 이상적인 값을 학습합니다.

자세한 내용은 이미지 분류 과정의 컨볼루션을 참고하세요.

컨볼루션 레이어

심층 신경망의 한 레이어로, 입력 행렬에 컨볼루셔널 필터를 적용합니다. 예를 들어 다음과 같은 3x3 컨볼루셔널 필터가 있다고 생각해 보세요.

![값이 [[0,1,0], [1,0,1], [0,1,0]]인 3x3 행렬](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalFilter33.svg?authuser=3&hl=ko)

다음 애니메이션은 5x5 입력 행렬을 포함하는 9개의 컨볼루션 연산으로 구성된 컨볼루션 레이어를 보여줍니다. 각 컨볼루션 연산은 입력 행렬의 서로 다른 3x3 슬라이스에서 작동합니다. 결과로 생성된 3x3 행렬 (오른쪽)은 9개의 컨볼루셔널 연산 결과로 구성됩니다.

![두 개의 매트릭스를 보여주는 애니메이션 첫 번째 행렬은 5x5 행렬 [[128,97,53,201,198], [35,22,25,200,195], [37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]]입니다.

두 번째 행렬은 3x3 행렬 [[181,303,618], [115,338,605], [169,351,560]]입니다.

두 번째 행렬은 5x5 행렬의 다양한 3x3 하위 집합에 컨볼루션 필터 [[0, 1, 0], [1, 0, 1], [0, 1, 0]] 을 적용하여 계산됩니다.](https://developers.google.com/static/machine-learning/glossary/images/AnimatedConvolution.gif?authuser=3&hl=ko)

자세한 내용은 이미지 분류 과정의 완전 연결 계층을 참고하세요.

컨볼루셔널 신경망

하나 이상의 레이어가 컨볼루셔널 레이어인 신경망입니다. 일반적인 컨볼루션 신경망은 다음 레이어의 조합으로 구성됩니다.

컨볼루션 신경망은 이미지 인식과 같은 특정 종류의 문제에서 큰 성공을 거두었습니다.

컨볼루셔널 연산

컨볼루셔널 연산은 다음과 같은 2단계 수학 연산입니다.

- 컨볼루셔널 필터 및 입력 행렬의 슬라이스 등 요소별 곱셈입니다. 입력 행렬의 슬라이스는 컨볼루셔널 필터와 순위 및 크기가 동일합니다.

- 곱셈의 결과로 얻어지는 행렬 내 모든 값의 합계입니다.

예를 들어 다음 5x5 입력 행렬을 고려해 보세요.

![5x5 행렬: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]]](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerInputMatrix.svg?authuser=3&hl=ko)

이제 다음 2x2 컨볼루셔널 필터를 생각해 보세요.

![2x2 행렬: [[1, 0], [0, 1]]](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerFilter.svg?authuser=3&hl=ko)

각 컨볼루셔널 연산에는 입력 행렬의 단일 2x2 슬라이스가 포함됩니다. 예를 들어 입력 행렬의 왼쪽 상단에 있는 2x2 슬라이스를 사용한다고 가정해 보겠습니다. 따라서 이 슬라이스의 컨볼루션 연산은 다음과 같습니다.

![입력 행렬의 왼쪽 상단 2x2 섹션인 [[128,97], [35,22]] 에 컨볼루션 필터 [[1, 0], [0, 1]]을 적용합니다.

컨볼루션 필터는 128과 22는 그대로 두지만 97과 35는 0으로 만듭니다. 따라서 컨볼루션 연산은 값 150 (128+22)을 생성합니다.](https://developers.google.com/static/machine-learning/glossary/images/ConvolutionalLayerOperation.svg?authuser=3&hl=ko)

컨볼루셔널 레이어는 일련의 컨볼루셔널 연산으로 이루어지며, 각 연산은 입력 행렬의 서로 다른 슬라이스에 적용됩니다.

비용

손실의 동의어입니다.

공동 학습

다음 조건이 모두 충족되는 경우 특히 유용한 준지도 학습 접근 방식

- 데이터 세트에서 라벨이 없는 예의 비율이 라벨이 지정된 예에 비해 높습니다.

- 이는 분류 문제입니다 (이진 또는 다중 클래스).

- 데이터 세트에는 서로 독립적이고 상호 보완적인 두 가지 예측 기능 세트가 포함되어 있습니다.

공동 학습은 기본적으로 독립적인 신호를 더 강력한 신호로 증폭합니다. 예를 들어 개별 중고차를 양호 또는 불량으로 분류하는 분류 모델을 생각해 보겠습니다. 한 세트의 예측 기능은 자동차의 연도, 제조업체, 모델과 같은 집계된 특성에 중점을 둘 수 있고, 다른 세트의 예측 기능은 이전 소유자의 운전 기록과 자동차의 유지보수 기록에 중점을 둘 수 있습니다.

공동 학습에 관한 획기적인 논문은 Blum과 Mitchell의 Combining Labeled and Unlabeled Data with Co-Training입니다.

반사실적 공정성

민감한 속성 하나 이상을 제외하고 첫 번째 사용자와 동일한 다른 사용자에 대해 분류 모델이 동일한 결과를 생성하는지 확인하는 공정성 측정항목입니다. 반사실적 공정성을 위해 분류 모델을 평가하는 것은 모델에서 잠재적인 편향 소스를 파악하는 한 가지 방법입니다.

자세한 내용은 다음 중 하나를 참고하세요.

- 머신러닝 단기집중과정의 공정성: 반사실적 공정성

- When Worlds Collide: Integrating Different Counterfactual Assumptions in Fairness

포함 편향

표본 선택 편향을 참고하세요.

중의적 구문

의미가 모호한 문장 또는 구입니다. 중의적 구문은 자연어 이해에서 중요한 문제를 발생시킵니다. 예를 들어 Red Tape Holds Up Skyscraper라는 광고 제목은 NLU 모델에서 광고 제목을 문자 그대로 또는 비유적으로 해석할 수 있으므로 중의적 구문입니다.

비평가

Deep Q-Network의 동의어입니다.

교차 엔트로피

로그 손실을 다중 클래스 분류 문제로 일반화한 것입니다. 교차 엔트로피는 두 확률 분포 간의 차이를 계량합니다. 퍼플렉시티도 참고하세요.

교차 검증

학습 세트에서 보류된 하나 이상의 중복되지 않은 데이터 하위 집합을 테스트하여 모델이 새 데이터로 얼마나 효과적으로 일반화될지를 예측하는 메커니즘입니다.

누적 분포 함수 (CDF)

타겟 값 이하의 샘플 빈도를 정의하는 함수입니다. 예를 들어 연속 값의 정규 분포를 생각해 보세요. CDF는 샘플의 약 50% 가 평균 이하이고 샘플의 약 84% 가 평균보다 1표준편차 이상임을 나타냅니다.

D

데이터 분석

데이터 분석이란 샘플, 측정치, 시각화를 고려하여 데이터를 이해하는 작업입니다. 처음으로 데이터 세트를 받은 직후, 첫 번째 모델을 빌드하기 전에 특히 데이터 분석이 유용합니다. 또한 실험을 이해하고 시스템의 문제를 디버깅하는 데에도 중요합니다.

데이터 증강

기존 예를 변형하여 추가 예시를 생성함으로써 학습 예시의 범위와 수를 인위적으로 늘립니다. 예를 들어 이미지가 특성 중 하나이지만, 모델에서 유용한 연결을 학습하는 데 충분한 이미지 예가 데이터 세트에 포함되어 있지 않다고 가정합니다. 모델이 올바르게 학습할 수 있도록 데이터 세트에 라벨이 지정된 이미지를 충분히 추가하는 것이 가장 좋습니다. 그렇게 할 수 없는 경우 데이터 증강을 통해 각 이미지를 회전, 확대, 반사하여 원본 그림의 다양한 변형을 생성할 수 있습니다. 그러면 충분한 수의 라벨이 지정된 데이터가 생성되어 효과적인 학습을 지원할 수 있습니다.

DataFrame

메모리에서 데이터 세트를 표현하는 데 널리 사용되는 pandas 데이터 유형입니다.

DataFrame은 테이블이나 스프레드시트와 비슷합니다. DataFrame의 각 열에는 이름 (헤더)이 있으며 각 행은 고유한 숫자로 식별됩니다.

DataFrame의 각 열은 2D 배열처럼 구성되지만 각 열에 고유한 데이터 유형을 할당할 수 있다는 점이 다릅니다.

공식 pandas.DataFrame 참조 페이지도 참조하세요.

데이터 동시 로드

학습 또는 추론을 확장하는 방법으로, 전체 모델을 여러 기기에 복제한 다음 입력 데이터의 하위 집합을 각 기기에 전달합니다. 데이터 동시 로드를 사용하면 매우 큰 배치 크기에 대한 학습 및 추론을 실행할 수 있습니다. 하지만 데이터 동시 로드를 사용하려면 모델이 모든 기기에 맞을 만큼 소형이어야 합니다.

데이터 동시 로드는 일반적으로 학습 및 추론 속도를 높입니다.

모델 병렬 처리도 참고하세요.

Dataset API (tf.data)

데이터를 읽고 머신러닝 알고리즘이 요구하는 형태로 변환하는 상위 수준의 TensorFlow API입니다.

tf.data.Dataset 객체는 요소 시퀀스를 나타내며, 각 요소는 하나 이상의 텐서를 포함합니다. tf.data.Iterator 객체를 사용하면 Dataset의 요소에 액세스할 수 있습니다.

데이터 세트(data set 또는 dataset)

일반적으로 다음 형식 중 하나로 구성되지만 이에 국한되지는 않는 원시 데이터 모음입니다.

- 스프레드시트

- CSV (쉼표로 구분된 값) 형식의 파일

결정 경계

이진 클래스 또는 다중 클래스 분류 문제에서 모델이 학습한 클래스 간의 구분자입니다. 예를 들어 아래 그림과 같은 이진 분류 문제의 경우 결정 경계는 주황색 클래스와 파란색 클래스 사이의 경계선입니다.

결정 포레스트

여러 결정 트리로 생성된 모델입니다. 결정 포레스트는 결정 트리의 예측을 집계하여 예측합니다. 인기 있는 결정 트리 유형에는 랜덤 포레스트와 그래디언트 부스티드 트리가 있습니다.

자세한 내용은 Decision Forests 과정의 Decision Forests 섹션을 참조하세요.

결정 기준

분류 임곗값의 동의어입니다.

결정 트리

계층적으로 구성된 일련의 조건과 리프로 구성된 지도 학습 모델입니다. 예를 들어 다음은 의사 결정 트리입니다.

decoder

일반적으로 처리된, 밀집된 또는 내부 표현을 더 원시적이고 희소하거나 외부 표현으로 변환하는 모든 ML 시스템입니다.

디코더는 더 큰 모델의 구성요소인 경우가 많으며, 여기서 디코더는 인코더와 자주 페어링됩니다.

시퀀스-투-시퀀스(Seq2Seq) 태스크에서 디코더는 인코더가 생성한 내부 상태로 시작하여 다음 시퀀스를 예측합니다.

트랜스포머 아키텍처 내 디코더의 정의는 트랜스포머를 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 대규모 언어 모델을 참고하세요.

심층 모델

심층 모델을 심층신경망이라고도 합니다.

와이드 모델과 대조해보세요.

심층신경망

심층 모델의 동의어입니다.

Deep Q-Network (DQN)

Q-러닝에서는 Q-함수를 예측하는 심층 신경망을 사용합니다.

Critic은 Deep Q-Network의 동의어입니다.

인구통계 동등성

모델 분류 결과가 주어진 민감한 속성에 종속되지 않는 경우 충족되는 공정성 지표입니다.

예를 들어 소인국인과 거인국인이 모두 글럽덥드립 대학에 지원하는 경우, 한 그룹이 다른 그룹보다 평균적으로 자격 요건을 더 충족하는지 여부와 관계없이 입학한 소인국인의 비율이 입학한 거인국인의 비율과 동일하면 인구통계학적 균형이 달성됩니다.

균등한 확률 및 기회의 평등과 대조됩니다. 이러한 개념은 집계된 분류 결과가 민감한 속성에 의존하는 것을 허용하지만 특정 정답 라벨의 분류 결과가 민감한 속성에 의존하는 것은 허용하지 않습니다. 인구통계학적 균형을 위해 최적화할 때의 절충안을 살펴볼 수 있는 시각화는 '더 스마트한 머신러닝으로 차별을 타파하기'를 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 공정성: 인구통계학적 동등성을 참고하세요.

노이즈 제거

다음과 같은 자체 지도 학습의 일반적인 접근 방식

노이즈 제거를 사용하면 라벨이 없는 예에서 학습할 수 있습니다. 원본 데이터 세트는 타겟 또는 라벨로 사용되고 노이즈가 있는 데이터는 입력으로 사용됩니다.

일부 마스크 언어 모델은 다음과 같이 잡음 제거를 사용합니다.

- 일부 토큰을 마스킹하여 라벨이 지정되지 않은 문장에 노이즈가 인위적으로 추가됩니다.

- 모델은 원래 토큰을 예측하려고 합니다.

밀집 특성

대부분 또는 모든 값이 0이 아닌 특성으로, 일반적으로 부동 소수점 값의 텐서입니다. 예를 들어 다음 10요소 텐서는 값이 0이 아닌 요소가 9개이므로 밀도가 높습니다.

| 8 | 3 | 7 | 5 | 2 | 4 | 0 | 4 | 9 | 6 |

희소 특성과 대비되는 개념입니다.

조밀한 층

완전 연결 레이어의 동의어입니다.

깊이

신경망에서 다음을 합산한 값입니다.

예를 들어 히든 레이어 5개와 출력 레이어 1개가 있는 신경망의 깊이는 6입니다.

입력 레이어는 깊이에 영향을 미치지 않는다는 점에 유의하세요.

깊이별 분리 컨볼루셔널 신경망 (sepCNN)

Inception을 기반으로 하는 컨볼루셔널 신경망 아키텍처로, Inception 모듈이 깊이별 분리형 컨볼루션으로 대체됩니다. Xception이라고도 합니다.

깊이별 분리 합성곱 (분리 가능 합성곱이라고도 함)은 표준 3D 합성곱을 두 개의 별도 합성곱 연산으로 분해하여 계산 효율성을 높입니다. 첫째, 깊이별 합성곱은 깊이가 1 (n ✕ n ✕ 1)이고, 둘째, 길이와 너비가 1 (1 ✕ 1 ✕ n)인 점별 합성곱입니다.

자세한 내용은 Xception: Deep Learning with Depthwise Separable Convolutions를 참고하세요.

파생된 라벨

유추 라벨의 동의어입니다.

기기

다음 두 가지 정의가 가능한 과부하된 용어:

- CPU, GPU, TPU 등 TensorFlow 세션을 실행할 수 있는 하드웨어 카테고리입니다.

- 가속기 칩(GPU 또는 TPU)에서 ML 모델을 학습할 때 텐서와 삽입을 실제로 조작하는 시스템 부분입니다. 기기는 가속기 칩에서 실행됩니다. 반면 호스트는 일반적으로 CPU에서 실행됩니다.

개인 정보 차등 보호

머신러닝에서 모델의 학습 세트에 포함된 민감한 데이터(예: 개인의 개인 정보)가 노출되지 않도록 보호하는 익명화 접근 방식입니다. 이 접근 방식을 사용하면 모델이 특정 개인에 대해 많이 학습하거나 기억하지 않습니다. 이는 모델 학습 중에 노이즈를 샘플링하고 추가하여 개별 데이터 포인트를 가림으로써 민감한 학습 데이터가 노출될 위험을 완화합니다.

개인 정보 차등 보호는 머신러닝 외부에서도 사용됩니다. 예를 들어 데이터 과학자는 다양한 인구통계에 대한 제품 사용 통계를 계산할 때 개인 정보 차등 보호를 사용하여 개인 정보를 보호하기도 합니다.

차원 축소

일반적으로 임베딩 벡터로 변환하여 특징 벡터에서 특정 특징을 표현하는 데 사용되는 차원 수를 줄입니다.

측정기준

다음 정의 중 하나를 갖는 중복된 용어:

Tensor에서 좌표의 수준 수입니다. 예를 들면 다음과 같습니다.

- 스칼라에는 0개의 차원(예:

["Hello"])이 있습니다. - 벡터에는 1개의 차원(예:

[3, 5, 7, 11])이 있습니다. - 행렬에는 2개의 차원(예:

[[2, 4, 18], [5, 7, 14]])이 있습니다. 좌표가 하나인 1차원 벡터에서 특정 셀을 고유하게 지정할 수 있습니다. 2차원 행렬에서 특정 셀을 고유하게 지정하려면 두 개의 좌표가 필요합니다.

- 스칼라에는 0개의 차원(예:

특징 벡터의 항목 수입니다.

임베딩 레이어의 요소 수입니다.

직접 프롬프트

제로샷 프롬프팅의 동의어입니다.

불연속 특성

가능한 값의 유한 집합을 갖는 특성입니다. 예를 들어 값이 animal, vegetable 또는 mineral만 될 수 있는 특성은 이산 (또는 범주형) 특성입니다.

연속 기능과 대조해 보세요.

판별 모델

하나 이상의 특성 세트에서 라벨을 예측하는 모델입니다. 공식적으로 분류 모델은 특성과 가중치를 고려한 출력의 조건부 확률을 정의합니다. 즉,

p(output | features, weights)

예를 들어 특성과 가중치에서 이메일이 스팸인지 여부를 예측하는 모델은 분류 모델입니다.

분류 모델과 회귀 모델을 비롯한 다양한 지도 학습 모델이 분류 모델에 해당됩니다.

생성 모델과 대비되는 개념입니다.

분류자

예가 진짜인지 가짜인지 여부를 결정하는 시스템입니다.

또는 생성적 적대 신경망 내 하위 시스템으로, 생성기에서 생성한 예가 진짜인지 가짜인지 여부를 결정합니다.

자세한 내용은 GAN 과정의 판별기를 참고하세요.

차별적 영향

다양한 인구 하위 그룹에 불균형적으로 영향을 미치는 사람에 관한 결정을 내립니다. 이는 일반적으로 알고리즘 기반 의사 결정 프로세스가 일부 하위 그룹에 다른 하위 그룹보다 더 큰 피해를 주거나 이익을 주는 상황을 의미합니다.

예를 들어 소인국의 소형 주택 대출 자격 요건을 결정하는 알고리즘이 우편 주소에 특정 우편번호가 포함된 경우 '자격 요건 미충족'으로 분류할 가능성이 더 높다고 가정해 보겠습니다. Big-Endian Lilliputians가 Little-Endian Lilliputians보다 이 우편번호가 포함된 우편 주소를 가질 가능성이 더 높다면 이 알고리즘은 불균형한 영향을 미칠 수 있습니다.

하위 그룹 특성이 알고리즘 의사결정 프로세스에 명시적으로 입력될 때 발생하는 불균형에 초점을 맞추는 차별적 대우와는 대조적입니다.

차별적인 대우

다양한 하위 그룹의 사람들이 다르게 취급되도록 알고리즘 의사 결정 과정에 주체의 민감한 속성을 고려합니다.

예를 들어 대출 신청서에 제공된 데이터를 기반으로 소인국의 소형 주택 대출 자격 요건을 결정하는 알고리즘을 생각해 보세요. 알고리즘이 릴리풋의 소속을 입력으로 빅엔디언 또는 리틀엔디언으로 사용하는 경우 해당 차원을 따라 차별적 대우를 시행하는 것입니다.

불균형한 영향은 하위 그룹이 모델의 입력인지 여부와 관계없이 알고리즘 결정이 하위 그룹에 미치는 사회적 영향의 불균형에 초점을 맞춘다는 점에서 대조됩니다.

증류

하나의 모델 (티처라고 함)의 크기를 원래 모델의 예측을 최대한 충실하게 모방하는 더 작은 모델 (스튜던트라고 함)로 줄이는 프로세스입니다. 증류는 작은 모델이 큰 모델 (티처)에 비해 두 가지 주요 이점이 있기 때문에 유용합니다.

- 더 빠른 추론 시간

- 메모리 및 에너지 사용량 감소

하지만 학생의 예측은 일반적으로 교사의 예측만큼 좋지 않습니다.

증류는 학생 모델과 교사 모델의 예측 출력 간 차이를 기반으로 손실 함수를 최소화하도록 학생 모델을 학습시킵니다.

증류를 다음 용어와 비교 및 대조하세요.

자세한 내용은 머신러닝 단기집중과정의 LLM: 미세 조정, 증류, 프롬프트 엔지니어링을 참고하세요.

배포

지정된 특성 또는 라벨의 다양한 값의 빈도와 범위입니다. 분포는 특정 값이 얼마나 가능성이 있는지 캡처합니다.

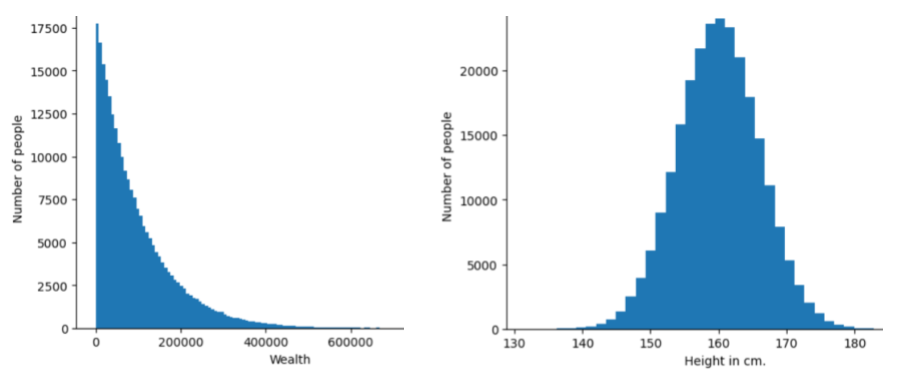

다음 이미지는 서로 다른 두 분포의 히스토그램을 보여줍니다.

- 왼쪽에는 부의 거듭제곱 법칙 분포와 해당 부를 소유한 사람 수가 표시되어 있습니다.

- 오른쪽에는 키와 해당 키를 가진 사람 수의 정규 분포가 표시됩니다.

각 특성과 라벨의 분포를 이해하면 값을 정규화하고 이상치를 감지하는 방법을 결정하는 데 도움이 됩니다.

분포에서 벗어남은 데이터 세트에 표시되지 않거나 매우 드문 값을 나타냅니다. 예를 들어 고양이 이미지로 구성된 데이터 세트의 경우 토성 이미지는 분포에서 벗어난 것으로 간주됩니다.

분리형 군집화

계층적 군집화를 참고하세요.

다운샘플링

중복으로 정의된 용어로서 다음 중 하나를 의미할 수 있습니다.

- 모델을 더욱 효과적으로 학습하기 위해 특성에서 정보의 양을 줄입니다. 예를 들어 이미지 인식 모델을 학습하기 전에 고해상도 이미지를 저해상도 형식으로 다운샘플링합니다.

- 기반이 취약한 클래스에 대한 모델 학습을 개선하기 위해 불균형적으로 낮은 비율의 과대 표현된 클래스를 학습합니다. 예를 들어 클래스 불균형 데이터세트에서 모델은 다수 클래스에 대해 많이 학습하고 소수 클래스에 대해서는 충분히 학습하지 않는 경향이 있습니다. 다운샘플링을 사용하면 다수 범주와 소수 범주에 대한 학습량을 균형 조정할 수 있습니다.

자세한 내용은 머신러닝 단기집중과정의 데이터 세트: 불균형 데이터 세트를 참고하세요.

DQN

Deep Q-Network의 약어입니다.

드롭아웃 정규화

신경망을 학습시키는 데 유용한 정규화의 한 형태입니다. 드롭아웃 정규화는 단일 경사 단계에서 네트워크 레이어의 유닛을 고정된 개수만큼 무작위로 선택하여 삭제합니다. 드롭아웃된 단위가 많을수록 정규화가 강력해집니다. 이 방식은 네트워크를 학습시켜 더 작은 네트워크로 이루어진 대규모 앙상블을 모방하도록 하는 방식과 비슷합니다. 자세한 내용은 드롭아웃: 신경망의 과적합을 방지하는 간단한 방법을 참고하세요.

동적

자주 또는 지속적으로 수행되는 작업입니다. 머신러닝에서 동적과 온라인은 동의어입니다. 다음은 머신러닝에서 동적 및 온라인이 일반적으로 사용되는 경우입니다.

- 동적 모델 (또는 온라인 모델)은 자주 또는 지속적으로 재학습되는 모델입니다.

- 동적 학습 (또는 온라인 학습)은 자주 또는 지속적으로 학습하는 프로세스입니다.

- 동적 추론 (또는 온라인 추론)은 요청 시 예측을 생성하는 프로세스입니다.

동적 모델

모델이 자주 (심지어 지속적으로) 재학습됩니다. 동적 모델은 진화하는 데이터에 지속적으로 적응하는 '평생 학습자'입니다. 동적 모델은 온라인 모델이라고도 합니다.

정적 모델과 대비되는 개념입니다.

E

즉시 실행

작업이 즉시 실행되는 TensorFlow 프로그래밍 환경입니다. 반대로 지연 실행에서 호출되는 작업은 명시적으로 평가될 때까지 실행되지 않습니다. 즉시 실행은 대부분의 프로그래밍 언어로 된 코드와 마찬가지로 명령형 인터페이스입니다. 즉시 실행 프로그램은 일반적으로 그래프 실행 프로그램보다 훨씬 쉽게 디버깅됩니다.

조기 중단

학습 손실이 감소하기 전에 학습을 종료하는 정규화 방법입니다. 조기 중단에서는 검증 데이터 세트의 손실이 증가하기 시작하면(즉, 일반화 성능이 저하되면) 의도적으로 모델 학습을 중단합니다.

조기 종료와 대조해보세요.

earth mover's distance (EMD)

두 분포의 상대적 유사성을 나타내는 측정값입니다. EMD가 낮을수록 분포가 더 유사합니다.

편집 거리

두 텍스트 문자열이 서로 얼마나 유사한지를 측정한 값입니다. 머신러닝에서 편집 거리는 다음과 같은 이유로 유용합니다.

- 편집 거리는 쉽게 계산할 수 있습니다.

- 편집 거리는 서로 유사한 것으로 알려진 두 문자열을 비교할 수 있습니다.

- 편집 거리는 서로 다른 문자열이 지정된 문자열과 얼마나 유사한지 확인할 수 있습니다.

편집 거리에는 여러 정의가 있으며 각 정의는 서로 다른 문자열 작업을 사용합니다. 예는 레벤슈타인 거리를 참고하세요.

Einsum 표기법

두 텐서를 결합하는 방법을 설명하는 효율적인 표기법입니다. 텐서는 한 텐서의 요소를 다른 텐서의 요소와 곱한 다음 곱을 합산하여 결합됩니다. Einsum 표기법은 기호를 사용하여 각 텐서의 축을 식별하며, 이러한 동일한 기호가 재배열되어 새로운 결과 텐서의 모양을 지정합니다.

NumPy는 일반적인 Einsum 구현을 제공합니다.

임베딩 레이어

고차원 카테고리 특성을 학습하여 점진적으로 하위 차원 임베딩 벡터를 학습하는 특수 숨겨진 레이어입니다. 임베딩 레이어를 사용하면 신경망이 고차원 카테고리 특성으로만 학습하는 것보다 훨씬 효율적으로 학습할 수 있습니다.

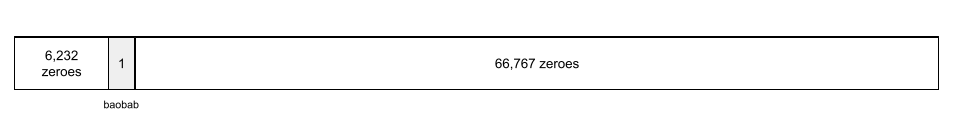

예를 들어 지구에는 현재 약 73,000가지의 수종이 생식하고 있습니다. 모델에서 나무 종이 특성이라고 가정해 보겠습니다. 그러면 모델의 입력 레이어에는 길이가 73,000인 원-핫 벡터가 포함됩니다.

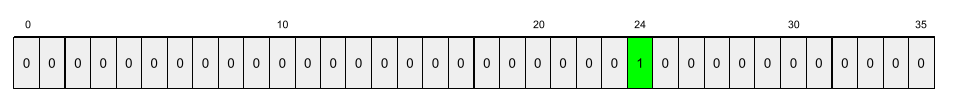

예를 들어 baobab는 다음과 같이 표현될 수 있습니다.

73,000개 요소 배열은 매우 깁니다. 모델에 삽입 레이어를 추가하지 않으면 72,999개의 0을 곱해야 하므로 학습에 시간이 매우 오래 걸립니다. 임베딩 레이어가 12개의 차원으로 구성되도록 선택할 수 있습니다. 따라서 임베딩 레이어는 각 나무 종에 대한 새로운 임베딩 벡터를 점진적으로 학습합니다.

경우에 따라 해싱이 삽입 레이어의 합리적인 대안이 될 수 있습니다.

자세한 내용은 머신러닝 단기집중과정의 임베딩을 참고하세요.

임베딩 공간

고차원 벡터 공간의 특성이 매핑되는 d차원 벡터 공간입니다. 의도한 애플리케이션에 의미 있는 구조를 포착하도록 임베딩 공간이 학습됩니다.

두 임베딩의 내적은 유사성의 척도입니다.

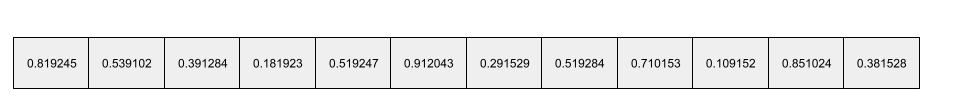

임베딩 벡터

대체적으로 모든 숨겨진 레이어에서 가져온 부동 소수점 수의 배열로, 해당 숨겨진 레이어의 입력을 설명합니다. 임베딩 벡터는 임베딩 레이어에서 학습된 부동 소수점 숫자 배열인 경우가 많습니다. 예를 들어 임베딩 레이어가 지구상의 73,000개 수종 각각에 대한 임베딩 벡터를 학습해야 한다고 가정해 보겠습니다. 다음 배열이 바오밥 나무의 임베딩 벡터일 수 있습니다.

임베딩 벡터는 무작위 숫자의 모음이 아닙니다. 임베딩 레이어는 학습 중에 신경망이 다른 가중치를 학습하는 방식과 유사하게 학습을 통해 이러한 값을 결정합니다. 배열의 각 요소는 나무 종의 일부 특성에 따른 등급입니다. 어떤 요소가 어떤 수종의 특징을 나타내나요? 사람이 판단하기는 매우 어렵습니다.

임베딩 벡터의 수학적으로 주목할 만한 부분은 유사한 항목이 유사한 부동 소수점 숫자 집합을 갖는다는 것입니다. 예를 들어 유사한 나무 종은 유사하지 않은 나무 종보다 더 유사한 부동 소수점 숫자를 갖습니다. 레드우드와 세쿼이아는 관련이 있는 나무 종이므로 레드우드와 야자수보다 더 비슷한 부동 소수점 숫자를 갖습니다. 동일한 입력으로 모델을 재학습하더라도 모델을 재학습할 때마다 임베딩 벡터의 숫자가 변경됩니다.

경험적 누적 분포 함수 (eCDF 또는 EDF)

실제 데이터 세트의 실증적 측정을 기반으로 하는 누적 분포 함수 x축을 따라 어느 지점에서든 함수의 값은 지정된 값보다 작거나 같은 데이터 세트의 관측치 비율입니다.

경험적 위험 최소화 (ERM)

학습 세트에서 손실을 최소화하는 함수를 선택합니다. 구조적 위험 최소화와 대비되는 개념입니다.

인코더

일반적으로 원시적이고 희소한 또는 외부 표현을 더 처리되고, 더 밀집되거나, 더 내부적인 표현으로 변환하는 모든 ML 시스템입니다.

인코더는 더 큰 모델의 구성요소인 경우가 많으며, 여기서 인코더는 디코더와 자주 페어링됩니다. 일부 트랜스포머는 인코더와 디코더를 페어링하지만, 인코더만 사용하거나 디코더만 사용하는 트랜스포머도 있습니다.

일부 시스템은 인코더의 출력을 분류 또는 회귀 네트워크의 입력으로 사용합니다.

시퀀스-투-시퀀스(Seq2Seq) 태스크에서 인코더는 입력 시퀀스를 가져와 내부 상태(벡터)를 반환합니다. 그런 다음 디코더는 이 내부 상태를 사용하여 다음 시퀀스를 예측합니다.

트랜스포머 아키텍처의 인코더 정의는 트랜스포머를 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 LLM: 대규모 언어 모델이란 무엇인가요?를 참고하세요.

endpoints

서비스에 연결할 수 있는 네트워크 주소 지정 가능 위치 (일반적으로 URL)입니다.

자동화

독립적으로 학습된 모델 모음으로, 예측이 평균화되거나 집계됩니다. 대부분의 경우 앙상블은 단일 모델보다 더 나은 예측을 생성합니다. 예를 들어 랜덤 포레스트는 여러 결정 트리로 구성된 앙상블입니다. 모든 결정 포레스트가 앙상블은 아닙니다.

자세한 내용은 머신러닝 단기집중과정의 랜덤 포레스트를 참고하세요.

엔트로피

정보 이론에서 확률 분포가 얼마나 예측 불가능한지를 설명합니다. 또는 엔트로피는 각 예시에 포함된 정보의 양으로도 정의됩니다. 분포는 확률 변수의 모든 값이 동일할 때 가능한 가장 높은 엔트로피를 갖습니다.

가능한 값이 두 개인 집합('0'과 '1', 예를 들어 이진 분류 문제의 라벨)의 엔트로피는 다음 공식을 따릅니다.

H = -p log p - q log q = -p log p - (1-p) * log (1-p)

각 항목의 의미는 다음과 같습니다.

- H는 엔트로피입니다.

- p는 '1' 예의 비율입니다.

- q는 '0' 예시의 비율입니다. q = (1 - p)입니다.

- log는 일반적으로 log2입니다. 이 경우 엔트로피 단위는 비트입니다.

예를 들어 다음을 가정합니다.

- 100개의 예에 '1' 값이 포함되어 있습니다.

- 300개의 예시에는 값 '0'이 포함되어 있습니다.

따라서 엔트로피 값은 다음과 같습니다.

- p = 0.25

- q = 0.75

- H = (-0.25)log2(0.25) - (0.75)log2(0.75) = 0.81비트/예

완벽하게 균형이 잡힌 집합 (예: '0' 200개와 '1' 200개)의 엔트로피는 예시당 1.0비트입니다. 세트가 불균형해질수록 엔트로피가 0.0에 가까워집니다.

결정 트리에서 엔트로피는 분할기가 분류 결정 트리의 성장 중에 조건을 선택하는 데 도움이 되는 정보 획득을 공식화하는 데 도움이 됩니다.

다음과 엔트로피 비교:

엔트로피는 흔히 섀넌의 엔트로피라고 불립니다.

자세한 내용은 결정 트리 과정의 숫자 특징이 있는 이진 분류를 위한 정확한 분할기를 참고하세요.

환경

강화 학습에서 에이전트를 포함하고 에이전트가 해당 환경의 상태를 관찰할 수 있는 환경입니다. 예를 들어 표현된 환경이 체스와 같은 게임이거나 미로와 같은 실제 환경일 수 있습니다. 에이전트가 환경에 작업을 적용하면 환경이 상태 간에 전환됩니다.

에피소드

강화 학습에서 에이전트가 환경을 학습하기 위해 반복적으로 시도하는 각각의 시도입니다.

에포크

전체 훈련 세트에 대한 전체 훈련 패스로, 각 예시가 한 번씩 처리됩니다.

에포크는 N/배치 크기 학습 반복을 나타내며, 여기서 N은 총 예시 수입니다.

예를 들어 다음과 같이 가정해 보겠습니다.

- 데이터 세트는 1,000개의 예시로 구성됩니다.

- 배치 크기는 50개입니다.

따라서 단일 에포크에는 20번의 반복이 필요합니다.

1 epoch = (N/batch size) = (1,000 / 50) = 20 iterations

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 하이퍼파라미터를 참고하세요.

epsilon greedy 정책

강화 학습에서 무작위 정책을 따르는 정책(입실론 확률) 또는 탐욕 정책(그 외의 경우) 예를 들어 입실론이 0.9이면 정책은 90% 의 시간 동안 무작위 정책을 따르고 10% 의 시간 동안 탐욕 정책을 따릅니다.

연속된 에피소드에서 알고리즘은 무작위 정책을 따르는 것에서 탐욕스러운 정책을 따르는 것으로 전환하기 위해 입실론 값을 줄입니다. 정책을 전환함으로써 에이전트는 먼저 환경을 무작위로 탐색한 다음 무작위 탐색 결과를 탐욕스럽게 활용합니다.

기회의 평등

모델이 민감한 속성의 모든 값에 대해 원하는 결과를 동일하게 잘 예측하는지 평가하는 공정성 측정항목 즉, 모델의 바람직한 결과가 양성 클래스인 경우 목표는 모든 그룹에 대해 참양성률을 동일하게 만드는 것입니다.

기회의 균등은 균등화된 오즈와 관련이 있으며, 이를 위해서는 참양성률과 거짓양성률이 모든 그룹에서 동일해야 합니다.

글럽더브드립 대학교에서 소인국인과 거인국인을 모두 엄격한 수학 프로그램에 입학시킨다고 가정해 보겠습니다. 릴리풋의 중등학교에서는 수학 수업의 강력한 교육 과정을 제공하며, 대부분의 학생이 대학 프로그램에 적합합니다. 브로브딩나그의 중등학교에서는 수학 수업을 전혀 제공하지 않으므로 자격을 갖춘 학생이 훨씬 적습니다. 자격 요건을 갖춘 학생이 릴리풋인인지 브로브딩나그인인지에 관계없이 입학할 가능성이 동일한 경우 국적 (릴리풋인 또는 브로브딩나그인)과 관련하여 '입학'이라는 선호 라벨에 대한 기회 균등이 충족됩니다.

예를 들어 100명의 소인과 100명의 거인이 글럽덥드립 대학에 지원하고 입학 결정이 다음과 같이 내려진다고 가정해 보겠습니다.

표 1. 릴리풋 지원자 (90% 가 자격 요건을 충족함)

| 적격성 확인됨 | 자격 없음 | |

|---|---|---|

| Admitted(허용됨) | 45 | 3 |

| 거부됨 | 45 | 7 |

| 합계 | 90 | 10 |

|

자격 요건을 충족하는 학생의 합격률: 45/90 = 50% 자격 요건을 충족하지 않는 학생의 불합격률: 7/10 = 70% 릴리풋 학생의 총 합격률: (45+3)/100 = 48% |

||

표 2. 브로브딩나그 지원자 (10% 가 자격 요건을 충족함):

| 적격성 확인됨 | 자격 없음 | |

|---|---|---|

| 입학 | 5 | 9 |

| 거부됨 | 5 | 81 |

| 합계 | 10 | 90 |

|

자격 요건을 충족하는 학생 중 합격자 비율: 5/10 = 50% 자격 요건을 충족하지 않는 학생 중 불합격자 비율: 81/90 = 90% Brobdingnagian 학생 중 합격자 비율: (5+9)/100 = 14% |

||

위의 예에서는 자격을 갖춘 릴리풋인과 브로브딩나그인 모두 입학할 확률이 50% 이므로 자격을 갖춘 학생의 입학 기회가 균등하게 제공됩니다.

기회 균등은 충족되지만, 다음 두 가지 공정성 측정 기준은 충족되지 않습니다.

- 인구 통계적 평등: 릴리푸트인과 브롭딩나기인의 대학 입학률은 서로 다릅니다. 릴리푸트인 학생의 48% 가 대학에 입학하는 반면, 브롭딩나기인 학생의 14% 만이 대학에 입학합니다.

- 균등한 기회: 자격 요건을 충족하는 소인국 학생과 거인국 학생 모두 입학할 기회가 동일하지만 자격 요건을 충족하지 않는 소인국 학생과 거인국 학생 모두 거부될 기회가 동일하다는 추가 제약 조건은 충족되지 않습니다. 자격이 없는 Lilliputian의 거부율은 70% 인 반면 자격이 없는 Brobdingnagian의 거부율은 90% 입니다.

자세한 내용은 머신러닝 단기집중과정의 공정성: 기회의 평등을 참고하세요.

을 참조하세요.균등한 기회

모델이 양성 클래스 및 음성 클래스 모두에 대해 민감한 속성의 모든 값에 대해 결과를 동일하게 잘 예측하는지 평가하는 공정성 측정항목입니다. 한 클래스 또는 다른 클래스만 독점적으로 평가하지 않습니다. 즉, 모든 그룹에서 참양성률과 거짓음성률이 동일해야 합니다.

균등화된 오즈는 단일 클래스 (양수 또는 음수)의 오류율에만 초점을 맞추는 기회의 균등과 관련이 있습니다.

예를 들어 Glubbdubdrib University에서 Lilliputians와 Brobdingnagians를 모두 엄격한 수학 프로그램에 입학시킨다고 가정해 보겠습니다. 릴리풋의 중등학교에서는 수학 수업의 강력한 커리큘럼을 제공하며, 대부분의 학생이 대학 프로그램에 적합합니다. 브로브딩나그의 중등학교에서는 수학 수업을 전혀 제공하지 않으므로 자격을 갖춘 학생이 훨씬 적습니다. 지원자가 소인인지 거인인지에 관계없이 자격이 있는 경우 프로그램에 입학할 가능성이 동일하고 자격이 없는 경우 거부될 가능성이 동일하다면 균등한 기회가 충족됩니다.

100명의 소인국인과 100명의 거인국인이 글럽덥드립 대학에 지원하고 입학 결정이 다음과 같이 내려진다고 가정해 보겠습니다.

표 3. 릴리풋 지원자 (90% 가 자격 요건을 충족함)

| 적격성 확인됨 | 자격 없음 | |

|---|---|---|

| Admitted(허용됨) | 45 | 2 |

| 거부됨 | 45 | 8 |

| 합계 | 90 | 10 |

|

자격 요건을 충족하는 학생의 합격률: 45/90 = 50% 자격 요건을 충족하지 않는 학생의 불합격률: 8/10 = 80% 릴리풋 학생의 총 합격률: (45+2)/100 = 47% |

||

표 4. 광대한 지원자 (10% 가 합격):

| 적격성 확인됨 | 자격 없음 | |

|---|---|---|

| 입학 | 5 | 18 |

| 거부됨 | 5 | 72 |

| 합계 | 10 | 90 |

|

자격 요건을 충족하는 학생 중 합격한 학생의 비율: 5/10 = 50% 자격 요건을 충족하지 않는 학생 중 불합격한 학생의 비율: 72/90 = 80% Brobdingnagian 학생 중 합격한 학생의 총 비율: (5+18)/100 = 23% |

||

자격을 갖춘 릴리풋과 브롭딩나기안 학생이 모두 입학할 확률이 50% 이고, 자격이 없는 릴리풋과 브롭딩나기안 학생이 불합격할 확률이 80% 이므로 균등한 확률이 충족됩니다.

균등한 기회는 '감독 학습에서의 기회 균등'에서 다음과 같이 공식적으로 정의됩니다. '예측 변수 Ŷ이 보호 속성 A 및 결과 Y와 관련하여 균등한 기회를 충족하는 경우는 Ŷ과 A가 Y에 따라 조건부로 독립적인 경우입니다.'

에스티메이터

지원 중단된 TensorFlow API입니다. Estimator 대신 tf.keras를 사용하세요.

평가하다

주로 LLM 평가의 약어로 사용됩니다. evals는 더 광범위하게 평가의 모든 형태를 나타내는 약어입니다.

평가

모델의 품질을 측정하거나 서로 다른 모델을 비교하는 프로세스입니다.

지도 머신러닝 모델을 평가하려면 일반적으로 검증 세트 및 테스트 세트를 기준으로 판단합니다. LLM 평가에는 일반적으로 광범위한 품질 및 안전성 평가가 포함됩니다.

일치검색

모델의 출력이 정답 또는 참조 텍스트와 정확히 일치하거나 일치하지 않는 전무후무한 측정항목입니다. 예를 들어 정답이 orange인 경우 완전 일치를 충족하는 유일한 모델 출력은 orange입니다.

정확히 일치하는 항목은 출력이 시퀀스(항목의 순위가 지정된 목록)인 모델도 평가할 수 있습니다. 일반적으로 일치검색을 위해서는 생성된 순위 목록이 그라운드 트루스와 정확히 일치해야 합니다. 즉, 두 목록의 각 항목이 동일한 순서여야 합니다. 하지만 정답이 여러 개의 올바른 시퀀스로 구성된 경우 정확한 일치에는 모델의 출력이 올바른 시퀀스 중 하나와 일치해야 합니다.

예시

특성의 한 행 값과 라벨 값(있는 경우) 지도 학습의 예는 다음 두 가지 일반 카테고리로 나뉩니다.

- 라벨이 지정된 예는 하나 이상의 특성과 하나의 라벨로 구성됩니다. 라벨이 지정된 예가 학습에 사용됩니다.

- 라벨이 없는 예는 하나 이상의 특성으로 구성되지만 라벨은 없습니다. 라벨이 없는 예는 추론 중에 사용됩니다.

예를 들어 날씨 조건이 학생 시험 점수에 미치는 영향을 파악하도록 모델을 학습시킨다고 가정해 보겠습니다. 다음은 라벨이 지정된 세 가지 예입니다.

| 기능 | 라벨 | ||

|---|---|---|---|

| 온도 | 습도 | 압력 | 테스트 점수 |

| 15 | 47 | 998 | 좋음 |

| 19 | 34 | 1020 | 매우 좋음 |

| 18 | 92 | 1012 | 나쁨 |

라벨이 지정되지 않은 예는 다음과 같습니다.

| 온도 | 습도 | 압력 | |

|---|---|---|---|

| 12 | 62 | 1014 | |

| 21 | 47 | 1017 | |

| 19 | 41 | 1021 |

데이터 세트의 행은 일반적으로 예시의 원시 소스입니다. 즉, 예시는 일반적으로 데이터 세트의 열 하위 집합으로 구성됩니다. 또한 예의 특성에는 특성 교차와 같은 합성 특성도 포함될 수 있습니다.

자세한 내용은 머신러닝 소개 과정의 감독 학습을 참고하세요.

경험 리플레이

강화 학습에서 학습 데이터의 시간적 상관관계를 줄이는 데 사용되는 DQN 기법입니다. agent는 상태 전환을 replay buffer에 저장한 다음 리플레이 버퍼에서 전환을 샘플링하여 학습 데이터를 만듭니다.

실험자 편향

확증 편향을 참고하세요.

경사 폭발 문제

심층신경망 (특히 순환 신경망)의 경사가 놀라울 정도로 가팔라지는 (높아지는) 경향입니다. 경사가 가파르면 심층 신경망의 각 노드의 가중치가 매우 크게 업데이트되는 경우가 많습니다.

경사 폭발 문제가 있는 모델은 학습하기가 어렵거나 불가능해집니다. 그라데이션 클리핑을 사용하면 이 문제를 완화할 수 있습니다.

경사 소멸 문제와 비교해 보세요.

F

F1

정밀도와 재현율을 모두 사용하는 '롤업' 이진 분류 측정항목입니다. 공식은 다음과 같습니다.

사실성

ML 세계에서 출력이 현실에 기반한 모델을 설명하는 속성입니다. 사실성은 측정항목이 아닌 개념입니다. 예를 들어 대규모 언어 모델에 다음 프롬프트를 전송한다고 가정해 보겠습니다.

소금의 화학식은 무엇인가요?

사실성을 최적화하는 모델은 다음과 같이 대답합니다.

NaCl

모든 모델이 사실에 기반해야 한다고 가정하기 쉽습니다. 하지만 다음과 같은 일부 프롬프트는 생성형 AI 모델이 사실성보다는 창의성을 최적화하도록 해야 합니다.

우주 비행사와 애벌레에 관한 5행 희시를 말해 줘.

결과로 나오는 넌센스 시는 현실에 기반하지 않을 가능성이 높습니다.

그라운딩과 대비되는 개념입니다.

공정성 제약 조건

하나 이상의 공정성 정의가 충족되도록 알고리즘에 제약 조건을 적용합니다. 공정성 제약 조건의 예는 다음과 같습니다.공정성 측정항목

측정 가능한 '공정성'의 수학적 정의 일반적으로 사용되는 공정성 측정항목은 다음과 같습니다.

많은 공정성 측정항목은 상호 배타적입니다. 공정성 측정항목의 비호환성을 참고하세요.

거짓음성 (FN)

모델에서 네거티브 클래스로 잘못 예측한 예입니다. 예를 들어 모델에서 특정 이메일 메시지가 스팸이 아닌 것으로(네거티브 클래스) 예측했지만 해당 이메일 메시지가 실제로 스팸인 경우가 여기에 해당합니다.

거짓음성률

모델이 네거티브 클래스로 잘못 예측한 실제 포지티브 예의 비율입니다. 다음 공식은 거짓 음성 비율을 계산합니다.

자세한 내용은 머신러닝 단기집중과정의 기준점 및 혼동 행렬을 참고하세요.

거짓양성 (FP)

모델에서 포지티브 클래스로 잘못 예측한 예입니다. 예를 들어 모델에서 특정 이메일 메시지가 스팸 (포지티브 클래스)인 것으로 예측했지만 실제로는 스팸이 아닌 경우가 여기에 해당합니다.

자세한 내용은 머신러닝 단기집중과정의 기준점 및 혼동 행렬을 참고하세요.

거짓양성률 (FPR)

모델이 포지티브 클래스로 잘못 예측한 실제 네거티브 예의 비율입니다. 다음 공식은 거짓양성률을 계산합니다.

거짓양성률은 ROC 곡선의 x축입니다.

자세한 내용은 머신러닝 단기집중과정의 분류: ROC 및 AUC를 참고하세요.

빠른 감쇠

LLM의 성능을 개선하는 학습 기법입니다. 빠른 감소는 학습 중에 학습률을 빠르게 감소시키는 것을 의미합니다. 이 전략은 모델이 학습 데이터에 과적합되는 것을 방지하고 일반화를 개선합니다.

특징

머신러닝 모델의 입력 변수입니다. example은 하나 이상의 특성으로 구성됩니다. 예를 들어 날씨가 학생 시험 점수에 미치는 영향을 파악하기 위해 모델을 학습한다고 가정해 보겠습니다. 다음 표에는 각각 3개의 특징과 하나의 라벨이 포함된 세 가지 예가 나와 있습니다.

| 기능 | 라벨 | ||

|---|---|---|---|

| 온도 | 습도 | 압력 | 테스트 점수 |

| 15 | 47 | 998 | 92 |

| 19 | 34 | 1020 | 84 |

| 18 | 92 | 1012 | 87 |

라벨과 대비되는 개념입니다.

자세한 내용은 머신러닝 소개 과정의 감독 학습을 참고하세요.

특성 교차

범주형 또는 버케팅된 특성을 '교차'하여 형성된 합성 특성입니다.

예를 들어 다음 네 가지 버킷 중 하나로 온도를 나타내는 '기분 예측' 모델을 생각해 보겠습니다.

freezingchillytemperatewarm

다음 세 버킷 중 하나의 풍속을 나타냅니다.

stilllightwindy

특성 교차가 없으면 선형 모델은 앞의 7가지 다양한 버킷 각각에 대해 독립적으로 학습됩니다. 따라서 모델은 예를 들어 windy에 대한 학습과 독립적으로 freezing에 대해 학습합니다.

또는 온도와 풍속의 특성 교차를 만들 수도 있습니다. 이 합성 기능에는 다음과 같은 12가지 가능한 값이 있습니다.

freezing-stillfreezing-lightfreezing-windychilly-stillchilly-lightchilly-windytemperate-stilltemperate-lighttemperate-windywarm-stillwarm-lightwarm-windy

특성 교차 덕분에 모델은 freezing-windy일과 freezing-still일의 분위기 차이를 학습할 수 있습니다.

각각 다양한 버킷이 많은 두 특성에서 합성 특성을 만들면 결과 특성 교차에 가능한 조합이 엄청나게 많아집니다. 예를 들어 한 특성에 버킷이 1,000개 있고 다른 특성에 버킷이 2,000개 있으면 결과 특성 교차에는 버킷이 2,000,000개 있습니다.

공식적으로 크로스는 카티전 프로덕트입니다.

특성 교차는 주로 선형 모델과 함께 사용되며 신경망에서는 거의 사용되지 않습니다.

자세한 내용은 머신러닝 단기집중과정의 범주형 데이터: 특성 교차를 참고하세요.

특성 추출 단계를 포함합니다

다음 단계를 포함하는 프로세스:

- 모델을 학습시키는 데 유용할 특성이 무엇인지 판단합니다.

- 데이터 세트의 원시 데이터를 이러한 특성의 효율적인 버전으로 변환합니다.

예를 들어 temperature이 유용한 기능일 수 있다고 판단할 수 있습니다. 그런 다음 버킷팅을 실험하여 모델이 다양한 temperature 범위에서 학습할 수 있는 내용을 최적화할 수 있습니다.

특성 추출을 특징 추출 또는 특성 생성이라고도 합니다.

자세한 내용은 머신러닝 단기집중과정의 숫자 데이터: 모델이 특징 벡터를 사용하여 데이터를 수집하는 방법을 참고하세요.

특성 추출

다음과 같은 정의로 중복 정의된 용어입니다.

특성 중요도

변수 중요도의 동의어입니다.

기능 세트

머신러닝 모델에서 학습에 사용하는 특성 그룹입니다. 예를 들어 주택 가격을 예측하는 모델의 간단한 특성 집합은 우편번호, 부동산 크기, 부동산 상태로 구성될 수 있습니다.

기능 사양

tf.Example 프로토콜 버퍼에서 특성 데이터를 추출하는 데 필요한 정보를 설명합니다. tf.Example 프로토콜 버퍼는 데이터의 컨테이너일 뿐이므로 다음을 지정해야 합니다.

- 추출할 데이터 (즉, 특성의 키)

- 데이터 유형 (예: float 또는 int)

- 길이 (고정 또는 가변)

특성 벡터

예을 구성하는 특성 값의 배열입니다. 특성 벡터는 학습 및 추론 중에 입력됩니다. 예를 들어 이산 특성이 두 개인 모델의 특성 벡터는 다음과 같을 수 있습니다.

[0.92, 0.56]

각 예시에서는 특성 벡터에 다른 값을 제공하므로 다음 예시의 특성 벡터는 다음과 같을 수 있습니다.

[0.73, 0.49]

특성 추출은 특성 벡터에서 특성을 표현하는 방법을 결정합니다. 예를 들어 가능한 값이 5개인 이진 범주형 특성은 원-핫 인코딩으로 표현할 수 있습니다. 이 경우 특정 예의 특징 벡터 부분은 다음과 같이 0이 4개이고 세 번째 위치에 1.0이 하나로 구성됩니다.

[0.0, 0.0, 1.0, 0.0, 0.0]

또 다른 예로 모델이 다음 세 가지 특징으로 구성되어 있다고 가정해 보겠습니다.

- 5개의 가능한 값을 갖는 이진 범주형 특성은 원핫 인코딩으로 표현됩니다. 예:

[0.0, 1.0, 0.0, 0.0, 0.0] - 3개의 가능한 값을 원-핫 인코딩으로 표현한 또 다른 이진 범주형 기능입니다. 예:

[0.0, 0.0, 1.0] - 부동 소수점 특징입니다(예:

8.3).

이 경우 각 예시의 특징 벡터는 9개 값으로 표현됩니다. 위 목록의 예시 값을 고려할 때 특징 벡터는 다음과 같습니다.

0.0 1.0 0.0 0.0 0.0 0.0 0.0 1.0 8.3

자세한 내용은 머신러닝 단기집중과정의 숫자 데이터: 모델이 특징 벡터를 사용하여 데이터를 수집하는 방법을 참고하세요.

기능화

문서나 동영상과 같은 입력 소스에서 특성을 추출하고 이러한 특성을 특성 벡터에 매핑하는 프로세스입니다.

일부 ML 전문가는 특성화를 특성 추출 또는 특징 추출의 동의어로 사용합니다.

제휴 학습

스마트폰과 같은 기기에 상주하는 분산화된 예시를 사용하여 머신러닝 모델을 학습시키는 분산식 머신러닝 접근방식입니다. 제휴 학습에서는 기기의 하위 집합이 중앙 조정 서버에서 현재 모델을 다운로드합니다. 기기는 기기에 저장된 예시를 사용하여 모델을 개선합니다. 그런 다음 기기는 모델 개선사항 (학습 예시는 아님)을 조정 서버에 업로드합니다. 여기서 모델 개선사항은 다른 업데이트와 집계되어 개선된 전역 모델을 생성합니다. 집계 후에는 기기에서 계산한 모델 업데이트가 더 이상 필요하지 않으며 삭제할 수 있습니다.

학습 예는 업로드되지 않으므로 제휴 학습은 집중적인 데이터 수집 및 데이터 최소화라는 개인 정보 보호 원칙을 따릅니다.

자세한 내용은 제휴 학습 만화(만화 맞음)를 참고하세요.

피드백 루프

머신러닝에서 모델의 예측이 동일한 모델 또는 다른 모델의 학습 데이터에 영향을 미치는 상황입니다. 예를 들어 영화를 추천하는 모델은 사람들이 보는 영화에 영향을 미치고, 이는 후속 영화 추천 모델에 영향을 미칩니다.

자세한 내용은 머신러닝 단기집중과정의 프로덕션 ML 시스템: 질문하기를 참고하세요.

순방향 신경망 (FFN)

순환 또는 재귀 연결이 없는 신경망입니다. 예를 들어 기존 심층신경망은 순방향 신경망입니다. 순환되는 순환 신경망과 대비되는 개념입니다.

퓨샷 학습

객체 분류에 자주 사용되는 머신러닝 접근 방식으로, 소수의 학습 예시만으로 효과적인 분류 모델을 학습하도록 설계되었습니다.

퓨샷 프롬프팅

대규모 언어 모델이 어떻게 대답해야 하는지 보여주는 두 개 이상의 예시('몇 개')가 포함된 프롬프트 예를 들어 다음 긴 프롬프트에는 대규모 언어 모델이 질문에 답변하는 방법을 보여주는 두 가지 예시가 포함되어 있습니다.

| 하나의 프롬프트의 일부 | 참고 |

|---|---|

| 지정된 국가의 공식 통화는 무엇인가요? | LLM이 답변해야 하는 질문입니다. |

| 프랑스: EUR | 예를 하나 들어 보겠습니다. |

| 영국: GBP | 또 다른 예. |

| 인도: | 실제 쿼리입니다. |

일반적으로 퓨샷 프롬핑은 제로샷 프롬핑 및 원샷 프롬핑보다 더 바람직한 결과를 낳습니다. 하지만, 짧은 샷 프롬핑에는 더 긴 프롬핑이 필요합니다.

퓨샷 프롬프팅은 프롬프트 기반 학습에 적용되는 퓨샷 학습의 한 형태입니다.

자세한 내용은 머신러닝 단기집중과정의 프롬프트 엔지니어링을 참고하세요.

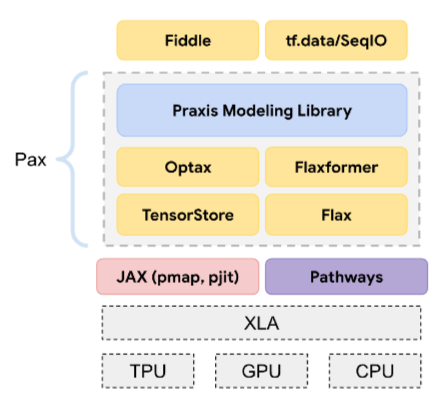

바이올린

침해적인 코드나 인프라 없이 함수와 클래스의 값을 설정하는 Python 우선 구성 라이브러리 Pax 및 기타 ML 코드베이스의 경우 이러한 함수와 클래스는 모델과 학습 초매개변수를 나타냅니다.

Fiddle은 머신러닝 코드베이스가 일반적으로 다음과 같이 나뉜다고 가정합니다.

- 레이어와 옵티마이저를 정의하는 라이브러리 코드

- 라이브러리를 호출하고 모든 것을 연결하는 데이터 세트 '글루' 코드

Fiddle은 평가되지 않고 변경 가능한 형식으로 글루 코드의 호출 구조를 캡처합니다.

세부 조정

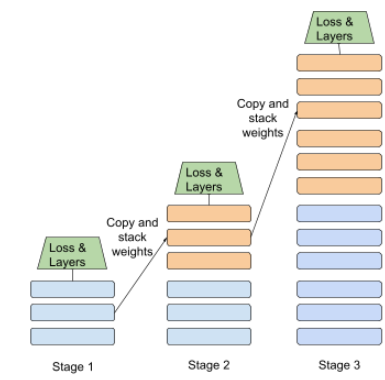

선행 학습된 모델에서 이루어지는 작업별 두 번째 학습으로, 구체적인 사용 사례에 맞춰 파라미터를 세부적으로 조정합니다. 예를 들어 일부 대규모 언어 모델의 전체 학습 시퀀스는 다음과 같습니다.

- 사전 학습: 모든 영어 위키백과 페이지와 같은 방대한 일반 데이터 세트를 기반으로 대규모 언어 모델을 학습합니다.

- 미세 조정: 의료 질문에 응답하는 등 특정 작업을 수행하도록 사전 학습된 모델을 학습시킵니다. 미세 조정에는 일반적으로 특정 작업에 초점을 맞춘 수백 또는 수천 개의 예가 포함됩니다.

또 다른 예로, 대규모 이미지 모델에 대한 전체 교육 시퀀스는 다음과 같습니다.

- 선행 학습:Wikimedia Commons의 모든 이미지와 같은 방대한 일반 이미지 데이터 세트에서 대규모 이미지 모델을 학습합니다.

- 미세 조정: 범고래 이미지를 생성하는 등 특정 작업을 수행하도록 사전 학습된 모델을 학습시킵니다.

미세 조정에는 다음 전략의 조합이 포함될 수 있습니다.

- 사전 학습 모델의 기존 파라미터를 모두 수정합니다. 이를 전체 미세 조정이라고도 합니다.

- 사전 학습된 모델의 기존 파라미터 중 일부(일반적으로 출력 레이어에 가장 가까운 레이어)만 수정하고 다른 기존 파라미터 (일반적으로 입력 레이어에 가장 가까운 레이어)는 변경하지 않습니다. 파라미터 효율적인 조정을 참고하세요.

- 기존 레이어 위에 레이어를 추가합니다. 일반적으로 출력 레이어에 가장 가까운 레이어 위에 추가합니다.

세부 조정은 전이 학습의 한 형태입니다. 따라서 세부 조정에서는 사전 학습된 모델을 학습하는 데 사용된 것과 다른 손실 함수나 다른 모델 유형을 사용할 수 있습니다. 예를 들어 사전 학습된 대형 이미지 모델을 미세 조정하여 입력 이미지의 새 수를 반환하는 회귀 모델을 만들 수 있습니다.

다음 용어와 미세 조정의 차이점을 비교하고 대조하세요.

자세한 내용은 머신러닝 단기집중과정의 미세 조정을 참고하세요.

플래시 모델

속도와 짧은 지연 시간에 최적화된 비교적 작은 Gemini 모델 제품군입니다. Flash 모델은 빠른 응답과 높은 처리량이 중요한 다양한 애플리케이션을 위해 설계되었습니다.

플랙스

JAX를 기반으로 빌드된 딥 러닝을 위한 고성능 오픈소스 라이브러리입니다. Flax는 신경망을 학습하는 함수와 성능을 평가하는 방법을 제공합니다.

Flaxformer

자연어 처리 및 다중 모드 연구를 위해 주로 설계된 Flax를 기반으로 구축된 오픈 소스 Transformer 라이브러리입니다.

게이트 삭제

장기 단기 기억 셀에서 셀을 통한 정보 흐름을 규제하는 부분입니다. 망각 게이트는 셀 상태에서 어떤 정보를 삭제할지 결정하여 컨텍스트를 유지합니다.

파운데이션 모델

다양한 대규모 학습 세트로 학습된 매우 큰 사전 학습된 모델입니다. 파운데이션 모델은 다음을 모두 수행할 수 있습니다.

즉, 파운데이션 모델은 이미 일반적인 의미에서 매우 유능하지만 특정 작업에 더욱 유용하도록 추가로 맞춤설정할 수 있습니다.

성공 비율

ML 모델의 생성된 텍스트를 평가하는 측정항목입니다. 성공률은 '성공한' 생성 텍스트 출력 수를 생성된 총 텍스트 출력 수로 나눈 값입니다. 예를 들어 대규모 언어 모델이 코드 블록 10개를 생성했는데 그중 5개가 성공했다면 성공 비율은 50%입니다.

성공률은 통계 전반에서 널리 유용하지만 ML에서는 이 측정항목이 주로 코드 생성이나 수학 문제와 같은 검증 가능한 작업을 측정하는 데 유용합니다.

전체 소프트맥스

softmax의 동의어입니다.

후보 샘플링과 대비되는 개념입니다.

자세한 내용은 머신러닝 단기집중과정의 신경망: 다중 클래스 분류를 참고하세요.

완전 연결 레이어

각 노드가 후속 숨겨진 레이어의 모든 노드에 연결된 숨겨진 레이어

완전 연결 레이어를 밀집 레이어라고도 합니다.

함수 변환

함수를 입력으로 받아 변환된 함수를 출력으로 반환하는 함수입니다. JAX는 함수 변환을 사용합니다.

G

GAN

생성적 적대 신경망의 약어입니다.

Gemini

Google의 최첨단 AI로 구성된 생태계 이 생태계의 요소는 다음과 같습니다.

- 다양한 Gemini 모델

- Gemini 모델과의 대화형 인터페이스입니다. 사용자가 프롬프트를 입력하면 Gemini가 프롬프트에 응답합니다.

- 다양한 Gemini API

- Gemini 모델을 기반으로 하는 다양한 비즈니스 제품(예: Google Cloud용 Gemini)

Gemini 모델

Google의 최첨단 트랜스포머 기반 멀티모달 모델 Gemini 모델은 에이전트와 통합되도록 특별히 설계되었습니다.

사용자는 대화형 대화 인터페이스와 SDK를 비롯한 다양한 방식으로 Gemini 모델과 상호작용할 수 있습니다.

Gemma

Gemini 모델을 만드는 데 사용된 것과 동일한 연구 및 기술로 빌드된 경량 개방형 모델 제품군입니다. 다양한 Gemma 모델을 사용할 수 있으며 각 모델은 시각, 코드, 지침 준수와 같은 다양한 기능을 제공합니다. 자세한 내용은 Gemma를 참고하세요.

생성형 AI

생성형 AI의 약어입니다.

일반화

모델이 이전에 접하지 못한 새로운 데이터에 대해 올바른 예측을 수행하는 능력입니다. 일반화할 수 있는 모델은 과적합된 모델과는 반대입니다.

자세한 내용은 머신러닝 단기집중과정의 일반화를 참고하세요.

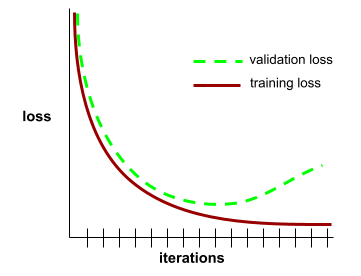

일반화 곡선

반복 수의 함수로 학습 손실과 검증 손실을 모두 표시한 그래프

일반화 곡선을 사용하면 가능한 과적합을 감지하는 데 도움이 됩니다. 예를 들어 다음 일반화 곡선은 검증 손실이 학습 손실보다 훨씬 높아지므로 과적합을 암시합니다.

자세한 내용은 머신러닝 단기집중과정의 일반화를 참고하세요.

일반화 선형 모델

가우시안 노이즈를 기반으로 하는 최소 제곱 회귀 모델을 포아송 노이즈 또는 범주형 노이즈와 같은 다른 유형의 노이즈를 기반으로 하는 다른 유형의 모델로 일반화한 것입니다. 일반화 선형 모델의 예는 다음과 같습니다.

- 로지스틱 회귀

- 다중 클래스 회귀

- 최소 제곱 회귀

볼록 최적화를 통해 일반화 선형 모델의 매개변수를 구할 수 있습니다.

일반화 선형 모델에는 다음과 같은 속성이 있습니다.

- 최적화된 최소 제곱 회귀 모델의 평균 예측은 학습 데이터의 평균 라벨과 동일합니다.

- 최적화된 로지스틱 회귀 모델이 예측하는 평균적인 확률은 학습 데이터의 평균 라벨과 동일합니다.

일반화 선형 모델의 성능은 특성에 따라 제한됩니다. 일반화 선형 모델은 심층 모델과 달리 '새로운 특성을 학습'하지 못합니다.

생성된 텍스트

일반적으로 ML 모델이 출력하는 텍스트입니다. 대규모 언어 모델을 평가할 때 일부 측정항목은 생성된 텍스트를 참조 텍스트와 비교합니다. 예를 들어 ML 모델이 프랑스어를 네덜란드어로 얼마나 효과적으로 번역하는지 확인하려고 한다고 가정해 보겠습니다. 이 경우에는 다음과 같습니다.

- 생성된 텍스트는 ML 모델이 출력하는 네덜란드어 번역입니다.

- 참조 텍스트는 사람 번역가 (또는 소프트웨어)가 만든 네덜란드어 번역입니다.

일부 평가 전략에는 참조 텍스트가 포함되지 않습니다.

생성적 적대 신경망 (GAN)

생성기가 데이터를 생성하고 분류자가 생성된 데이터가 유효한지 여부를 결정하는 새 데이터를 생성하는 시스템

자세한 내용은 생성적 적대 네트워크 과정을 참고하세요.

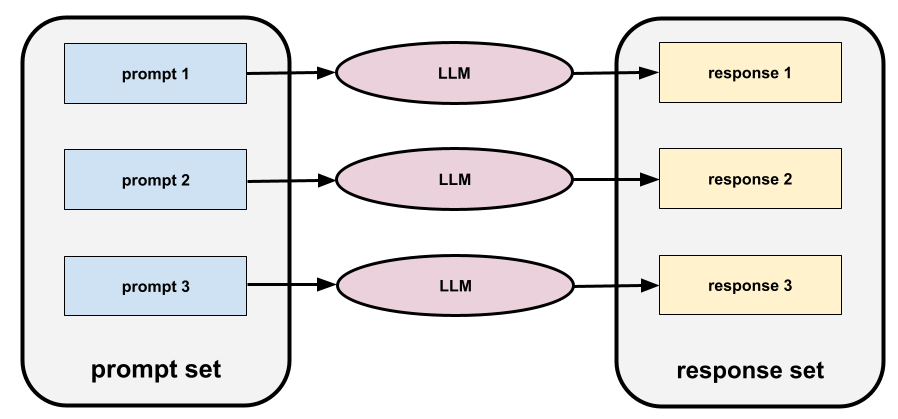

생성형 AI의

정식 정의가 없는 신흥 변혁적 분야입니다. 하지만 대부분의 전문가들은 생성형 AI 모델이 다음을 모두 충족하는 콘텐츠를 생성할 수 있다고 동의합니다.

- 복잡한

- 일관성 있는

- 원본

생성형 AI의 예는 다음과 같습니다.

- 대규모 언어 모델: 정교한 원본 텍스트를 생성하고 질문에 답변할 수 있습니다.

- 고유한 이미지를 생성할 수 있는 이미지 생성 모델

- 오디오 및 음악 생성 모델: 창작 음악을 작곡하거나 사실적인 음성을 생성할 수 있습니다.

- 동영상을 생성할 수 있는 동영상 생성 모델

LSTM 및 RNN을 비롯한 일부 이전 기술도 독창적이고 일관된 콘텐츠를 생성할 수 있습니다. 일부 전문가들은 이러한 초기 기술을 생성형 AI로 간주하는 반면, 다른 전문가들은 진정한 생성형 AI에는 초기 기술에서 생성할 수 있는 것보다 더 복잡한 출력이 필요하다고 생각합니다.

예측 ML과 대비되는 개념입니다.

생성 모델

다음 중 하나를 수행하는 모델입니다.

- 학습 데이터 세트로부터 새 예제를 생성합니다. 예를 들어 생성 모델은 시 데이터 세트를 학습한 후 시를 작성할 수 있습니다. 생성적 적대 신경망의 생성기 부분이 이 카테고리에 속합니다.

- 새로운 예가 학습 세트에서 생성되거나 학습 세트를 생성한 것과 동일한 메커니즘을 통해 생성되었을 확률을 결정합니다. 예를 들어 영어 문장으로 구성된 데이터 세트를 학습한 후 생성 모델은 새 입력이 유효한 영어 문장일 확률을 결정합니다.

생성 모델은 이론적으로 데이터 세트에서 예 또는 특정 특성의 분포를 인식할 수 있습니다. 이는 다음과 같은 의미입니다.

p(examples)

비지도 학습 모델은 생성 모델입니다.

분류 모델과 대비되는 개념입니다.

생성기

새 예시를 만드는 생성적 적대 신경망 내의 하위 시스템입니다.

분류 모델과 대비되는 개념입니다.

gini 불순도

엔트로피와 유사한 측정항목입니다. 분할기는 지니 불순도 또는 엔트로피에서 파생된 값을 사용하여 분류 결정 트리의 조건을 구성합니다. 정보 획득은 엔트로피에서 파생됩니다. 지니 불순도에서 파생된 측정항목에 대해 보편적으로 허용되는 동등한 용어는 없습니다. 하지만 이 이름이 지정되지 않은 측정항목은 정보 획득만큼 중요합니다.

Gini 불순도는 Gini 색인 또는 간단히 Gini라고도 합니다.

골든 데이터 세트

실제 상황을 포착하는 수동으로 큐레이팅된 데이터 세트입니다. 팀은 하나 이상의 골든 데이터 세트를 사용하여 모델의 품질을 평가할 수 있습니다.

일부 골든 데이터 세트는 정답의 서로 다른 하위 도메인을 캡처합니다. 예를 들어 이미지 분류를 위한 골든 데이터 세트는 조명 조건과 이미지 해상도를 포착할 수 있습니다.

황금 반응

좋은 것으로 알려진 대답입니다. 예를 들어 다음과 같은 프롬프트가 있다고 가정해 보겠습니다.

2 + 2

골든 응답은 다음과 같습니다.

4

Google AI Studio

Google의 대규모 언어 모델을 사용하여 애플리케이션을 실험하고 빌드할 수 있는 사용자 친화적인 인터페이스를 제공하는 Google 도구입니다. 자세한 내용은 Google AI Studio 홈페이지를 참고하세요.

GPT (Generative Pre-trained Transformer)

OpenAI에서 개발한 Transformer 기반 대규모 언어 모델 제품군입니다.

GPT 변형은 다음을 비롯한 여러 모달리티에 적용할 수 있습니다.

- 이미지 생성 (예: ImageGPT)

- 텍스트 이미지 변환 생성 (예: DALL-E)

gradient

모든 독립 변수를 기준으로 한 편미분의 벡터입니다. 머신러닝에서 경사는 모델 함수의 편미분 벡터입니다. 경사는 가장 급격한 상승 방향을 가리킵니다.

경사 누적

반복당 한 번이 아닌 에포크당 한 번만 매개변수를 업데이트하는 역전파 기법입니다. 각 미니 배치를 처리한 후 기울기 누적은 기울기의 누적 합계를 업데이트합니다. 그런 다음 에포크의 마지막 미니배치를 처리한 후 시스템은 모든 그라데이션 변경사항의 합계를 기반으로 매개변수를 최종적으로 업데이트합니다.

그라데이션 누적은 배치 크기가 학습에 사용할 수 있는 메모리 양에 비해 매우 큰 경우에 유용합니다. 메모리가 문제인 경우 배치 크기를 줄이는 것이 자연스러운 경향입니다. 하지만 일반적인 역전파에서 배치 크기를 줄이면 매개변수 업데이트 수가 증가합니다. 그라데이션 누적을 사용하면 모델이 메모리 문제를 방지하면서도 효율적으로 학습할 수 있습니다.

그래디언트 부스티드 (결정) 트리 (GBT)

다음과 같은 결정 포레스트 유형입니다.

자세한 내용은 의사결정 트리 과정의 그레이디언트 부스팅 의사결정 트리를 참고하세요.

그라데이션 부스팅

강한 모델의 품질을 개선 (손실 감소)하기 위해 약한 모델을 반복적으로 학습시키는 학습 알고리즘입니다. 예를 들어 약한 모델은 선형 또는 작은 결정 트리 모델일 수 있습니다. 강한 모델은 이전에 학습된 모든 약한 모델의 합이 됩니다.

가장 간단한 형태의 그레이디언트 부스팅에서는 각 반복에서 강력한 모델의 손실 그레이디언트를 예측하도록 약한 모델이 학습됩니다. 그런 다음 경사 하강법과 유사하게 예측된 경사를 빼서 강력한 모델의 출력이 업데이트됩니다.

각 항목의 의미는 다음과 같습니다.

- $F_{0}$ 은 시작 강한 모델입니다.

- $F_{i+1}$ 은 다음 강력한 모델입니다.

- $F_{i}$ 는 현재 강력한 모델입니다.

- $\xi$ 는 0.0과 1.0 사이의 값으로 축소라고 하며, 경사 하강법의 학습률과 유사합니다.

- $f_{i}$ 는 $F_{i}$의 손실 기울기를 예측하도록 학습된 약한 모델입니다.

최신 변형의 그라디언트 부스팅에는 계산에 손실의 2차 도함수(헤시안)도 포함됩니다.

결정 트리는 일반적으로 그레이디언트 부스팅에서 약한 모델로 사용됩니다. 그래디언트 부스팅 (결정) 트리를 참고하세요.

경사 제한

경사하강법을 사용하여 모델을 학습할 때 경사의 최댓값을 인위적으로 제한 (클리핑)하여 경사 폭주 문제를 완화하는 데 일반적으로 사용되는 메커니즘입니다.

경사하강법

손실을 최소화하는 수학적 기법입니다. 경사하강법은 가중치와 편향을 반복적으로 조정하면서 손실을 최소화하는 최적의 조합을 점진적으로 찾습니다.

경사 하강법은 머신러닝보다 훨씬 오래되었습니다.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 경사 하강법을 참고하세요.

그래프

TensorFlow에서는 계산 사양을 의미합니다. 그래프의 노드는 연산을 의미합니다. 가장자리는 방향성을 가지며, 연산의 결과 (Tensor)를 다른 연산의 피연산자로 전달함을 의미합니다. TensorBoard를 사용하여 그래프를 시각화할 수 있습니다.

그래프 실행

프로그램에서 먼저 그래프를 구성한 다음 그래프의 전체 또는 일부를 실행하는 TensorFlow 프로그래밍 환경입니다. 지연 실행은 TensorFlow 1.x의 기본 실행 모드입니다.

즉시 실행과 대비되는 개념입니다.

그리디 정책

강화 학습에서 항상 예상 수익이 가장 높은 작업을 선택하는 정책입니다.

그라운딩

출력이 특정 소스 자료를 기반으로 하는 모델의 속성입니다. 예를 들어 대규모 언어 모델에 전체 물리학 교과서를 입력 ('컨텍스트')으로 제공한다고 가정해 보겠습니다. 그런 다음 물리학 질문으로 대규모 언어 모델에 프롬프트를 제공합니다. 모델의 대답이 교과서의 정보를 반영하는 경우 해당 모델은 해당 교과서에 그라운딩됩니다.그라운딩된 모델이 항상 사실에 기반한 모델은 아닙니다. 예를 들어 입력된 물리학 교과서에 오류가 있을 수 있습니다.

정답

현실

실제로 발생한 일

예를 들어 대학교 1학년 학생이 6년 이내에 졸업할지 예측하는 이진 분류 모델을 생각해 보세요. 이 모델의 그라운드 트루스는 해당 학생이 6년 이내에 실제로 졸업했는지 여부입니다.

그룹 귀인 편향

특정 개인의 진실이 해당 그룹에 속한 모든 사람에게도 진실일 것이라고 가정합니다. 데이터 수집을 위해 편의 샘플링을 사용할 경우 그룹 귀인 편향 효과가 악화될 수 있습니다. 대표성이 없는 샘플에서 현실을 반영하지 않는 귀인이 생성될 수 있습니다.

외부 집단 동질화 편향 및 내집단 편향도 참고하세요. 자세한 내용은 머신러닝 단기집중과정의 공정성: 편향 유형을 참고하세요.

H

환각

생성형 AI 모델이 실제에 관한 주장을 하는 것처럼 보이지만 실제로는 잘못된 출력을 생성하는 것입니다. 예를 들어 버락 오바마가 1865년에 사망했다고 주장하는 생성형 AI 모델은 환각을 일으키는 것입니다.

해싱

머신러닝에서 범주형 데이터를 버케팅하는 메커니즘으로, 특히 카테고리 수는 많지만 데이터 세트에 실제로 나타나는 카테고리 수는 상대적으로 적은 경우에 사용됩니다.

예를 들어 지구에는 약 73,000가지의 수종이 생식하고 있습니다. 73,000개의 개별 범주형 버킷에서 73,000가지 수종을 각각 나타낼 수 있습니다. 또는 이러한 수종 중 200종만 데이터 세트에 나타나는 경우 해싱을 사용하여 수종을 500개 버킷으로 나눌 수 있습니다.

단일 버킷에 여러 수종이 포함될 수 있습니다. 예를 들어 해싱은 유전적으로 유사한 수종인 바오밥과 홍단풍을 동일한 버킷에 배치할 수 있습니다. 그럼에도 불구하고 해싱은 많은 범주형 세트를 선택한 수의 버킷으로 매핑하는 데 유용한 방식입니다. 해싱은 결정적인 방식으로 값을 그룹화하여 많은 수의 가능한 값을 가진 범주별 특성을 훨씬 적은 수의 값으로 반환합니다.

자세한 내용은 머신러닝 단기집중과정의 범주형 데이터: 어휘 및 원-핫 인코딩을 참고하세요.

휴리스틱

문제에 대한 간단하고 빠르게 구현할 수 있는 해결책입니다. 예를 들어 "당사는 휴리스틱을 통해 86% 의 정확성을 실현했습니다. 심층신경망으로 전환한 후 정확성이 최대 98%로 향상되었습니다."

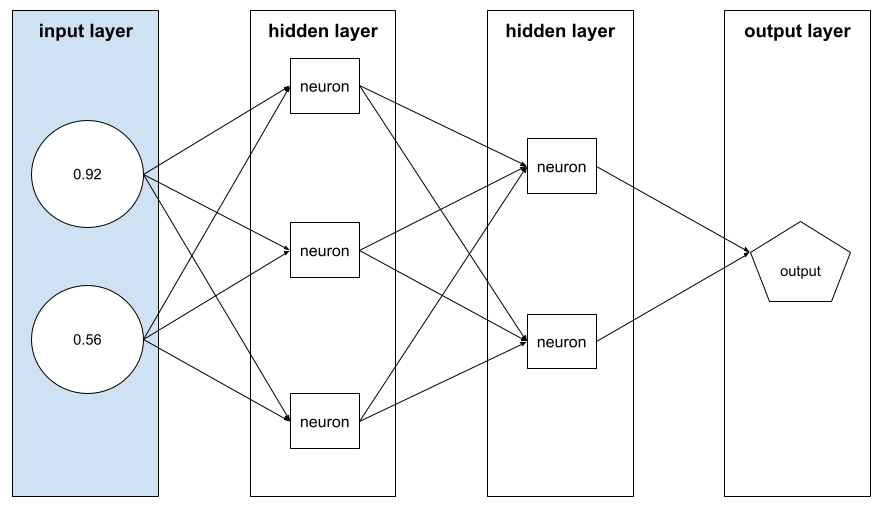

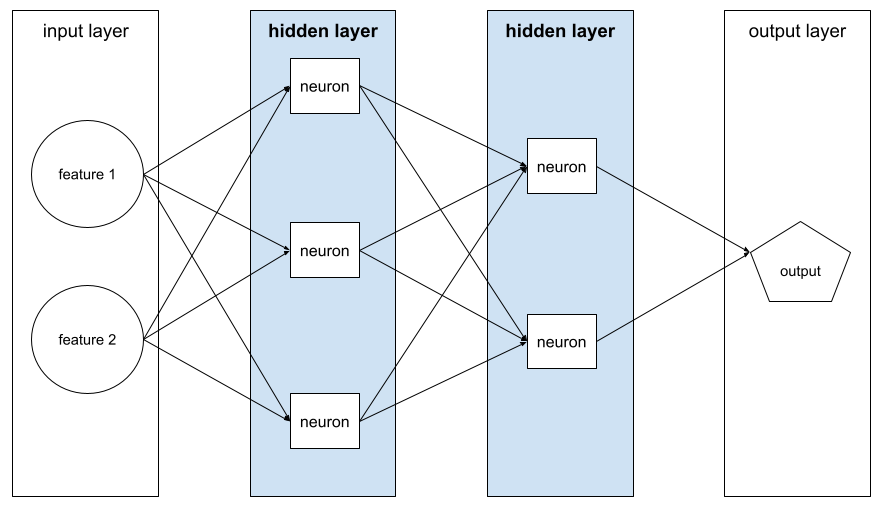

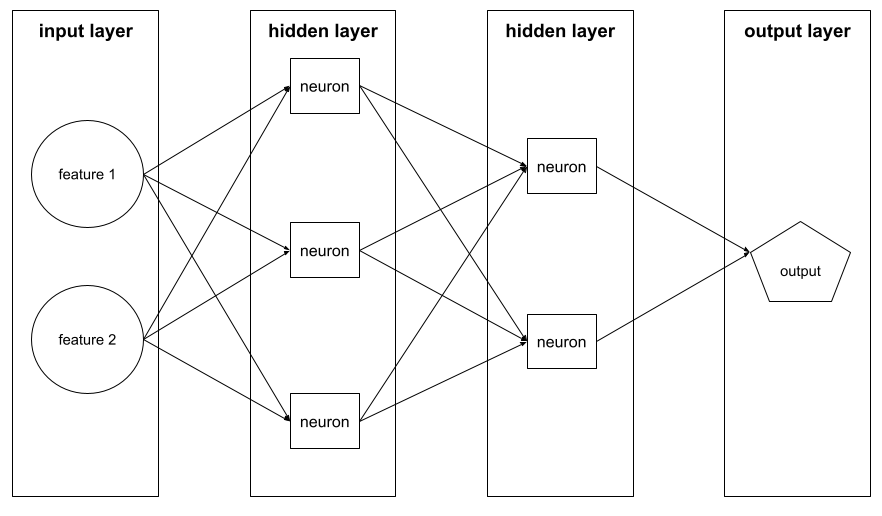

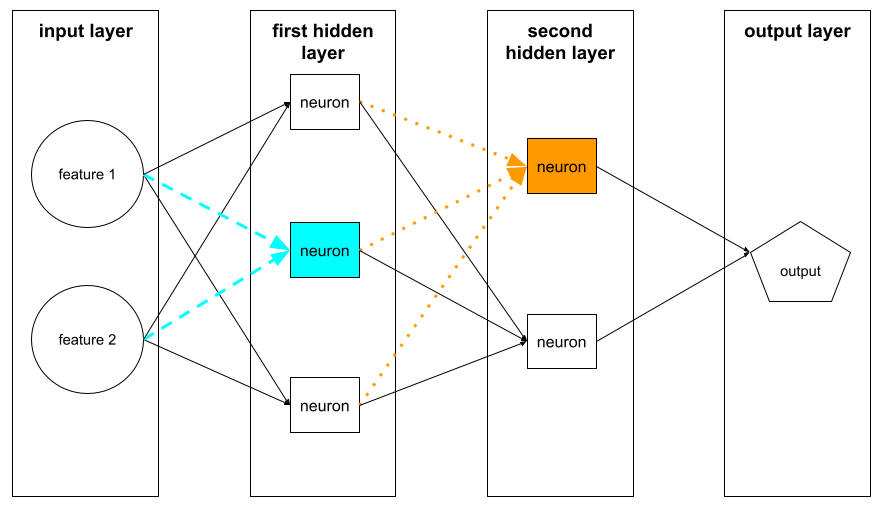

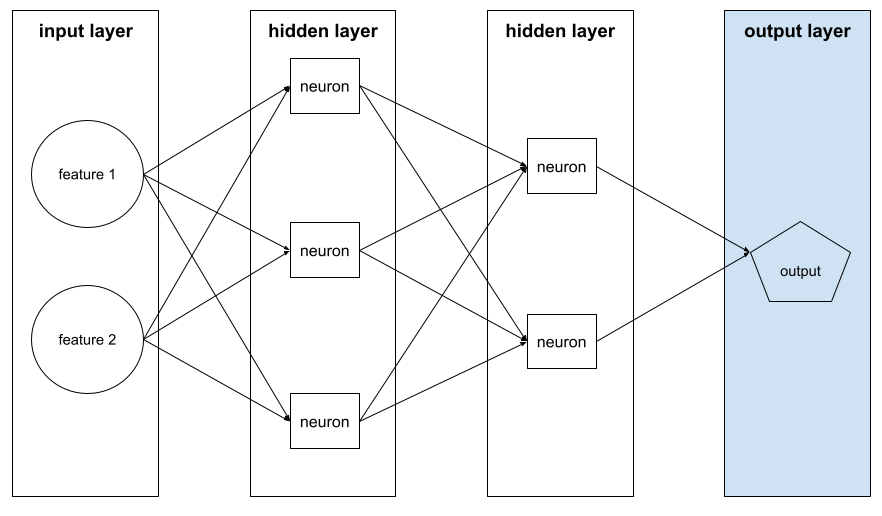

히든 레이어

입력 레이어 (특성)와 출력 레이어 (예측) 사이에 있는 신경망의 레이어입니다. 각 숨겨진 레이어는 하나 이상의 뉴런으로 구성됩니다. 예를 들어 다음 신경망에는 히든 레이어가 두 개 있습니다. 첫 번째 히든 레이어에는 뉴런이 3개 있고 두 번째 히든 레이어에는 뉴런이 2개 있습니다.

심층신경망에는 여러 히든 레이어가 포함되어 있습니다. 예를 들어 위의 그림은 모델에 숨겨진 레이어가 두 개 포함되어 있으므로 심층 신경망입니다.

자세한 내용은 머신러닝 단기집중과정의 신경망: 노드 및 숨겨진 레이어를 참고하세요.

계층적 클러스터링

클러스터 트리를 생성하는 군집화 알고리즘의 카테고리입니다. 계층적 군집화는 식물 분류와 같은 계층적 데이터에 적합합니다. 계층적 군집화 알고리즘에는 두 가지 유형이 있습니다.

- 병합형 군집화는 먼저 모든 예를 자체 클러스터에 할당하고 가장 가까운 클러스터를 반복적으로 병합하여 계층적 트리를 생성합니다.

- 분리형 군집화는 먼저 모든 예를 하나의 클러스터로 그룹화한 다음 클러스터를 계층적 트리로 반복 분할합니다.

중심 기반 군집화와 대비되는 개념입니다.

자세한 내용은 클러스터링 과정의 클러스터링 알고리즘을 참조하세요.

언덕 오르기

모델이 개선을 멈출 때까지 ('언덕 꼭대기에 도달') ML 모델을 반복적으로 개선 ('언덕 오르기')하는 알고리즘입니다. 알고리즘의 일반적인 형식은 다음과 같습니다.

- 시작 모델을 빌드합니다.

- 학습 또는 미세 조정 방식을 약간 조정하여 새로운 후보 모델을 만듭니다. 여기에는 약간 다른 학습 세트 또는 다른 초매개변수를 사용하는 것이 포함될 수 있습니다.

- 새 후보 모델을 평가하고 다음 중 하나를 실행합니다.

- 후보 모델이 시작 모델보다 성능이 우수하면 해당 후보 모델이 새 시작 모델이 됩니다. 이 경우 1, 2, 3단계를 반복합니다.

- 시작 모델보다 성능이 우수한 모델이 없다면 정점에 도달한 것이므로 반복을 중지해야 합니다.

초매개변수 조정에 관한 안내는 딥 러닝 조정 플레이북을 참고하세요. 특성 추출에 관한 안내는 머신러닝 단기집중과정의 데이터 모듈을 참고하세요.

힌지 손실

각 학습 예제에서 최대한 멀리 떨어진 결정 경계를 찾아 예제와 경계 사이의 마진을 최대화하도록 설계된 분류용 손실 함수군입니다. KSVM은 힌지 손실을 사용하거나 제곱 힌지 손실 등의 관련 함수를 사용합니다. 이진 분류의 경우 힌지 손실 함수는 다음과 같이 정의됩니다.

여기서 y는 -1 또는 +1인 실제 라벨이고 y'는 분류 모델의 원시 출력입니다.

따라서 힌지 손실 대 (y * y') 그래프는 다음과 같습니다.

이전 편향

이미 세상에 존재하며 데이터 세트에 포함된 편향의 한 유형입니다. 이러한 편향은 기존 문화적 고정관념, 인구통계적 불평등, 특정 사회 집단에 대한 편견을 반영하는 경향이 있습니다.

예를 들어 두 지역 사회의 현지 은행에서 1980년대의 과거 대출 채무 불이행 데이터를 기반으로 학습된 대출 신청자의 대출 채무 불이행 여부를 예측하는 분류 모델을 생각해 보세요. 커뮤니티 A의 과거 신청자가 커뮤니티 B의 신청자보다 대출 채무 불이행 가능성이 6배 더 높았다면 모델은 과거 편향을 학습하여 커뮤니티 A의 대출을 승인할 가능성이 낮아질 수 있습니다. 이는 해당 커뮤니티의 채무 불이행률을 높인 과거 조건이 더 이상 관련이 없더라도 마찬가지입니다.

자세한 내용은 머신 러닝 집중 강좌의 공정성: 편향 유형을 참조하세요.

홀드아웃 데이터

학습 중에 의도적으로 사용하지 않은 ('홀드아웃된') 예입니다. 검증 데이터 세트와 테스트 데이터 세트는 홀드아웃 데이터의 예입니다. 홀드아웃 데이터는 학습에 사용하지 않은 데이터를 일반화하는 모델의 능력을 평가하는 데 도움이 됩니다. 홀드아웃 세트의 손실은 학습 세트의 손실보다 이전에 접하지 못한 데이터의 손실을 더 효과적으로 예측합니다.

호스트

가속기 칩(GPU 또는 TPU)에서 ML 모델을 학습시킬 때 다음 두 가지를 모두 제어하는 시스템 부분은 다음과 같습니다.

- 코드의 전체 흐름

- 입력 파이프라인의 추출 및 변환입니다.

호스트는 일반적으로 액셀러레이터 칩이 아닌 CPU에서 실행됩니다. 기기는 액셀러레이터 칩에서 텐서를 조작합니다.

인적 평가

사람이 ML 모델의 출력 품질을 판단하는 프로세스입니다. 예를 들어 이중 언어 사용자가 ML 번역 모델의 품질을 판단하는 것입니다. 사람의 평가는 정답이 없는 모델을 판단하는 데 특히 유용합니다.

인간 참여형 (HITL)

다음 중 하나를 의미할 수 있는 느슨하게 정의된 관용구입니다.

- 생성형 AI 출력을 비판적이거나 회의적인 시각으로 보는 정책

- 사람들이 모델의 동작을 형성, 평가, 개선하도록 지원하는 전략 또는 시스템입니다. 인간을 참여시키면 AI가 머신 지능과 인간 지능을 모두 활용할 수 있습니다. 예를 들어 AI가 코드를 생성하고 소프트웨어 엔지니어가 이를 검토하는 시스템은 human-in-the-loop 시스템입니다.

하이퍼파라미터

모델 학습을 연속으로 실행하는 동안 사용자가 또는 초매개변수 조정 서비스(예: Vizier)가 조정하는 변수입니다.예를 들어 학습률은 초매개변수 중 하나입니다. 한 학습 세션 전에 학습률을 0.01로 설정할 수 있습니다. 0.01이 너무 높다고 판단되면 다음 학습 세션의 학습률을 0.003으로 설정할 수 있습니다.

반면 파라미터는 모델이 학습 중에 학습하는 다양한 가중치와 편향입니다.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 하이퍼파라미터를 참고하세요.

초평면

공간을 두 개의 하위 공간으로 분리하는 경계입니다. 예를 들어 선은 2차원의 초평면이고 평면은 3차원의 초평면입니다. 머신러닝에서는 일반적으로 초평면이 고차원 공간을 구분하는 경계입니다. 커널 서포트 벡터 머신은 일반적으로 초고차원 공간에서 초평면을 사용하여 포지티브 클래스와 네거티브 클래스를 구분합니다.

I

i.i.d.

independently and identically distributed의 약어입니다.

이미지 인식

이미지에서 객체, 패턴 또는 개념을 분류하는 프로세스입니다. 영상 인식을 이미지 분류라고도 합니다.

자세한 내용은 ML 실습: 이미지 분류를 참고하세요.

자세한 내용은 ML 실습: 이미지 분류 과정을 참고하세요.

불균형 데이터 세트

클래스 불균형 데이터 세트의 동의어입니다.

내재적 편향

자신의 마음 모델 및 기억을 바탕으로 자동으로 연관 또는 가정을 합니다. 내재적 편향은 다음에 영향을 줄 수 있습니다.

- 데이터 수집 및 분류 방법

- 머신러닝 시스템 설계 및 개발 방법

예를 들어 결혼사진을 식별하기 위해 분류 모델을 만들 때 엔지니어는 사진에 나타나는 흰색 드레스를 특성으로 사용할 수 있습니다. 하지만 흰색 드레스는 특정 시대와 특정 문화에서만 관례적으로 사용됩니다.

확증 편향도 참고하세요.

대치

값 대입의 약식입니다.

공정성 측정항목의 비호환성

일부 공정성 개념은 서로 호환되지 않으며 동시에 충족할 수 없다는 아이디어입니다. 따라서 모든 ML 문제에 적용할 수 있는 공정성을 정량화하는 단일한 보편적 측정항목은 없습니다.

이러한 결과가 실망스러울 수 있지만 공정성 측정항목의 비호환성이 공정성을 위한 노력이 헛되다는 의미는 아닙니다. 대신 공정성은 사용 사례에 특정한 피해를 방지한다는 목표를 가지고 주어진 ML 문제에 맞는 맥락 속에서 정의되어야 한다고 제안합니다.

공정성 측정항목의 비호환성에 관한 자세한 내용은 '공정성의 (불)가능성'을 참고하세요.

컨텍스트 학습

퓨샷 프롬프팅의 동의어입니다.

독립적이고 동일한 분포 (i.i.d)

변경되지 않는 분포에서 추출된 데이터로, 추출된 각 값은 이전에 추출된 값에 종속되지 않습니다. i.i.d.는 머신러닝의 이상기체로, 유용한 수학적 구조이지만 현실에서는 거의 찾아볼 수 없습니다. 예를 들어 웹페이지의 방문자 분포는 짧은 기간에는 i.i.d.일 수 있습니다. 즉, 짧은 기간에는 분포가 변하지 않으며 각 사용자의 방문은 일반적으로 서로 독립적입니다. 하지만 기간을 늘리면 웹페이지 방문자의 계절별 차이가 표시될 수 있습니다.

비정상성도 참고하세요.

개인 공정성

유사한 개인이 유사하게 분류되는지 확인하는 공정성 측정항목입니다. 예를 들어 Brobdingnagian Academy는 성적과 표준화된 시험 점수가 동일한 두 학생이 입학할 가능성이 동일하도록 하여 개인 공정성을 충족하려고 할 수 있습니다.

개별 공정성은 '유사성'(이 경우 성적 및 시험 점수)을 정의하는 방식에 전적으로 의존하며, 유사성 측정항목에 중요한 정보 (예: 학생의 커리큘럼의 엄격성)가 누락되면 새로운 공정성 문제가 발생할 수 있습니다.

개별 공정성에 관한 자세한 내용은 '인식을 통한 공정성'을 참고하세요.

추론

기존 머신러닝에서 학습된 모델을 라벨이 없는 예에 적용하여 예측을 수행하는 과정입니다. 자세한 내용은 ML 소개 과정의 지도 학습을 참고하세요.

대규모 언어 모델에서 추론은 학습된 모델을 사용하여 입력 프롬프트에 대한 응답을 생성하는 프로세스입니다.

통계에서 추론은 약간 다른 의미를 갖습니다. 자세한 내용은 통계적 추론에 대한 위키백과 문서를 참고하세요.

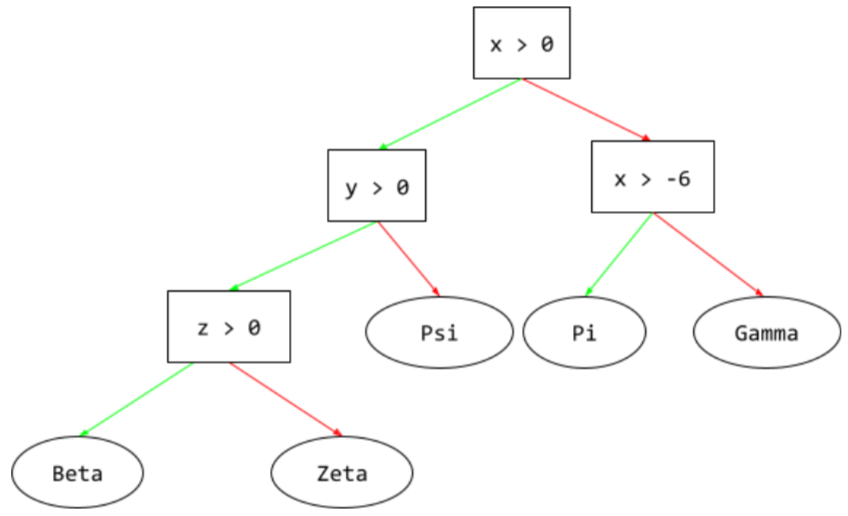

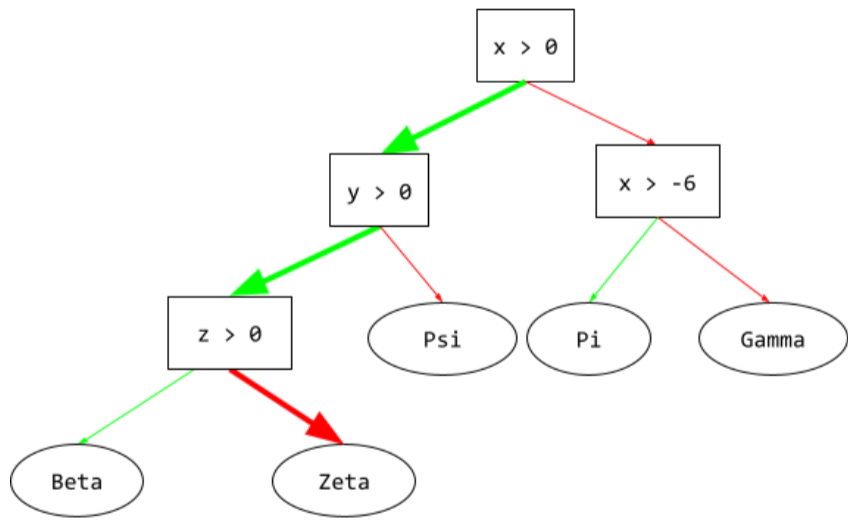

추론 경로

결정 트리에서 추론 중에 특정 예가 루트에서 다른 조건으로 이동하는 경로가 리프로 종료됩니다. 예를 들어 다음 결정 트리에서 더 두꺼운 화살표는 다음 기능 값이 있는 예시의 추론 경로를 보여줍니다.

- x = 7

- y = 12

- z = -3

다음 그림의 추론 경로는 리프 (Zeta)에 도달하기 전에 세 가지 조건을 거칩니다.

세 개의 굵은 화살표는 추론 경로를 보여줍니다.

자세한 내용은 결정 트리 과정의 결정 트리를 참고하세요.

정보 획득

결정 포레스트에서 노드의 엔트로피와 하위 노드의 엔트로피의 가중치 (예 수 기준) 합계 간의 차이입니다. 노드의 엔트로피는 해당 노드의 예시의 엔트로피입니다.

예를 들어 다음 엔트로피 값을 고려해 보세요.

- 상위 노드의 엔트로피 = 0.6

- 관련 예가 16개인 한 하위 노드의 엔트로피 = 0.2

- 관련 예가 24개인 다른 하위 노드의 엔트로피 = 0.1

따라서 예의 40% 는 한 하위 노드에 있고 60% 는 다른 하위 노드에 있습니다. 따라서 날짜는 다음과 같이 계산합니다.

- 가중치가 적용된 하위 노드의 엔트로피 합계 = (0.4 * 0.2) + (0.6 * 0.1) = 0.14

따라서 정보 획득은 다음과 같습니다.

- 정보 획득 = 상위 노드의 엔트로피 - 하위 노드의 가중 엔트로피 합계

- 정보 획득 = 0.6 - 0.14 = 0.46

대부분의 분할기는 정보 획득을 극대화하는 조건을 만들려고 합니다.

내집단 편향

자신이 속한 그룹이나 자신이 갖고 있는 특성을 편애하는 경향을 나타냅니다. 테스터 또는 평가자가 머신러닝 개발자의 친구, 가족 또는 동료로 구성된다면 내집단 편향으로 인해 제품 테스트 또는 데이터 세트가 무효화될 수 있습니다.

내집단 편향은 그룹 귀인 편향의 일종입니다. 외부 집단 동질화 편향도 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 공정성: 편향 유형을 참고하세요.

입력 생성기

데이터가 신경망에 로드되는 메커니즘입니다.

입력 생성기는 학습, 평가, 추론을 위한 배치를 생성하기 위해 반복되는 텐서로 원시 데이터를 처리하는 역할을 하는 구성요소로 생각할 수 있습니다.

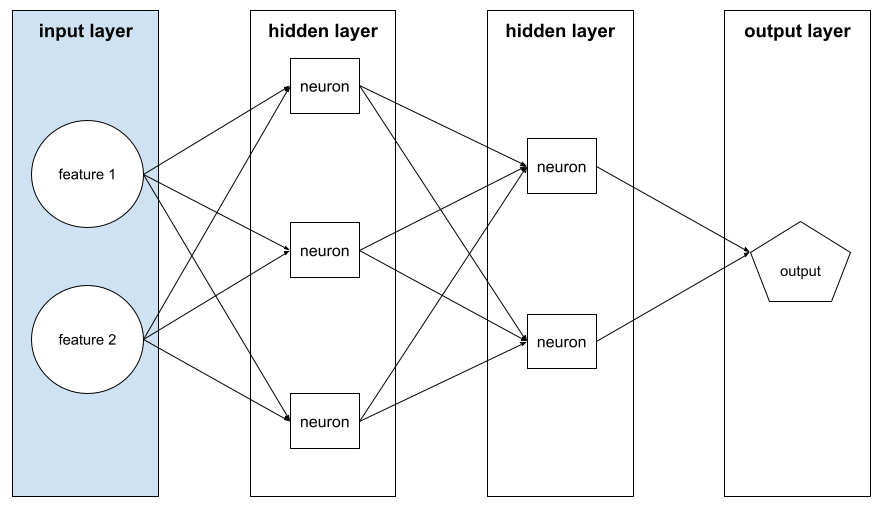

입력 레이어

특성 벡터를 보유하는 신경망의 레이어입니다. 즉, 입력 레이어는 학습 또는 추론을 위한 예를 제공합니다. 예를 들어 다음 신경망의 입력 레이어는 두 가지 기능으로 구성됩니다.

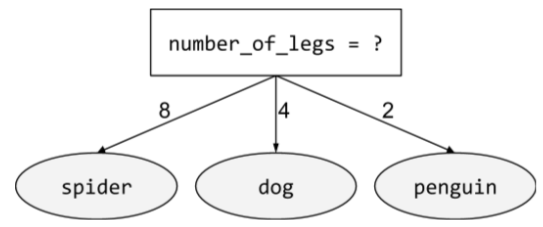

in-set 조건

결정 트리에서 상품 집합에 상품이 있는지 테스트하는 조건입니다. 예를 들어 다음은 인셋 조건입니다.

house-style in [tudor, colonial, cape]

추론 중에 주택 스타일 특성의 값이 tudor 또는 colonial 또는 cape이면 이 조건은 '예'로 평가됩니다. 하우스 스타일 기능의 값이 다른 값 (예: ranch)이면 이 조건은 '아니요'로 평가됩니다.

인셋 조건은 일반적으로 원-핫 인코딩된 특성을 테스트하는 조건보다 더 효율적인 결정 트리를 생성합니다.

인스턴스

예의 동의어입니다.

지침 조정

생성형 AI 모델이 안내를 따르는 능력을 개선하는 미세 조정의 한 형태입니다. 명령어 조정은 일반적으로 다양한 작업을 포괄하는 일련의 명령어 프롬프트로 모델을 학습시키는 과정입니다. 결과적으로 생성된 명령어를 기반으로 조정된 모델은 다양한 작업에서 제로샷 프롬프트에 유용한 대답을 생성하는 경향이 있습니다.

다음과 비교 및 대조:

해석 가능성

사람이 이해할 수 있는 용어로 ML 모델'의 추론을 설명하거나 제시할 수 있는 기능입니다.

예를 들어 대부분의 선형 회귀 모델은 해석 가능성이 높습니다. (각 기능의 학습된 가중치만 보면 됩니다.) 결정 포레스트는 해석 가능성도 높습니다. 하지만 일부 모델은 정교한 시각화가 있어야만 해석 가능합니다.

Learning Interpretability Tool (LIT)을 사용하여 ML 모델을 해석할 수 있습니다.

평가자 간 동의

작업을 수행할 때 인간 평가자가 동의하는 빈도를 측정한 값입니다. 평가자가 동의하지 않으면 작업 안내를 개선해야 할 수 있습니다. 평정자 간 동의 또는 평가자 간 신뢰성이라고도 합니다. 가장 널리 사용되는 평가자 간 동의 측정 방식 중 하나인 Cohen's kappa를 참고하세요.

자세한 내용은 머신러닝 단기집중과정의 범주형 데이터: 일반적인 문제를 참고하세요.

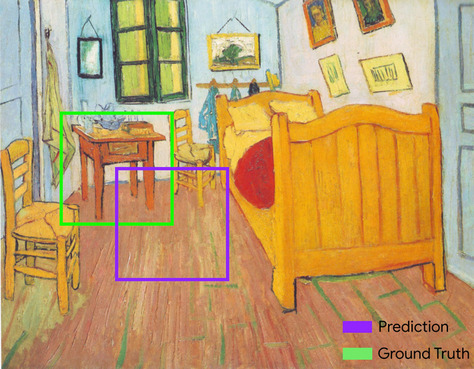

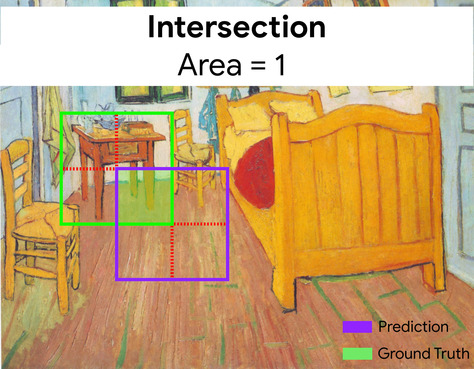

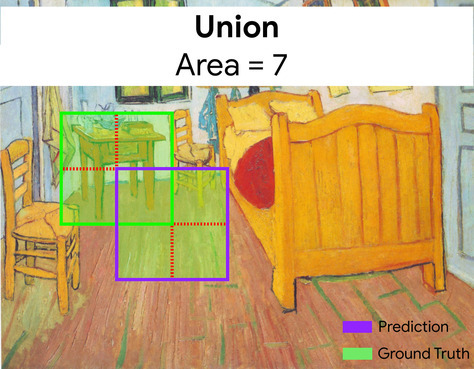

IoU (Intersection over Union)

두 집합의 교집합을 합집합으로 나눈 값입니다. 머신러닝 이미지 감지 작업에서 IoU는 정답 경계 상자와 관련하여 모델의 예측 경계 상자의 정확도를 측정하는 데 사용됩니다. 이 경우 두 상자의 IoU는 겹치는 영역과 전체 영역 간의 비율이며, 값의 범위는 0 (예측 경계 상자와 정답 경계 상자가 겹치지 않음)에서 1 (예측 경계 상자와 정답 경계 상자의 좌표가 정확히 동일함)입니다.

예를 들어 아래 이미지에서

- 예측된 경계 상자 (모델이 그림에서 협탁이 있다고 예측하는 위치를 구분하는 좌표)는 보라색으로 표시됩니다.

- 정답 경계 상자 (그림 속 테이블이 실제로 있는 위치를 구분하는 좌표)는 녹색으로 표시되어 있습니다.

여기서 예측 및 정답의 경계 상자 교차 영역(왼쪽 아래)은 1이고 예측 및 정답의 경계 상자 합집합 (오른쪽 아래)은 7이므로 IoU는 \(\frac{1}{7}\)입니다.

IoU

intersection over union의 약어입니다.

항목 매트릭스

추천 시스템에서 각 항목에 관한 잠재적 신호를 보유하는 행렬 분해로 생성된 임베딩 벡터의 행렬입니다. 항목 행렬의 각 행에는 모든 항목에 대한 단일 잠재적 특성 값이 있습니다. 예를 들어 영화 추천 시스템을 살펴보겠습니다. 항목 행렬의 각 열은 단일 영화를 나타냅니다. 잠재 신호는 장르를 나타내거나, 장르, 스타, 영화 시대 등 복잡한 상호작용을 포함하는 해석하기 어려운 신호일 수 있습니다.

항목 행렬은 인수 분해되는 대상 행렬과 동일한 수의 열을 포함합니다. 예를 들어 10,000개의 영화 타이틀을 평가하는 영화 추천 시스템의 경우 항목 행렬은 10,000개의 열을 포함합니다.

항목

추천 시스템에서 시스템이 추천하는 항목입니다. 예를 들어 동영상은 비디오 가게에서 추천하는 항목이고, 책은 서점에서 추천하는 항목입니다.

iteration

학습 중에 모델 파라미터(모델의 가중치 및 편향)를 한 번 업데이트합니다. 배치 크기는 모델이 단일 반복에서 처리하는 예시 수를 결정합니다. 예를 들어 배치 크기가 20이면 모델은 매개변수를 조정하기 전에 20개의 예시를 처리합니다.

신경망을 학습시킬 때 단일 반복에는 다음 두 패스가 포함됩니다.

- 단일 배치에서 손실을 평가하는 정방향 패스입니다.

- 손실과 학습률을 기반으로 모델의 매개변수를 조정하는 역방향 패스 (역전파)

자세한 내용은 머신러닝 단기집중과정의 경사 하강법을 참고하세요.

J

JAX

고성능 수치 컴퓨팅을 위해 XLA (가속 선형 대수학)과 자동 미분을 결합한 배열 컴퓨팅 라이브러리입니다. JAX는 구성 가능한 변환을 사용하여 가속화된 수치 코드를 작성하기 위한 간단하고 강력한 API를 제공합니다. JAX는 다음과 같은 기능을 제공합니다.

grad(자동 차별화)jit(JIT 컴파일)vmap(자동 벡터화 또는 일괄 처리)pmap(병렬화)

JAX는 Python의 NumPy 라이브러리와 유사하지만 범위가 훨씬 큰 숫자 코드의 변환을 표현하고 구성하는 언어입니다. (실제로 JAX의 .numpy 라이브러리는 기능적으로 동일하지만 Python NumPy 라이브러리를 완전히 다시 작성한 버전입니다.)

JAX는 모델과 데이터를 GPU 및 TPU 가속기 칩 전반에서 병렬 처리에 적합한 형태로 변환하여 많은 머신러닝 작업을 가속화하는 데 특히 적합합니다.

Flax, Optax, Pax 및 기타 여러 라이브러리는 JAX 인프라를 기반으로 빌드됩니다.

K

Keras

널리 사용되는 Python 머신러닝 API입니다. Keras는 TensorFlow를 비롯한 여러 딥 러닝 프레임워크에서 실행되며, TensorFlow에서는 tf.keras로 제공됩니다.

커널 서포트 벡터 머신 (KSVM)

입력 데이터 벡터를 더 높은 차원 공간에 매핑하여 포지티브 클래스와 네거티브 클래스 간의 간격을 최대화하는 분류 알고리즘입니다. 예를 들어 입력 데이터 세트가 특성 100개로 이루어진 분류 문제를 생각해 보겠습니다. KSVM은 포지티브 클래스와 네거티브 클래스 사이의 간격을 최대화하기 위해 내부적으로 이러한 특성을 백만 차원 공간에 매핑할 수 있습니다. KSVM은 힌지 손실이라는 손실 함수를 사용합니다.

keypoints

이미지의 특정 특징 좌표입니다. 예를 들어 꽃 종을 구분하는 이미지 인식 모델의 경우 키포인트는 각 꽃잎의 중심, 줄기, 수술 등이 될 수 있습니다.

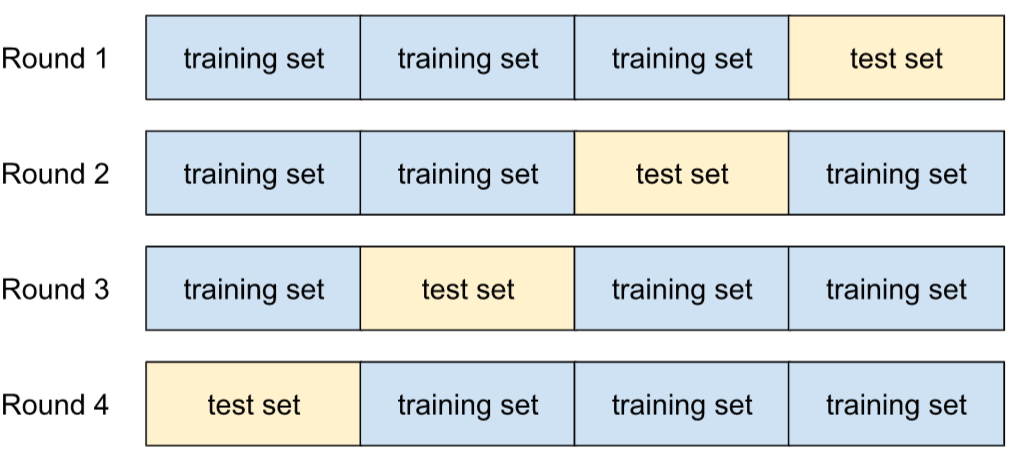

k-fold 교차 검증

새 데이터에 일반화하는 모델의 능력을 예측하는 알고리즘입니다. k-폴드의 k는 데이터 세트의 예시를 나누는 동일한 그룹의 수를 나타냅니다. 즉, 모델을 k번 학습시키고 테스트합니다. 각 학습 및 테스트 라운드에서 다른 그룹이 테스트 세트가 되고 나머지 모든 그룹이 학습 세트가 됩니다. k회의 학습 및 테스트를 거친 후 선택한 테스트 측정항목의 평균과 표준편차를 계산합니다.

예를 들어 데이터 세트가 120개의 예시로 구성되어 있다고 가정해 보겠습니다. 또한 k를 4로 설정한다고 가정해 보겠습니다. 따라서 예시를 섞은 후 데이터 세트를 30개의 예시로 구성된 4개의 동일한 그룹으로 나누고 4번의 학습 및 테스트 라운드를 진행합니다.

예를 들어 평균 제곱 오차 (MSE)는 선형 회귀 모델에 가장 의미 있는 측정항목일 수 있습니다. 따라서 네 라운드 전체에서 MSE의 평균과 표준 편차를 구합니다.

k-평균

비지도 학습의 한 방법으로 데이터를 그룹화하는 데 널리 사용되는 클러스터링 알고리즘입니다. k-평균 알고리즘은 기본적으로 다음과 같은 일을 합니다.

- 최고의 중심점 (중심이라고 함)들을 반복적으로 결정합니다.

- 각 예를 가장 가까운 중심에 배정합니다. 같은 중심에 가장 가까운 예는 같은 그룹에 속합니다.

k-평균 알고리즘은 각 예가 가장 가까운 중심과 각 예 사이 거리의 누적 제곱을 최소화할 수 있는 중심의 위치를 선택합니다.

예를 들어 개 높이와 개 너비의 다음 플롯을 살펴보세요.

k=3인 경우 k-평균 알고리즘은 3개의 중심을 결정합니다. 각 예는 가장 가까운 중심에 할당되어 다음 세 그룹이 생성됩니다.

한 제조업체가 소형, 중형, 대형 강아지 스웨터의 이상적인 크기를 결정하려고 한다고 가정해 보겠습니다. 세 개의 중심은 해당 클러스터에 있는 각 개의 평균 높이와 평균 너비를 식별합니다. 따라서 제조업체는 이 세 가지 중심점을 기반으로 스웨터 사이즈를 정해야 합니다. 클러스터의 중심점은 일반적으로 클러스터의 예가 아닙니다.

위 그림은 특성이 두 개 (높이와 너비)만 있는 예시의 k-평균을 보여줍니다. k-평균은 여러 특성에 걸쳐 예시를 그룹화할 수 있습니다.

자세한 내용은 클러스터링 과정의 k-평균 클러스터링이란 무엇인가요?를 참고하세요.

k-중앙값

k-평균과 밀접한 관련이 있는 클러스터링 알고리즘입니다. 이 두 알고리즘의 실질적인 차이는 다음과 같습니다.

- k-평균 알고리즘에서는 중심이 될 수 있는 위치와 각 예의 위치 사이 거리를 제곱한 값의 합계를 최소화하는 방식으로 중심을 결정합니다.

- k-중앙값 알고리즘에서는 중심이 될 수 있는 위치와 각 예의 위치 사이의 거리 값의 합계를 최소화하는 방식으로 중심을 결정합니다.

거리의 정의도 다릅니다.

- k-평균 알고리즘에서는 중심에서 예까지의 유클리드 거리를 사용합니다. 2차원에서 유클리드 거리는 피타고라스 정리를 사용하여 빗변의 길이를 계산하는 것을 의미합니다. 예를 들어 (2,2)와 (5, -2) 사이의 k-평균 거리는 다음과 같습니다.

- k-중앙값 알고리즘에서는 중심에서 예까지의 맨해튼 거리를 사용합니다. 이 거리는 각 차원 값 차의 절대값의 합입니다. 예를 들어 (2,2)와 (5, -2) 사이의 k-중앙값 거리는 다음과 같습니다.

L

L0 정규화

모델에서 0이 아닌 가중치의 총 개수에 페널티를 주는 정규화 유형입니다. 예를 들어 0이 아닌 가중치가 11개인 모델은 0이 아닌 가중치가 10개인 유사한 모델보다 더 많은 페널티를 받습니다.

L0 정규화를 L0-norm 정규화라고도 합니다.

L1 손실

실제 라벨 값과 모델이 예측한 값 간의 차이의 절대값을 계산하는 손실 함수입니다. 예를 들어 예 5개의 배치에 대한 L1 손실 계산은 다음과 같습니다.

| 예의 실제 값 | 모델의 예측값 | 델타의 절댓값 |

|---|---|---|

| 7 | 6 | 1 |

| 5 | 4 | 1 |

| 8 | 11 | 3 |

| 4 | 6 | 2 |

| 9 | 8 | 1 |

| 8 = L1 손실 | ||

평균 절대 오차는 예시당 평균 L1 손실입니다.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 손실을 참고하세요.

L1 정규화

가중치의 절대값 합에 비례하여 가중치에 페널티를 주는 정규화 유형입니다. L1 정규화는 관련성이 없거나 매우 낮은 특성의 가중치를 정확히 0으로 유도하는 데 도움이 됩니다. 가중치가 0인 기능은 모델에서 효과적으로 삭제됩니다.

L2 정규화와 대비되는 개념입니다.

L2 손실

실제 라벨 값과 모델이 예측한 값 간의 차이 제곱을 계산하는 손실 함수입니다. 예를 들어 예 5개의 배치에 대한 L2 손실 계산은 다음과 같습니다.

| 예의 실제 값 | 모델의 예측값 | 델타의 제곱 |

|---|---|---|

| 7 | 6 | 1 |

| 5 | 4 | 1 |

| 8 | 11 | 9 |

| 4 | 6 | 4 |

| 9 | 8 | 1 |

| 16 = L2 손실 | ||

제곱으로 인해 L2 손실은 이상치의 영향을 증폭시킵니다. 즉, L2 손실은 L1 손실보다 잘못된 예측에 더 강하게 반응합니다. 예를 들어 이전 배치에 대한 L1 손실은 16이 아닌 8이 됩니다. 단일 이상치가 16개 중 9개를 차지합니다.

회귀 모델은 일반적으로 L2 손실을 손실 함수로 사용합니다.

평균 제곱 오차는 예시당 평균 L2 손실입니다. 제곱 손실은 L2 손실의 또 다른 이름입니다.

자세한 내용은 머신러닝 단기집중과정의 로지스틱 회귀: 손실 및 정규화를 참고하세요.

L2 정규화

가중치의 제곱 합에 비례하여 가중치에 페널티를 주는 정규화 유형입니다. L2 정규화는 이상치 가중치 (높은 양수 값 또는 낮은 음수 값을 갖는 가중치)를 0에 가깝게 유도하지만 0은 아님. 값이 0에 매우 가까운 특성은 모델에 남아 있지만 모델의 예측에 큰 영향을 미치지 않습니다.

L2 정규화는 항상 선형 모델의 일반화를 개선합니다.

L1 정규화와 대비되는 개념입니다.

자세한 내용은 머신러닝 단기집중과정의 과적합: L2 정규화를 참고하세요.

라벨

지도 머신러닝에서 예의 '답' 또는 '결과' 부분을 의미합니다.

각 라벨이 지정된 예는 하나 이상의 특성과 라벨로 구성됩니다. 예를 들어 스팸 감지 데이터 세트의 경우 라벨은 '스팸' 또는 '스팸 아님'일 가능성이 높습니다. 강우량 데이터 세트에서 라벨은 특정 기간 동안 내린 비의 양일 수 있습니다.

자세한 내용은 머신러닝 소개의 감독 학습을 참고하세요.

라벨이 지정된 예

하나 이상의 특성과 라벨이 포함된 예입니다. 예를 들어 다음 표에는 주택 평가 모델의 라벨이 지정된 세 가지 예가 나와 있습니다. 각 예에는 세 가지 특성과 하나의 라벨이 있습니다.

| 침실 수 | 욕실 수 | 주택 연령 | 주택 가격 (라벨) |

|---|---|---|---|

| 3 | 2 | 15 | $345,000 |

| 2 | 1 | 72 | $179,000 |

| 4 | 2 | 34 | $392,000 |

지도 머신러닝에서 모델은 라벨이 지정된 예로 학습하고 라벨이 지정되지 않은 예에 대한 예측을 수행합니다.

라벨이 지정된 예와 라벨이 지정되지 않은 예의 대비

자세한 내용은 머신러닝 소개의 감독 학습을 참고하세요.

라벨 유출

특성이 라벨의 프록시인 모델 설계 결함입니다. 예를 들어 잠재 고객이 특정 제품을 구매할지 여부를 예측하는 이진 분류 모델을 생각해 보세요.

모델의 기능 중 하나가 SpokeToCustomerAgent라는 불리언이라고 가정해 보겠습니다. 또한 잠재 고객이 실제로 제품을 구매한 후에만 고객 상담사가 할당된다고 가정해 보겠습니다. 학습 중에 모델은 SpokeToCustomerAgent와 라벨 간의 연관성을 빠르게 학습합니다.

자세한 내용은 머신러닝 단기집중과정의 파이프라인 모니터링을 참고하세요.

람다

정규화율의 동의어입니다.

람다는 과부하된 용어입니다. 여기에서는 정규화 맥락의 용어 정의에 집중합니다.

LaMDA (대화형 애플리케이션을 위한 언어 모델)

Google에서 개발한 트랜스포머 기반 대규모 언어 모델로, 사실적인 대화 응답을 생성할 수 있는 대규모 대화 데이터 세트로 학습되었습니다.

LaMDA: Google의 혁신적인 대화 기술에서 개요를 확인할 수 있습니다.

landmarks

키포인트의 동의어입니다.

언어 모델

더 긴 토큰 시퀀스에서 토큰 또는 토큰 시퀀스가 발생할 확률을 추정하는 모델입니다.

자세한 내용은 머신러닝 단기집중과정의 언어 모델이란 무엇인가요?를 참고하세요.

대규모 언어 모델

최소한 매우 많은 수의 파라미터가 있는 언어 모델 비공식적으로는 Gemini 또는 GPT와 같은 Transformer 기반 언어 모델을 말합니다.

자세한 내용은 머신러닝 단기집중과정의 대규모 언어 모델 (LLM)을 참고하세요.

지연 시간

모델이 입력을 처리하고 응답을 생성하는 데 걸리는 시간입니다. 지연 시간이 높은 응답은 지연 시간이 낮은 응답보다 생성하는 데 시간이 더 오래 걸립니다.

대규모 언어 모델의 지연 시간에 영향을 미치는 요인은 다음과 같습니다.

- 입력 및 출력 [토큰] 길이

- 모델의 복잡도

- 모델이 실행되는 인프라

지연 시간을 최적화하는 것은 반응성이 높고 사용자 친화적인 애플리케이션을 만드는 데 매우 중요합니다.

잠재 공간

임베딩 공간의 동의어입니다.

레이어

신경망의 뉴런 집합입니다. 일반적인 세 가지 유형의 레이어는 다음과 같습니다.

예를 들어 다음 그림은 입력 레이어 1개, 히든 레이어 2개, 출력 레이어 1개가 있는 신경망을 보여줍니다.

TensorFlow에서 레이어는 텐서 및 구성 옵션을 입력으로 취하고 다른 텐서를 출력하는 Python 함수이기도 합니다.

레이어 API (tf.layers)

여러 레이어를 조합하여 심층신경망을 구축하는 TensorFlow API입니다. 레이어 API를 사용하면 다음과 같은 다양한 유형의 레이어를 만들 수 있습니다.

tf.layers.Dense- 완전 연결 레이어tf.layers.Conv2D- 컨볼루셔널 레이어

레이어 API는 Keras 레이어 API 규약을 따릅니다. 즉, 접두사가 다른 것을 제외하고 Layers API의 모든 함수는 Keras 레이어 API의 대응 항목과 이름과 서명이 동일합니다.

잎

결정 트리의 모든 엔드포인트 조건과 달리 리프는 테스트를 실행하지 않습니다. 리프는 가능한 예측입니다. 리프는 추론 경로의 터미널 노드이기도 합니다.

예를 들어 다음 결정 트리에는 리프가 3개 있습니다.

자세한 내용은 결정 트리 과정의 결정 트리를 참고하세요.

LIT(Learning Interpretability Tool)

시각적 대화형 모델 이해 및 데이터 시각화 도구입니다.

오픈소스 LIT를 사용하여 모델을 해석하거나 텍스트, 이미지, 표 형식 데이터를 시각화할 수 있습니다.

학습률

경사하강법 알고리즘에 각 반복에서 가중치와 편향을 조정하는 정도를 알려주는 부동 소수점 숫자입니다. 예를 들어 학습률이 0.3이면 학습률이 0.1일 때보다 가중치와 편향이 3배 더 강력하게 조정됩니다.

학습률은 핵심적인 초매개변수입니다. 학습률을 너무 낮게 설정하면 학습에 시간이 너무 오래 걸립니다. 학습률을 너무 높게 설정하면 경사하강법이 수렴에 도달하는 데 문제가 있는 경우가 많습니다.

자세한 내용은 머신러닝 단기집중과정의 선형 회귀: 하이퍼파라미터를 참고하세요.

최소 제곱 회귀

L2 손실을 최소화하면서 학습시킨 선형 회귀 모델입니다.

Levenshtein 거리

한 단어를 다른 단어로 변경하는 데 필요한 최소 삭제, 삽입, 대체 작업을 계산하는 편집 거리 측정항목입니다. 예를 들어 'heart'와 'darts' 사이의 레벤슈타인 거리는 3입니다. 다음 세 가지 수정사항이 한 단어를 다른 단어로 바꾸는 데 필요한 최소한의 변경사항이기 때문입니다.

- heart → deart('h'를 'd'로 대체)

- deart → dart('e' 삭제)

- dart → darts('s' 삽입)

위의 시퀀스가 3번의 수정으로 이어지는 유일한 경로는 아닙니다.

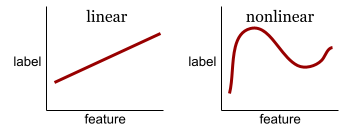

선형

덧셈과 곱셈만으로 표현할 수 있는 두 개 이상의 변수 간의 관계입니다.

선형 관계의 플롯은 선입니다.

비선형과 대비되는 개념입니다.

선형 모델

특성당 하나의 가중치를 할당하여 예측을 수행하는 모델 (선형 모델에는 편향도 포함됩니다.) 반면 심층 모델에서 특성과 예측의 관계는 일반적으로 비선형입니다.

선형 모델은 일반적으로 심층 모델보다 학습하기 쉽고 해석 가능성이 높습니다. 하지만 딥 모델은 특성 간의 복잡한 관계를 학습할 수 있습니다.

선형 회귀와 로지스틱 회귀는 두 가지 유형의 선형 모델입니다.

선형 회귀

다음 두 가지가 모두 참인 머신러닝 모델의 유형입니다.

선형 회귀와 로지스틱 회귀를 비교합니다. 또한 회귀와 분류를 비교해 보세요.

자세한 내용은 머신 러닝 집중 강좌의 선형 회귀를 참조하세요.

LIT

이전에는 언어 해석 도구로 알려진 학습 해석 도구 (LIT)의 약어입니다.

LLM

대규모 언어 모델의 약어입니다.