Dane statystyczne oznaczają funkcje wejściowe, które reprezentują jeden lub więcej odrębnych elementów z określonego zestawu opcji. Może to być na przykład zestaw filmów obejrzanych przez użytkownika, zestaw słów w dokumencie lub zawód osoby.

Najdokładniejszą reprezentacją danych kategorialnych są przypadki tensorów, czyli tensery z bardzo małą liczbą elementów niezerowych. Jeśli na przykład tworzymy model rekomendacji filmów, możemy przypisać unikalny identyfikator każdemu możliwemu filmowi, a potem reprezentować każdego użytkownika Tensorem obejrzanych filmów, tak jak na rysunku 3.

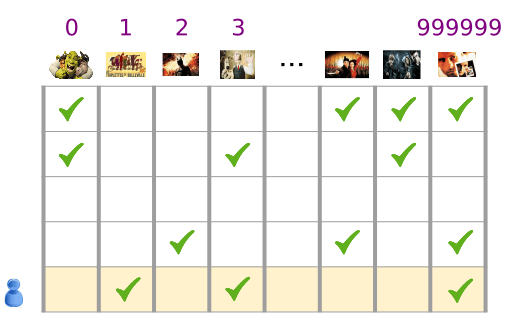

Rysunek 3. Dane dotyczące problemu z rekomendacją filmu.

Każdy wiersz macierzy na rysunku 3 stanowi przykład historii oglądania filmów użytkownika i jest przedstawiony jako tensorski, ponieważ każdy użytkownik ogląda tylko niewielki ułamek wszystkich możliwych filmów. Ostatni wiersz odpowiada zwięzłemu tensorowi [1, 3, 999999], używając indeksów słownych wyświetlanych nad ikonami filmów.

Analogicznie jedno słowo, zdania i dokumenty mogą być traktowane jako wąskie wektory, a każde słowo w słowniku odgrywa rolę podobną do filmu przedstawionego w naszym przykładzie.

Aby móc używać tych przedstawień w systemie uczącym się, musimy przedstawiać poszczególne obszary wektora liczbowego tak, aby semantycznie podobne elementy (filmy lub słowa) miały podobną odległość w przestrzeni wektorowej. Ale jak można przedstawić je jako wektor liczb.

Najprostszym sposobem jest zdefiniowanie ogromnej warstwy wejściowej z węzłem dla każdego słowa w słowniku lub co najmniej z każdym wyrazem w danych. Jeśli w danych pojawia się 500 tys. unikalnych słów, możesz reprezentować słowo o długości 500 tys. wektora, a każdemu z nich przypisać słowo do boksu w wektorze.

Jeśli przypiszesz &kot do indeksu 1247, to aby &&"cytować Ten rodzaj przedstawiciela jest nazywany kodowaniem jednorazowym, bo tylko jeden indeks ma wartość inną niż zero.

Większym elementem wektora może być liczba słów w większym fragmencie tekstu. czyli tzw. &torbę słów. W zestawie słów znajduje się kilka z 500 000 węzłów bez wartości zerowej.

Jednak jeśli podasz wartości inne niż zero, wektory poszczególnych słów będą miały bardzo wąskie wektory wejściowe – bardzo duże wektory, które mają stosunkowo niewielką wartość. Sceny reprezentujące niskie wartości mają kilka problemów, które mogą utrudniać modelowi efektywną naukę.

Rozmiar sieci

Ogromne wektory wejściowe to bardzo duża liczba wag dla sieci neuronowej. Jeśli w pierwszej warstwie sieci nad danymi wejściowymi znajdują się słowa „M”, a w węzłach N znajdują się słowa „m”, to trenowanie odbywa się z użyciem MxN. Duża liczba wag powoduje dalsze problemy:

Ilość danych. Im więcej wag w modelu, tym więcej danych trzeba efektywnie trenować.

Ilość mocy obliczeniowej. Im większa masa, tym więcej mocy obliczeniowej potrzebne do trenowania i używania modelu. Rozwiązanie dotyczące sprzętu może być prostsze,

Brak istotnych relacji między wektorami

Jeśli podajesz w pikselach klasyfikatory kanałów RGB, mów o wartościach &Close. Czerwononiebieski kolor jest zbliżony do błękitnego, zarówno pod względem semantyki, jak i geometrycznej odległości między wektorami. Wektor z wartością 1 w indeksie 1247 oznacza

Rozwiązanie: umieszczanie

Rozwiązaniem tych problemów jest użycie osadzeń, które przekształcają duże, rzadko używane wektory w mniej wymiarów, co pozwala zachować relacje semantyczne. W następnych sekcjach tego modułu omówimy, jak umieścić elementy w sposób intuicyjny, koncepcyjnie i automatycznie.